A IA na cloud pode parecer simples até tocar em algo que nunca carregaria de propósito. Ficheiros de clientes, notas privadas, documentos internos, fotos de família, até rascunhos levam à mesma pergunta: quem mais pode ver isto? Executar um modelo de linguagem grande localmente mantém esse conteúdo no hardware que controla, enquanto ainda oferece a velocidade e conveniência que as pessoas esperam da IA moderna.

Uma configuração local só ganha confiança quando se mantém fiável. Isso significa custos previsíveis, acesso offline quando necessário e um sistema que pode manter como qualquer outro serviço. Para muitas pessoas, um homelab é o local natural para IA privada porque já funciona com os hábitos que mantêm as coisas estáveis: limites claros, backups e predefinições sensatas.

Escolha o Seu Caso de Uso de IA Local e Métricas de Sucesso

A IA local funciona melhor quando tem uma tarefa clara. Decida o que quer que o modelo faça com mais frequência, porque essa escolha única determina tudo o resto: tamanho do modelo, necessidades de memória, disposição do armazenamento e as ferramentas que instala.

A maioria das configurações de homelab segue alguns padrões repetíveis:

- Assistente de escrita privado para emails, resumos, sumários e reescrita

- Suporte à programação para explicar código, gerar testes e elaborar refatorações

- Perguntas e respostas de documentos em manuais, PDFs, notas e bases de conhecimento

- Produtividade offline quando a conectividade é limitada ou prefere um fluxo de trabalho isolado

- Operações domésticas como projetos caseiros, garantias e inventários

Escolha duas ou três medidas para poder identificar o que está a funcionar e o que precisa de ser corrigido:

| Métrica | O Que Significa na Prática | Como Medir |

| Capacidade de resposta | As respostas chegam rápido o suficiente para manter o fluxo | Cronometre os seus prompts comuns |

| Qualidade da saída | Menos afirmações erradas e melhor estrutura | Compare respostas num pequeno conjunto de testes |

| Limite de privacidade | Apenas fontes aprovadas aparecem nas respostas | Verifique citações e âmbito de recuperação |

| Confiabilidade | O serviço mantém-se ativo e recupera-se de forma limpa | Teste de reinicialização, teste de atualização, teste de restauro |

| Controlo de custos | Sem surpresas nas faturas, consumo de energia estável | Acompanhe o consumo de energia e os gastos com hardware |

Construa uma Base de Hardware Equilibrada para Inferência Local

A seleção de hardware é mais simples do que parece quando se foca no essencial. A inferência local é um equilíbrio entre computação, memória e armazenamento, moldado pelo seu fluxo de trabalho e expectativas. Existem dois caminhos principais:

1. Inferência focada na CPU: Isto pode funcionar perfeitamente para modelos mais pequenos e para tarefas em segundo plano como indexação de documentos. Pode parecer lento para conversas longas e interativas, especialmente com janelas de contexto maiores.

2. Inferência acelerada: Uma GPU discreta ou outro acelerador normalmente melhora a velocidade de geração e torna modelos maiores viáveis para uso diário. Também altera a forma como pensa na memória, já que a VRAM se torna uma restrição chave.

A memória é geralmente a restrição decisiva. Os pesos do modelo ocupam espaço, e o runtime precisa de espaço extra para além disso, por isso planeie margem para o SO, contentores e quaisquer outros serviços a correr em paralelo com a inferência. A quantização ajuda a reduzir a pegada do modelo, mas não elimina a sobrecarga.

O armazenamento decide depois como o sistema se sente no dia a dia. As bibliotecas de modelos crescem com o tempo, e discos lentos transformam reinícios e trocas de modelos em longas esperas. Ollama, um runtime local para LLM, nota que o armazenamento de modelos pode atingir dezenas a centenas de gigabytes dependendo do que mantém instalado, por isso coloque modelos e índices vetoriais em armazenamento rápido sempre que possível, idealmente NVMe.

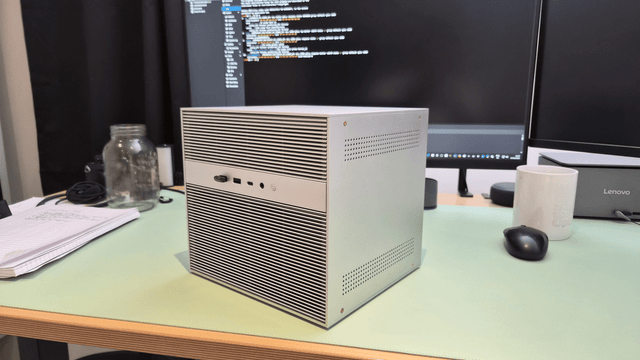

Se quer um servidor compacto concebido para cargas de trabalho self-hosted, hardware com capacidade de expansão pode simplificar a experimentação. Um exemplo é ZimaBoard 2, posicionado como um servidor doméstico com expansão PCIe que pode suportar complementos como armazenamento mais rápido ou aceleradores para cargas de trabalho locais de IA.

Para um homelab, “equilibrado” também significa sustentável: arrefecimento estável, ruído previsível e um perfil de consumo que não penaliza o funcionamento 24/7.

Tamanho, Quantização e Comprimento do Contexto: Escolher o Modelo Certo

Escolha o modelo depois de decidir o que o sistema deve fazer bem. Para IA local, três fatores determinam a experiência: número de parâmetros, quantização e comprimento do contexto.

1. Número de parâmetros: Modelos maiores geralmente lidam melhor com raciocínios complexos e mantêm coerência em tarefas mais longas. Modelos menores podem ser excelentes para sumarização, reescrita e muitas tarefas de programação, especialmente quando combinados com bons prompts e recuperação.

2. Quantização: A quantização representa os pesos do modelo com menor precisão para reduzir custos de memória e computação. É uma das principais razões pelas quais os LLMs locais são práticos em hardware de consumo. Espere um compromisso: menor precisão geralmente usa menos memória e pode ser mais rápida, mas também pode reduzir a precisão, especialmente em casos limite.

3. Comprimento do contexto: Contextos longos parecem apelativos, mas podem atrasar o processamento do prompt e aumentar a pressão na memória. Um modelo com uma janela de contexto enorme pode ainda parecer lento se o seu hardware tiver dificuldades em processar o prompt.

Método prático para escolher: mantenha um modelo diário responsivo, adicione um segundo apenas quando resolver uma lacuna específica, depois valide com os seus próprios prompts. Use um conjunto de testes pequeno: um prompt de escrita com tom controlado, uma pergunta sobre um documento que exija citações, uma tarefa real de programação e um prompt ambíguo para verificar factos inventados. Num homelab, o melhor modelo é aquele que pode executar durante toda a semana sem falhas.

Instale uma Stack Local Simples com Ollama e uma Interface Web

Mantenha a primeira implementação minimalista. Uma máquina executa a inferência e expõe uma API local, depois os seus outros dispositivos acedem a ela pela LAN. Esta configuração é fácil de depurar, fácil de proteger e simples de manter num homelab.

O Ollama funciona bem como runtime porque gere o download, armazenamento e serviço dos modelos num só lugar. Planeie o disco desde o primeiro dia. As bibliotecas de modelos crescem rapidamente, e é comum que os modelos instalados somem dezenas a centenas de gigabytes com o tempo. Coloque o diretório dos modelos num volume espaçoso e rápido, idealmente NVMe, para que carregar e alternar entre modelos não se torne um incómodo constante.

Um fluxo prático de implementação:

- Instale o Ollama na máquina que irá executar a inferência.

- Escolha um modelo que se ajuste aos seus limites de memória.

- Verifique um pedido local na mesma máquina.

- Verifique o acesso a partir de outro dispositivo na sua LAN.

Adicione uma interface web para histórico de chat, sessões e controlos básicos.

Para a camada de interface, Open WebUI é adequado porque foi construído para self-hosting, funciona offline e suporta APIs de chat compatíveis com OpenAI. Essa compatibilidade de API é importante quando quer ligar um modelo local a editores, ferramentas de notas e scripts simples sem refazer as suas integrações.

Antes de adicionar mais funcionalidades, torne a configuração resiliente:

- Execute o Ollama como um serviço que sobrevive a reinícios

- Persista os dados do Open WebUI para que as atualizações não redefinam a configuração

- Mantenha o acesso LAN apenas durante os testes iniciais

- Anote portas, caminhos e volumes num README curto

Uma vez que esta base esteja estável, adicionar RAG e reforçar a segurança torna-se simples.

Adicione RAG para Permitir que o Modelo Use os Seus Ficheiros e Notas

Um modelo local é poderoso, mas não conhece automaticamente os seus documentos. Copiar e colar funciona para um parágrafo, mas falha em fluxos de trabalho reais. RAG, abreviatura de geração aumentada por recuperação, resolve isto ao buscar texto relevante dos seus ficheiros e fornecê-lo ao modelo como contexto para cada resposta.

RAG funciona melhor quando o pipeline é explícito. Isso também ajuda na privacidade, pois pode definir quais as fontes permitidas.

Um pipeline típico RAG tem estas fases distintas:

- Ingestão: recolher documentos de pastas aprovadas

- Segmentação: dividir o texto em segmentos adequados para recuperação

- Embeddings: representar segmentos como vetores

- Indexação: armazenar vetores mais metadados

- Recuperação: obter as melhores correspondências para uma pergunta

- Resposta: gerar uma resposta fundamentada no texto recuperado

- Citações: mostrar quais as fontes utilizadas

Antes de adicionar qualquer automação, decida como é um “bom” resultado. Estas verificações tornam o comportamento RAG mais fácil de auditar:

- As respostas incluem citações claras para o ficheiro e secção exatos

- O sistema recusa responder quando a recuperação não devolve nada relevante

- Pastas sensíveis são excluídas por defeito, depois adicionadas intencionalmente

- O processo de atualização do índice é previsível e registado

A segmentação é um ponto comum de falha. Se os segmentos forem enormes, a recuperação devolve um muro de texto. Se os segmentos forem minúsculos, o contexto perde-se. Um bom compromisso varia consoante o tipo de documento, por isso teste nos seus ficheiros reais e depois ajuste. Num homelab, esse ajuste torna-se um investimento único que continua a dar frutos todos os dias.

Proteja e mantenha os seus serviços de IA privada em casa

A IA local é ainda um serviço de rede, e serviços de rede ficam expostos acidentalmente o tempo todo. Um encaminhamento de porta, um proxy reverso mal configurado ou uma regra “temporária” podem transformar um ponto final privado num público.

Prioridades de segurança, por ordem:

- Controlo de acesso: autenticação forte, contas mínimas, privilégio mínimo

- Âmbito de rede: apenas LAN por defeito, regras explícitas para qualquer acesso remoto

- Segurança de transporte: TLS para tudo o que sai do localhost

- Higiene de segredos: evite codificar chaves diretamente em configurações e registos

- Disciplina de patches: atualizações regulares para o SO, contentores e interface web

- Backups e restaurações: backups só são reais após um teste de restauração

Para acesso remoto, prefira uma VPN ou um túnel confiável em vez de portas abertas. Se usar um proxy reverso, mantenha-o protegido por autenticação e limites de taxa. Isso está alinhado com as orientações de segurança API ao estilo OWASP, que destacam repetidamente a autenticação e autorização falhadas como modos comuns de falha em sistemas reais.

A manutenção é o que separa uma demonstração de fim de semana de um assistente privado fiável. Uma rotina leve funciona bem:

- Semanalmente: verifique o crescimento do disco para ficheiros de modelos e índices

- Mensalmente: aplique atualizações e reinicie durante uma janela de baixo impacto

- Trimestralmente: verifique backups, altere credenciais, reveja serviços expostos

Trate a sua stack de IA local como qualquer outro serviço central no seu homelab. Essa mentalidade reduz a ansiedade e mantém a promessa de privacidade intacta.

Coloque o seu homelab de IA privada online hoje!

Para tornar a inteligência artificial privada prática em casa, concentre-se na fiabilidade tranquila. Aposte num desempenho constante, custos estáveis e limites de privacidade. Execute um grande modelo de linguagem localmente, adicione uma interface simples e limite o acesso aos dispositivos e pessoas em quem confia. Depois, melhore com base no uso real, como armazenamento mais rápido para carregamento mais ágil, segurança reforçada ou RAG para um conjunto pequeno de documentos. Construa uma configuração de homelab em que possa confiar e deixe a sua IA local ganhar o seu lugar no seu fluxo de trabalho diário a partir de hoje!

Perguntas Frequentes

P1: Posso executar um LLM local num mini servidor de baixo consumo num homelab?

Sim, em muitos casos, especialmente para tarefas de escrita mais leves e prompts curtos. Espere respostas mais lentas em sistemas apenas com CPU, e escolha modelos menores ou mais quantizados. Se quiser uma utilização diária mais fluida, planeie ter RAM suficiente e armazenamento NVMe rápido para reduzir atrasos na carga.

P2: A IA local funcionará no meu portátil e ainda se integrará com os serviços do meu homelab?

Sim, frequentemente. Pode executar o modelo localmente num portátil para viagens, depois apontar as suas ferramentas para um endpoint do homelab em casa quando estiver na sua LAN ou VPN. Mantenha as configurações simples usando um padrão consistente de API local e uma interface.

P3: Preciso de acesso à internet para usar IA auto-hospedada após a configuração?

Não, não para inferência básica uma vez que o runtime e os modelos estejam instalados. Algumas funcionalidades ainda podem depender de serviços de rede, como descarregar novos modelos, atualizar contentores ou sincronizar documentos. Para um fluxo de trabalho verdadeiramente offline, descarregue os modelos antecipadamente e mantenha a documentação local e embeddings no armazenamento do seu homelab.

P4: Como posso evitar que o meu chatbot local divulgue dados privados a outros utilizadores?

Use contas separadas e permissões rigorosas por espaço de trabalho ou conjunto de dados. Limite as fontes de recuperação a pastas específicas e evite indexar diretórios partilhados em casa. O registo também é importante. Mantenha os registos mínimos e reveja-os para conteúdo sensível. Num homelab multiutilizador, isole serviços com contentores e regras de rede.

P5: Qual é uma forma razoável de estimar as necessidades de armazenamento para LLMs locais e pesquisa de documentos?

Planeie para o crescimento. Um ou dois modelos podem ser suficientes, mas as coleções expandem-se rapidamente. Considere dezenas de gigabytes como ponto de partida, depois adicione espaço para múltiplos modelos, ficheiros de cache e um índice de recuperação para os seus documentos. NVMe ajuda no desempenho, enquanto HDDs maiores podem armazenar arquivos.

Centro de Campanha Zima

Mais para Ler

Guia de Monitorização do ZimaCube Home Lab: Desde o Uptime Kuma até aos Agentes de IA

Monitorize o seu servidor doméstico com Uptime Kuma, Pulse, Proxmox Data Center Manager ou um agente de IA para acompanhar o tempo de atividade,...

De Sparcstation a ZimaBlade: A jornada de auto-hospedagem de um geek de 57 anos

Um profissional administrativo francês substituiu o seu Raspberry Pi 4 avariado por um ZimaBlade 7700, a correr Debian 13, XFS e BorgBackup. Construção completa...

ZimaCube vs NAS DIY: Qual é o Ideal para Si?

NAS pré-construído ou faça você mesmo? Analisamos os custos reais, o tempo de configuração, o Thunderbolt 4 e as diferenças de manutenção para ajudar...