Cloud-AI kan moeiteloos aanvoelen totdat het iets raakt dat je nooit bewust zou uploaden. Klantbestanden, privénotities, interne documenten, familiefoto's, zelfs ruwe concepten leiden allemaal tot dezelfde vraag: wie kan dit nog meer zien? Het lokaal draaien van een groot taalmodel houdt die inhoud op hardware die jij beheert, terwijl het toch de snelheid en het gemak levert die mensen verwachten van moderne AI.

Een lokale setup verdient alleen vertrouwen als deze betrouwbaar blijft. Dat betekent voorspelbare kosten, offline toegang wanneer je het nodig hebt, en een systeem dat je kunt onderhouden als elke andere service. Voor veel mensen is een homelab de natuurlijke plek voor privé-AI omdat het al draait op de gewoonten die dingen stabiel houden: duidelijke grenzen, back-ups en verstandige standaardinstellingen.

Kies je lokale AI-gebruikssituatie en succescriteria

Lokale AI werkt het beste wanneer het een duidelijke taak heeft. Bepaal wat je wilt dat het model het vaakst doet, want die ene keuze bepaalt alles: modelgrootte, geheugengebruik, opslagindeling en de tools die je installeert.

De meeste homelab-setup vallen in een paar herhaalbare patronen:

- Privé schrijfassistent voor e-mails, briefs, samenvattingen en herschrijven

- Ondersteuning bij coderen voor het uitleggen van code, genereren van tests en opstellen van refactors

- Document Q en A over handleidingen, PDF's, notities en kennisbanken

- Offline productiviteit wanneer de connectiviteit beperkt is, of je een air-gapped workflow verkiest

- Huishoudelijke taken zoals thuisprojecten, garanties en inventarissen

Kies twee of drie meetpunten zodat je kunt zien wat werkt en wat moet worden verbeterd:

| Maatstaf | Wat het in de praktijk betekent | Hoe het te meten |

| Responsiviteit | Antwoorden komen snel genoeg om de flow te behouden | Meet de tijd van je veelgebruikte prompts |

| Outputkwaliteit | Minder verkeerde beweringen en betere structuur | Vergelijk antwoorden over een kleine testset |

| Privacygrens | Alleen goedgekeurde bronnen verschijnen in antwoorden | Verifieer citaties en reikwijdte van ophalen |

| Betrouwbaarheid | Service blijft actief en herstelt schoon | Herstarttest, updatetest, hersteltest |

| Kostenbeheersing | Geen verrassende rekeningen, stabiel stroomverbruik | Houd energie- en hardware-uitgaven bij |

Bouw een gebalanceerde hardwarebasis voor lokale inferentie

Hardwareselectie is eenvoudiger dan het lijkt wanneer je je richt op de essentie. Lokale inferentie is een balans tussen rekenkracht, geheugen en opslag, gevormd door je workflow en verwachtingen. Er bestaan twee brede paden:

1. CPU-georiënteerde inferentie: Dit kan prima werken voor kleinere modellen en achtergrondtaken zoals het indexeren van documenten. Het kan traag aanvoelen bij lange, interactieve gesprekken, vooral met grotere contextvensters.

2. Versnelde inferentie: Een discrete GPU of andere accelerator verbetert meestal de generatiesnelheid en maakt grotere modellen haalbaar voor dagelijks gebruik. Het verandert ook hoe je naar geheugen kijkt, aangezien VRAM een belangrijke beperking wordt.

Geheugen is meestal de doorslaggevende beperking. Modelgewichten nemen ruimte in, en de runtime heeft extra ruimte nodig, dus plan voldoende marge voor het besturingssysteem, containers en andere services die naast inferentie draaien. Kwantisatie helpt de modelgrootte te verkleinen, maar elimineert de overhead niet.

Opslag bepaalt vervolgens hoe het systeem zich dagelijks gedraagt. Modelbibliotheken groeien in de loop van de tijd, en trage schijven veranderen herstarts en modelwisselingen in lange wachttijden. Ollama, een lokale LLM-runtime, merkt op dat modelopslag kan oplopen tot tientallen tot honderden gigabytes, afhankelijk van wat je geïnstalleerd houdt, dus plaats modellen en vectorindexen op snelle opslag wanneer mogelijk, idealiter NVMe.

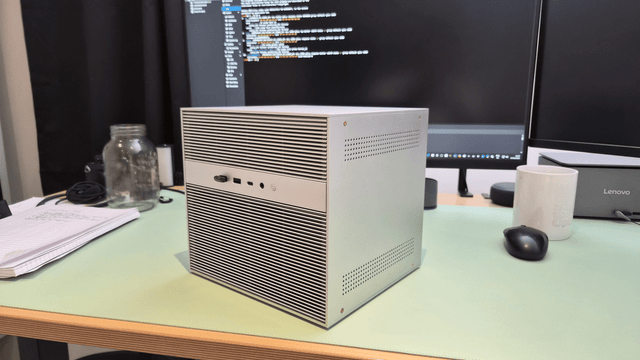

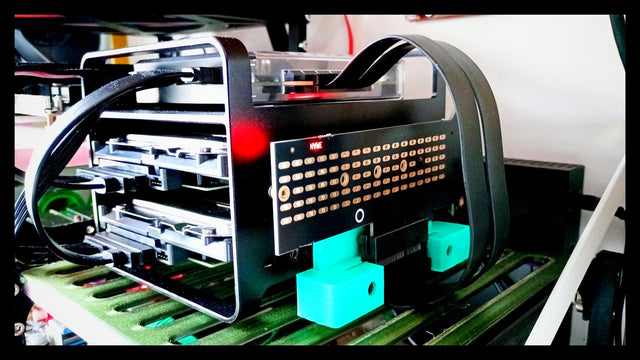

Als je een compacte server wilt die ontworpen is voor zelfgehoste workloads, kan uitbreidbare hardware experimenteren vereenvoudigen. Een voorbeeld is ZimaBoard 2, gepositioneerd als een thuisserver met PCIe-uitbreiding die add-ons zoals snellere opslag of versnellingskaarten voor lokale AI-workloads kan ondersteunen.

Voor een homelab betekent “gebalanceerd” ook onderhoudsvriendelijk: stabiele koeling, voorspelbaar geluid en een energieprofiel dat je niet straft voor 24/7 gebruik.

Grootte, kwantisatie en contextlengte: het juiste model kiezen

Kies het model nadat je hebt besloten wat het systeem goed moet kunnen. Voor lokale AI bepalen drie factoren de ervaring: aantal parameters, kwantisatie en contextlengte.

1. Aantal parameters: Grotere modellen kunnen over het algemeen moeilijkere redeneringen aan en behouden samenhang bij langere taken. Kleinere modellen kunnen nog steeds uitstekend zijn voor samenvattingen, herschrijven en veel codeertaken, vooral in combinatie met goede prompts en retrieval.

2. Kwantisatie: Kwantisatie vertegenwoordigt modelgewichten met lagere precisie om geheugen- en rekencapaciteitskosten te verlagen. Het is een van de belangrijkste redenen waarom lokale LLM's praktisch zijn op consumentenhardware. Verwacht een compromis: lagere precisie werkt vaak met minder geheugen en kan sneller zijn, maar kan ook de nauwkeurigheid verminderen, vooral bij randgevallen.

3. Contextlengte: Lange context klinkt aantrekkelijk, maar kan de promptverwerking vertragen en de geheugenbelasting verhogen. Een model met een enorm contextvenster kan nog steeds traag aanvoelen als je hardware moeite heeft met het verwerken van prompts.

Praktische manier om te kiezen: houd één responsief dagelijks model, voeg een tweede toe alleen als het een specifieke lacune oplost, en valideer dan met je eigen prompts. Gebruik een kleine testset: één toon-gecontroleerde schrijfopdracht, één documentvraag die citaties vereist, één echte codeertaak en één dubbelzinnige prompt om te controleren op verzonnen feiten. In een homelab is het beste model degene die je de hele week zonder crashes kunt draaien.

Installeer een eenvoudige lokale stack met Ollama en een webinterface

Houd de eerste implementatie minimaal. Eén machine voert inferentie uit en biedt een lokale API aan, waarna je andere apparaten er via het LAN toegang toe krijgen. Deze opzet is makkelijk te debuggen, eenvoudig te beveiligen en makkelijk te onderhouden in een homelab.

Ollama werkt goed als runtime omdat het modeldownloads, opslag en bediening op één plek afhandelt. Plan vanaf dag één schijfruimte in. Modellibraries groeien snel en het is gebruikelijk dat geïnstalleerde modellen na verloop van tijd tientallen tot honderden gigabytes in beslag nemen. Plaats de modelmap op een ruime, snelle schijf, bij voorkeur NVMe, zodat het laden en wisselen van modellen geen constante ergernis wordt.

Een praktische implementatiestroom:

- Installeer Ollama op de machine die de inferentie zal uitvoeren.

- Kies één model dat binnen je geheugenlimieten past.

- Verifieer een lokaal verzoek op dezelfde machine.

- Verifieer toegang vanaf een ander apparaat op je LAN.

Voeg een webinterface toe voor chatgeschiedenis, sessies en basisbediening.

Voor de interface-laag past Open WebUI goed omdat het is gebouwd voor zelfhosting, offline werkt en OpenAI-compatibele chat-API’s ondersteunt. Die API-compatibiliteit is belangrijk als je een lokaal model wilt koppelen aan editors, notitietools en eenvoudige scripts zonder je integraties te herzien.

Maak de setup veerkrachtig voordat je meer functies toevoegt:

- Draai Ollama als een service die reboot overleeft

- Bewaar Open WebUI gegevens zodat updates de configuratie niet resetten

- Beperk de toegang tot het LAN alleen tot de vroege testfase

- Schrijf poorten, paden en volumes op in een korte README

Zodra deze basis stabiel is, wordt het toevoegen van RAG en het aanscherpen van de beveiliging eenvoudig.

Voeg RAG toe om het model je bestanden en notities te laten gebruiken

Een lokaal model is krachtig, maar kent je documenten niet automatisch. Kopiëren en plakken werkt voor een alinea, maar faalt bij echte workflows. RAG, kort voor retrieval augmented generation, lost dit op door relevante tekst uit je bestanden te halen en als context aan het model te geven voor elk antwoord.

RAG werkt het beste als de pijplijn expliciet is. Dat helpt ook met privacy, omdat je kunt bepalen welke bronnen zijn toegestaan.

Een typische RAG-pijplijn heeft deze verschillende fasen:

- Inname: verzamel documenten uit goedgekeurde mappen

- Chunking: splits tekst in segmenten die makkelijk op te halen zijn

- Embeddings: representeer chunks als vectoren

- Indexeren: sla vectoren plus metadata op

- Ophalen: haal de beste overeenkomsten voor een vraag op

- Beantwoorden: genereer een antwoord gebaseerd op opgehaalde tekst

- Citaties: toon welke bronnen zijn gebruikt

Voordat je automatisering toevoegt, bepaal wat “goed” betekent. Deze controles maken het gedrag van RAG makkelijker te controleren:

- Antwoorden bevatten duidelijke citaten naar het exacte bestand en de sectie

- Het systeem weigert te antwoorden wanneer het ophalen niets relevants oplevert

- Gevoelige mappen zijn standaard uitgesloten en worden daarna bewust toegevoegd

- Het proces van indexverversing is voorspelbaar en wordt gelogd

Chunking is een veelvoorkomend knelpunt. Als chunks enorm zijn, levert het ophalen een muur van tekst op. Als chunks klein zijn, gaat de context verloren. Een goede middenweg verschilt per documenttype, dus test op je eigen bestanden en stel bij. In een homelab wordt die afstemming een eenmalige investering die elke dag rendeert.

Beveilig en onderhoud je privé AI-services thuis

Lokale AI is nog steeds een netwerkservice, en netwerkservices worden voortdurend per ongeluk blootgesteld. Een portforward, een verkeerd geconfigureerde reverse proxy of een “tijdelijke” regel kan een privé-eindpunt veranderen in een openbaar eindpunt.

Beveiligingsprioriteiten, in volgorde:

- Toegangscontrole: sterke authenticatie, minimale accounts, minste privileges

- Netwerkscope: standaard alleen LAN, expliciete regels voor externe toegang

- Transportbeveiliging: TLS voor alles wat de localhost verlaat

- Geheimenhygiëne: vermijd het hardcoderen van sleutels in configuraties en logs

- Patchdiscipline: regelmatige updates voor het besturingssysteem, containers en webinterface

- Back-ups en herstel: back-ups zijn pas echt na een hersteltest

Voor externe toegang geef de voorkeur aan een VPN of een vertrouwde tunnel boven open poorten. Als je een reverse proxy gebruikt, houd deze dan beveiligd achter authenticatie en snelheidslimieten. Dit sluit aan bij de OWASP-richtlijnen voor API-beveiliging, die herhaaldelijk gebroken authenticatie en autorisatie als veelvoorkomende faalpunten in echte systemen benadrukken.

Onderhoud is wat een weekenddemo onderscheidt van een betrouwbare privé-assistent. Een lichte routine werkt goed:

- Wekelijks: controleer schijfgroei voor modelbestanden en indexen

- Maandelijks: voer updates uit en herstart tijdens een periode met weinig impact

- Per kwartaal: controleer back-ups, roteer inloggegevens, bekijk blootgestelde services

Behandel je lokale AI-stack als elke andere kernservice in je homelab. Die mindset vermindert stress en houdt de privacybelofte intact.

Zet je privé AI-homelab vandaag online!

Om privé kunstmatige intelligentie praktisch thuis te maken, richt je op rustige betrouwbaarheid. Streef naar stabiele prestaties, voorspelbare kosten en privacygrenzen. Draai één groot taalmodel lokaal, voeg een eenvoudige interface toe en beperk de toegang tot de apparaten en mensen die je vertrouwt. Verbeter vervolgens op basis van echt gebruik, zoals snellere opslag voor sneller laden, sterkere beveiliging of RAG voor een kleine set documenten. Bouw een homelab-opstelling waarop je kunt vertrouwen, en laat je lokale AI vanaf vandaag een plek verdienen in je dagelijkse workflow!

Veelgestelde vragen

Q1: Kan ik een lokale LLM draaien op een energiezuinige mini-server in een homelab?

Ja, in veel gevallen, vooral voor lichtere schrijftaken en korte prompts. Verwacht tragere reacties op CPU-only systemen, en kies kleinere of zwaarder gekwantiseerde modellen. Als je soepel dagelijks gebruik wilt, plan dan voor genoeg RAM en snelle NVMe-opslag om laadtijden te verminderen.

Q2: Werkt lokale AI op mijn laptop en integreert het nog steeds met mijn homelab-diensten?

Ja, vaak. Je kunt het model lokaal op een laptop draaien voor onderweg, en je tools weer naar een homelab-endpoint thuis wijzen wanneer je op je LAN of VPN bent. Houd configuraties eenvoudig door een consistent lokaal API-patroon en één interface te gebruiken.

Q3: Heb ik internettoegang nodig om zelfgehoste AI te gebruiken na de installatie?

Nee, niet voor basisinference zodra de runtime en modellen zijn geïnstalleerd. Sommige functies kunnen nog steeds afhankelijk zijn van netwerkdiensten, zoals het ophalen van nieuwe modellen, het bijwerken van containers of het synchroniseren van documenten. Voor een echte offline workflow, download modellen vooraf en bewaar lokale documentatie en embeddings op je homelab-opslag.

Q4: Hoe voorkom ik dat mijn lokale chatbot privégegevens lekt naar andere gebruikers?

Gebruik aparte accounts en strikte permissies per werkruimte of dataset. Beperk de zoekbronnen tot specifieke mappen en vermijd het indexeren van gedeelde thuismappen. Logging is ook belangrijk. Houd logs minimaal en controleer ze op gevoelige inhoud. In een multi-user homelab isoleer je diensten met containers en netwerkregels.

Q5: Wat is een redelijke manier om opslagbehoeften te schatten voor lokale LLM's en documentzoekopdrachten?

Plan voor groei. Eén of twee modellen passen misschien comfortabel, maar collecties groeien snel. Beschouw tientallen gigabytes als uitgangspunt, en voeg dan ruimte toe voor meerdere modellen, cachebestanden en een zoekindex voor je documenten. NVMe verbetert de prestaties, terwijl grotere HDD's archieven kunnen opslaan.

Zima Campagne Hub

Meer om te lezen

ZimaCube Home Lab Monitoring Gids: Van Uptime Kuma tot AI Agents

Houd je thuisserver in de gaten met Uptime Kuma, Pulse, Proxmox Data Center Manager of een AI-agent om de uptime, back-ups, virtuele machines, waarschuwingen...

Van Sparcstation tot ZimaBlade: de zelfhostingreis van een 57-jarige geek

Een Franse administratief professional verving zijn defecte Raspberry Pi 4 door een ZimaBlade 7700, met Debian 13, XFS en BorgBackup. Volledige back-up server gebouwd...

ZimaCube versus doe-het-zelf NAS: Welke past het beste bij jou?

Vooraf gebouwde NAS of doe-het-zelf? We zetten de werkelijke kosten, installatietijd, Thunderbolt 4 en onderhoudsverschillen op een rij om je te helpen beslissen welke...