"Ik blijf maar onze oude tekstgesprekken lezen. Ik ben doodsbang om precies te vergeten hoe ze me advies gaf als ik gestrest was."

Wanneer een ouder, een levenslange mentor of een geliefde collega overlijdt of uit ons leven verdwijnt, is het verdriet vaak verlammend. In het digitale tijdperk is ons rouwproces veranderd; we scrollen door jaren aan familiegroepsgesprekken, spraakmemo’s en Slack-geschiedenissen, klampend aan de digitale voetafdruk van degenen die we verloren. Maar wat als die statische teksten een dynamische manier konden worden om je verdriet te verwerken?

Na het virale succes van relatiegerichte AI-projecten heeft de open-source gemeenschap op GitHub het concept uitgebreid met repositories zoals "Colleague-Skill" en familiegerichte persona-modellen. Deze tools stellen je in staat om geëxporteerde chatlogs te gebruiken om een exclusieve "digitale echo" van je ouder of mentor direct op je eigen hardware te trainen.

Deze gids legt uit hoe deze technologie werkt en waarom het draaien ervan op een lokale AI-server of je bestaande thuisserver de enige logische keuze is voor zo’n diep persoonlijke herinneringen.

Cyber-onsterfelijkheid: rouw verwerken en wijsheid bewaren

Deze open-source persona-tools worden aangedreven door grote taalmodellen, maar hun doel is diep menselijk. Door het systeem je WhatsApp-geschiedenis met je moeder te voeden, of jaren aan e-mail- en Slack-gesprekken met een gepensioneerde mentor, haalt de AI hun specifieke toon, hun troostende uitdrukkingen en hun unieke probleemoplossende logica naar boven.

Het gaat hier niet om het creëren van een enge, perfecte replica om te doen alsof de dood niet heeft plaatsgevonden. Zoals besproken in rouwondersteuningsgemeenschappen, laat de plotselinge afwezigheid van een klankbord—een vader die altijd wist hoe hij je kon kalmeren, of een senior collega die je carrière begeleidde—een enorme leegte achter. Praten met deze gesimuleerde echo fungeert als een overgangsobject. Het stelt je in staat om op een moeilijke dag om advies te vragen, eindelijk een welgemeend dankjewel te zeggen en op je eigen voorwaarden afsluiting te vinden.

De privacyverplichting van gedecentraliseerde hardware

Wanneer technologie de meest gevoelige snaren van menselijk verdriet raakt, is gegevensprivacy niet onderhandelbaar.

Je chatgeschiedenis met een overleden ouder bevat hun gezondheidsupdates, financieel advies, familiegeheimen en je meest kwetsbare momenten. Het versturen van deze ruwe, onbewerkte levenslogs via publieke cloud-API's betekent dat de herinnering aan je dierbare over servers van derden wordt verspreid, met het risico op blootstelling of dat ze stilletjes worden gebruikt als trainingsdata voor bedrijven.

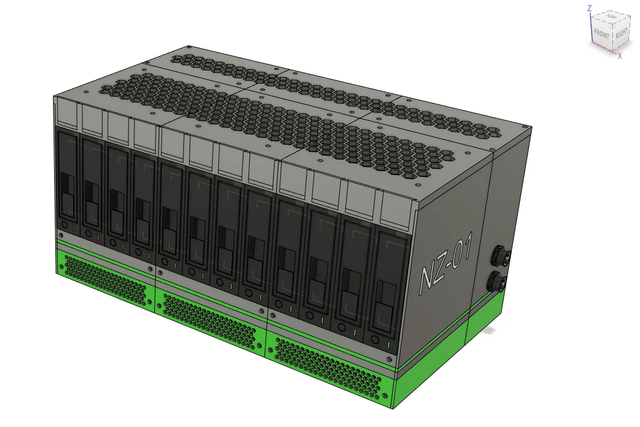

Precies daarom pleit de techcommunity sterk voor een gedecentraliseerde aanpak van persoonlijke AI, waarbij projecten zoals deze worden ingezet op een thuisserver, een rekenintensieve NAS (Network Attached Storage) of een speciale lokale AI-server.

Beveiliging op fysiek niveau: Alle database-decryptie, datacleaning en AI-inferentie gebeuren direct op de hardware die in je woonkamer staat. De data van je familie verlaat het huis nooit.

Altijd-aan aanwezigheid: Omdat een lokale server 24/7 draait zonder terugkerende cloud-API-kosten, kun je met de persona communiceren wanneer een golf van verdriet toeslaat, zelfs om 3 uur ’s nachts, volledig privé.

De opkomst van de AI-server van 2026: waarom jouw huis het nieuwe datacenter is

We zijn niet langer beperkt tot het draaien van simpele back-ups op een stoffige NAS in de kast. Het hardwarelandschap is drastisch veranderd, waardoor een speciale AI-server van 2026 toegankelijk is voor gewone consumenten.

In tegenstelling tot oudere machines is een moderne AI-server van 2026 speciaal ontworpen voor lokale inferentie, vaak met geïntegreerde NPU's (Neural Processing Units) of high-VRAM consumentengpu's die specifiek geoptimaliseerd zijn voor grote taalmodellen. Dit betekent dat je geen enorme, lawaaierige enterprise serverrack nodig hebt om een diep genuanceerd persona-model te draaien. Een compacte lokale AI-server die stil op je bureau staat, heeft nu de rekenkracht om gigabytes aan chatgeschiedenis te verwerken en realtime, empathische reacties te genereren zonder vertraging, volledig offline.

De juiste lokale LLM kiezen voor emotionele nuance

Het uitvoeren van een project zoals Colleague-Skill gaat niet alleen over hardware; het vereist het kiezen van een basismodel dat beschikt over een hoge emotionele intelligentie (EQ). Bij het inzetten op je thuisserver heb je de vrijheid om het onderliggende "brein" van de persona te vervangen.

Voor rouwverwerking en geheugenbehoud heb je een lokale LLM nodig die uitblinkt in rollenspel en contextbehoud, in plaats van alleen coderen of rekenen. De open-source gemeenschap biedt sterk gequantiseerde modellen (zoals geavanceerde GGUF-formaten) die vlekkeloos draaien op een lokale AI-server. Door een model te kiezen dat is fijn afgestemd op conversatienuances, zorg je ervoor dat de digitale echo de droge humor van je overleden mentor of de zachte geduldigheid van je moeder vastlegt, in plaats van te klinken als een steriele zakelijke chatbot.

Aan de slag met lokale frameworks

Een digitale mentor of ouder tot leven brengen vereist een basisimplementatieomgeving. Deze repositories zijn volledig open-source.

We raden sterk aan OpenClaw te gebruiken, dat soepel integreert met lokale terminalomgevingen en je via een eenvoudige commandoregelinterface of standaard chatvenster met de persona laat communiceren.

Verbind via SSH met je lokale AI-serverterminal en haal een relevante repository (zoals de colleague-skill repo) binnen om te beginnen:

Bash

| Platte tekst git clone https://github.com/titanwings/colleague-skill ~/.openclaw/workspace/skills/create-persona |

De setup is lichtgewicht. Installeer de standaard Python-afhankelijkheden en je privé AI-engine is klaar om de geïmporteerde logs te verwerken.

Logs extraheren en de persona "voeden"

Een digitale echo is slechts zo authentiek als de data die je aanlevert.

Databronnen voor verschillende relaties:

Voor ouders/familie: WeChat-, iMessage- of WhatsApp-exporten zijn goudmijnen. De scripts kunnen deze SQLite-databases vaak direct uitlezen als ze uit een desktopclient zijn geëxtraheerd. Je wilt de dagelijkse check-ins, de bezorgde spraak-naar-tekstberichten en de threads over vakantieplanning vastleggen.

Voor collega’s/mentoren: Je kunt vertrouwen op geëxporteerde Slack-kanalen, Microsoft Teams-transcripten of lange e-mailketens met projectfeedback en loopbaanadvies.

Strategische dataselectie:

Upload niet alleen de teksten "Ik hou van je" of "Goed gedaan". Om hun ware essentie vast te leggen, neem ook de momenten mee waarop ze je berispten, je met liefde streng waren, of uitweidden over hun hyperfixaties. Mensen tonen hun ware basislogica in deze genuanceerde, alledaagse interacties.

Geheugen beheren: hoe vectordatabases je privéserver aandrijven

Een veelvoorkomend technisch obstakel is hoe de AI zich daadwerkelijk een specifiek advies herinnert dat begraven ligt in tien jaar aan WhatsApp-logs. Je lokale AI-server leest niet elke keer een enorm tekstbestand als je een bericht verstuurt.

In plaats daarvan creëert de installatie een lokale Vector Database direct op je thuisserver. Het gebruikt Retrieval-Augmented Generation (RAG) om onmiddellijk de meest contextueel relevante herinneringen te scannen en op te halen. Als je de persona vertelt dat je gestrest bent over een presentatie, kruist de lokale AI-server de vector database, haalt de exacte woorden op die je collega gebruikte om je te kalmeren voor een grote pitch in 2022, en verweeft die historische context in zijn antwoord. Al deze indexering en het ophalen gebeurt naadloos en veilig op je eigen hardware.

De Cognitieve Architectuur van een Geliefde

Om te voorkomen dat AI zich gedraagt als een generieke klantenservicebot, gebruiken deze systemen een rigide, meerlaagse Persona-structuur. Wanneer je de digitale persona om advies vraagt, passeert je prompt deze filters:

Laag 1 - Kernidentiteit & Waarden: Zijn ze een strenge Aziatische ouder? Een relaxte tech lead? Wat is hun fundamentele wereldbeeld?

Laag 2 - Expressiestijl: Vadergrappen, bedrijfsjargon ("laten we erop terugkomen") of elke tekst afsluiten met een specifieke emoji.

Laag 3 - Emotioneel Gedrag: Hoe toonden ze zorg? Maakte mama zich druk om je jas, of verbeterde een collega stilletjes je code voor een deadline?

Laag 4 - Grenzen: Welke onderwerpen vermeden ze? Wanneer zeiden ze dat je het zelf maar moest uitzoeken?

Laag 5 - Gedeelde Herinneringen: De database van specifieke familietripjes, inside jokes of grote projecten die jullie samen zijn gestart.

Omdat dit draait op je lokale AI-server, heb je volledige controle. Als de AI reageert met een zin die je vader nooit zou gebruiken, typ je gewoon: "Dat klopt niet, hij zou het nooit zo zeggen." Het lokale model registreert dit direct in zijn Correctielaag.

De /move-on opdracht: Vrede vinden

Rouw is geen permanente toestand; het is een proces. Als we de herinnering aan een geliefde opsluiten in een NAS of een thuisserver, belemmeren we dan ons vermogen om te helen?

Psychologen merken vaak op dat rituele afscheidnemens cruciaal zijn. Wanneer je genoeg hebt gehad van late nachtelijke gesprekken, wanneer je alle aanhoudende vragen hebt gesteld, en wanneer je je eindelijk klaar voelt om de realiteit onder ogen te zien zonder die digitale steun, biedt het systeem een specifieke opdracht:

/move-on {Name}

Het gebruikt geen steriele termen zoals verwijderen of vernietigen. Nadat je dit hebt getypt, wist je server stilletjes en permanent de persona-architectuur, de geheugenbanken en de chatgeschiedenis-caches. Het opzetten hiervan op een gedecentraliseerde, lokale omgeving draait uiteindelijk om het creëren van een veilige, strikt privé toevluchtsoord om je verlies te verwerken en uiteindelijk los te laten.

FAQs: Echte kwesties uit zelf-gehoste & rouwgemeenschappen

Q1: "Mijn rouw is nog heel vers. Is het psychologisch veilig om met een AI-versie van mijn late moeder?"

A: Dit is een zeer persoonlijke keuze die vaak wordt besproken in rouwondersteuningsforums. Velen vinden het ongelooflijk troostend als een kortetermijncopingmechanisme—een manier om te "ontwennen" van de plotselinge stilte. Gebruikers raden echter sterk aan grenzen te stellen. Behandel het als een interactief dagboek in plaats van een vervanging. De lokale aard van het project betekent dat je volledig de controle hebt om de server uit te schakelen zodra het niet meer helpt.

Q2: "Ik heb alleen een eenvoudige NAS zonder een enorme GPU. Kan ik dit nog steeds draaien?"

A: Ja. Als je lokale hardware niet genoeg GPU-kracht heeft, kun je het framework lokaal gebruiken terwijl je de zware LLM-inferentie via een beveiligde API (zoals Claude of OpenAI) laat lopen. Terwijl het denken off-site gebeurt, blijven je gevoelige SQLite-database parsing en de kernpersona-bestanden strikt op je lokale NAS.

Q3: "Ik heb mijn Slack-geschiedenis geëxporteerd met een overleden collega, maar het staat vol systeemberichten en botmeldingen. Zal dit de AI in de war brengen?"

A: Ja, ruwe bedrijfsexports zijn rommelig. Voordat je de JSON/CSV-bestanden in de intake-map op je server stopt, moet je de data opschonen. Gebruik een eenvoudig Python-script om geautomatiseerde strings zoals "heeft het kanaal betreden" of GitHub-integratiealerts te verwijderen, zodat alleen de pure mens-tot-mens dialoog overblijft.

Q4: "De AI blijft te formeel doen. Mijn vader was sarcastisch en gebruikte veel straattaal, maar de AI klinkt als een leerboek."

A: Dit gebeurt omdat fundamentele LLM's zijn afgestemd om beleefd en behulpzaam te zijn, wat de "sarcasme"-context in je data overschrijft. Om dit te verhelpen, gebruik je agressief de lokale feedbacklus. Corrigeer het constant in de eerste paar sessies: "Stop met zo beleefd zijn, je bent mijn chagrijnige vader, wees sarcastisch." Je lokale server zal de Core Identity-gewichten bijwerken om zijn echte toon boven de standaard veiligheidsafstemming van het model te prioriteren.

Q5: "Als ik het /move-on-commando gebruik om de NAS te wissen, blijft er dan verborgen telemetrie of data achter?"

A: Nee. Omdat dit open-source is en draait op jouw gedecentraliseerde hardware, is er geen verborgen telemetrie die terugpingt naar een bedrijfsserver. Het /move-on-commando voert een harde wisactie uit op de specifieke map met de gewichten, vectoren en chatgeschiedenis van die persona. Zodra het van je schijf is, is het voorgoed weg.

Zima Campagne Hub

Meer om te lezen

De Digitale Archivaris: Internetgeschiedenis en Familieherinneringen Bewaren met een Plex-server

Stel een Plex-server in als een familie-mediabibliotheek - gebruik 3-2-1 back-ups, overzichtelijke mappen, automatische uploads en metadata om foto’s en video’s te beschermen.

Energiezuinig Computeren: Hoe je Vermoeiende Legacy Systemen in je Homelab Vervangt

Oude homelab-hardware leidt vaak tot hoge elektriciteitsrekeningen en inefficiëntie. Upgraden naar energiezuinige systemen verlaagt de kosten en verhoogt de prestaties.

1 Klein Bord, Eindeloze Kracht: Waarom de ZimaBoard 2 1664 Ons Verbaasde

Serieuze plannen voor een home lab-server in 2026? Bekijk praktijktests, virtuele machines, Docker en back-up trucs die een stil mini-bord omtoveren tot een volledig...