クラウドAIは、意図的にアップロードしないものに触れるまでは手軽に感じられます。クライアントファイル、プライベートノート、内部文書、家族写真、さらには草稿までもが同じ疑問を生みます: 他に誰がこれを見られるのか? ローカルで大規模言語モデルを動かすことで、そのコンテンツは自分が管理するハードウェアに留まりつつ、現代のAIに期待される速度と利便性を提供します。

ローカルセットアップは信頼を得るために信頼性を維持しなければなりません。つまり、予測可能なコスト、必要なときのオフラインアクセス、そして他のサービスと同様にメンテナンス可能なシステムです。多くの人にとって、 ホームラボ はプライベートAIの自然な居場所です。なぜなら、すでに安定を保つ習慣、つまり明確な境界、バックアップ、合理的なデフォルト設定で運用されているからです。

ローカルAIのユースケースと成功指標を選ぶ

ローカルAIは明確な役割があるときに最も効果的です。モデルに最も頻繁にしてほしいことを決めてください。その単一の選択が、モデルサイズ、メモリ要件、ストレージ構成、インストールするツールすべてを決定します。

ほとんどのホームラボのセットアップは、いくつかの繰り返し可能なパターンに分類されます:

- プライベートライティングアシスタント メール、ブリーフ、要約、書き直しのために

- コーディングサポート コードの説明、テスト生成、リファクタリングの草案作成のために

- ドキュメントQ&A マニュアル、PDF、メモ、ナレッジベース全体で

- オフライン生産性 接続が制限されている場合やエアギャップのワークフローを好む場合

- 家庭の作業 ホームプロジェクト、保証、在庫管理など

何が機能していて何を修正すべきかを判断できるように、2つか3つの指標を選びましょう:

| 指標 | 実際の意味 | 測定方法 |

| 応答性 | 回答が流れを妨げない速さで届く | よく使うプロンプトの時間を計測する |

| 出力の品質 | 誤った主張が減り、構造が改善される | 小さなテストセットで回答を比較する |

| プライバシーの境界 | 承認された情報源のみが回答に表示される | 引用元と検索範囲を検証する |

| 信頼性 | サービスは稼働し続け、正常に回復する | 再起動テスト、アップデートテスト、復元テスト |

| コスト管理 | 予期しない請求なし、安定した電力消費 | エネルギーとハードウェアの支出を追跡する |

ローカル推論のためのバランスの取れたハードウェア基盤を構築する

ハードウェアの選択は、重要なポイントに集中すれば見た目よりも簡単です。ローカル推論は、計算能力、メモリ、ストレージのバランスであり、ワークフローと期待によって形作られます。大きく分けて二つの道があります:

1. CPU中心の推論:これは小さなモデルやドキュメントのインデックス作成などのバックグラウンドタスクには十分実用的です。特に大きなコンテキストウィンドウを使う長時間の対話型チャットでは動作が遅く感じるかもしれません。

2. アクセラレーテッド推論:専用GPUやその他のアクセラレータは通常、生成速度を向上させ、より大きなモデルを日常的に使えるようにします。また、VRAMが重要な制約となるため、メモリの考え方も変わります。

メモリは通常、成否を分ける制約です。モデルの重みはスペースを取り、ランタイムはさらに余裕が必要なので、OSやコンテナ、推論と並行して動作する他のサービスのための余裕も計画してください。量子化はモデルのフットプリントを縮小しますが、オーバーヘッドを完全に排除するわけではありません。

ストレージが日々のシステムの使い勝手を決めます。モデルライブラリは時間とともに増え、遅いディスクでは再起動やモデルの切り替えに長い待ち時間が発生します。Ollama(ローカルLLMランタイム)は、モデルのストレージ容量がインストールする内容によって数十ギガバイトから数百ギガバイトに達することがあると指摘しているため、モデルやベクターインデックスは可能な限り高速ストレージ、理想的にはNVMeに配置しましょう。

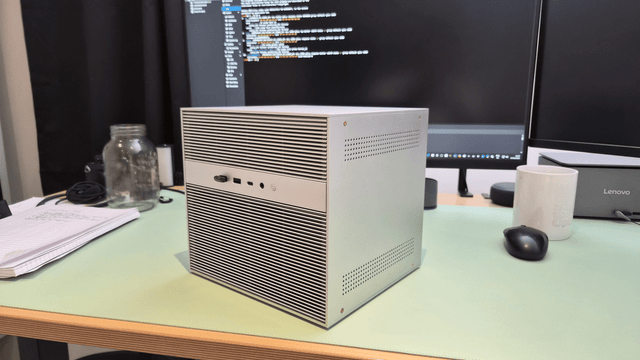

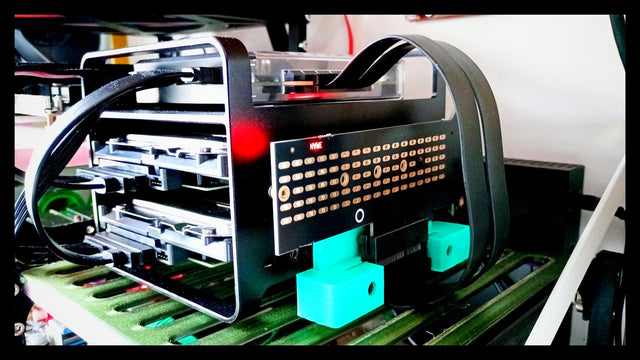

セルフホストのワークロード向けに設計されたコンパクトなサーバーを求めるなら、拡張性の高いハードウェアが実験を簡単にします。例えば、PCIe拡張を備えたホームサーバーとして位置づけられているZimaBoard 2は、高速ストレージやローカルAIワークロード用のアクセラレータなどのアドオンをサポートできます。

ホームラボの場合、「バランスが取れている」とはメンテナンスしやすいことも意味します:安定した冷却、予測可能な騒音、そして24時間365日稼働しても負担にならない電力プロファイルです。

サイズ、量子化、コンテキスト長:適切なモデルの選び方

システムに求める性能を決めた後にモデルを選びましょう。ローカルAIでは、体験を決める3つの要素はパラメータ数、量子化、コンテキスト長です。

1. パラメータ数: 大きなモデルはより難しい推論をこなし、長いタスクでも一貫性を保ちます。小さなモデルでも、良いプロンプトや検索と組み合わせれば、要約、書き換え、多くのコーディングタスクに優れています。

2. 量子化: 量子化はモデルの重みを表現します 低精度でメモリと計算コストを削減します。これはローカルLLMが一般消費者向けハードウェアで実用的である主な理由の一つです。トレードオフを覚悟してください:低精度はメモリ使用を抑え高速化することがありますが、特にエッジケースで精度が落ちることがあります。

3. コンテキスト長: 長いコンテキストは魅力的ですが、プロンプト処理が遅くなりメモリ負荷が増すことがあります。巨大なコンテキストウィンドウを持つモデルでも、ハードウェアがプロンプトの取り込みに苦労すると遅く感じることがあります。

実用的な選び方: 反応の良い日常用モデルを1つ維持し、特定のギャップを埋める場合にのみ2つ目を追加し、自分のプロンプトで検証します。小さなテストセットを使いましょう:トーンを制御したライティングプロンプト1つ、引用が必要な文書質問1つ、実際のコーディングタスク1つ、そして事実誤認をチェックする曖昧なプロンプト1つ。ホームラボでは、クラッシュせずに1週間動かせるモデルが最良です。

Ollamaとウェブインターフェースでシンプルなローカルスタックをインストールします。

最初の展開は最小限に抑えます。1台のマシンが推論を実行しローカルAPIを公開し、他のデバイスはLAN経由でアクセスします。この構成はデバッグが簡単で、セキュリティも確保しやすく、ホームラボでの管理もシンプルです。

Ollamaはモデルのダウンロード、保存、提供を一元管理するため、ランタイムとして優れています。初日からディスク容量を計画してください。モデルライブラリは急速に増え、インストールされたモデルが 数十〜数百ギガバイト に達することが一般的です。モデルディレクトリは広くて高速なボリューム、理想的にはNVMeに置き、モデルの読み込みや切り替えが常に煩わしくならないようにしましょう。

実用的な展開フロー:

- 推論を実行するマシンにOllamaをインストールします。

- メモリ制限に合うモデルを1つ選びます。

- 同じマシン上でローカルリクエストを確認します。

- LAN内の別のデバイスからアクセスを確認します。

チャット履歴、セッション、基本操作のためのウェブインターフェースを追加します。

インターフェース層には、 Open WebUI が適しています。これはセルフホスティング向けに作られ、オフラインで動作し、 OpenAI互換のチャットAPIをサポートしています。このAPI互換性は、ローカルモデルをエディタやノートツール、簡単なスクリプトに接続したい場合に重要です。

機能を追加する前に、セットアップを堅牢にする:

- Ollamaを再起動後も動作するサービスとして実行する

- Open WebUI のデータを保持し、アップデートで設定がリセットされないようにする

- 初期テスト中はLANアクセスのみに制限する

- ポート、パス、ボリュームを短いREADMEに記録する

この基盤が安定すれば、RAGの追加とセキュリティ強化は簡単になります。

RAGを追加してモデルにファイルやノートを活用させる

ローカルモデルは強力ですが、自動的にあなたのドキュメントを知っているわけではありません。段落のコピー&ペーストは機能しますが、実際のワークフローでは限界があります。RAG( retrieval augmented generation)は、ファイルから関連テキストを取得し、それを各回答の文脈としてモデルに提供することでこれを解決します。

RAG はパイプラインが明示的な場合に最も効果的です。これにより、許可された情報源を定義できるためプライバシーも保護されます。

典型的なRAGパイプラインはこれらの明確な段階を持ちます:

- 取り込み:承認されたフォルダからドキュメントを収集する

- チャンク分割:テキストを検索に適したセグメントに分割する

- 埋め込み:チャンクをベクトルとして表現する

- インデックス作成:ベクトルとメタデータを保存する

- 検索:質問に対する上位の一致を引き出す

- 回答:取得したテキストに基づいた応答を生成する

- 引用:使用された情報源を示す

自動化を追加する前に、「良い」とは何かを決めてください。これらのチェックはRAGの動作を監査しやすくします:

- 回答には 明確な引用 が含まれ、正確なファイルとセクションが示されます

- 検索結果に関連情報がない場合、システムは回答を拒否します

- 機密フォルダはデフォルトで除外され、意図的に追加されます

- インデックスの更新プロセスは予測可能でログに記録されます

チャンク分割はよくある失敗ポイントです。チャンクが大きすぎると、検索結果が長文の塊になってしまいます。チャンクが小さすぎると、文脈が失われます。適切なバランスは文書の種類によって異なるため、実際のファイルでテストして調整してください。 ホームラボでは、その調整は一度の投資で毎日効果を発揮し続けます。

家庭でプライベートAIサービスを安全に維持しましょう

ローカルAIもネットワークサービスであり、ネットワークサービスは常に誤って公開されるリスクがあります。ポートフォワード、誤設定のリバースプロキシ、または「一時的な」ルールがプライベートなエンドポイントをパブリックに変えてしまうことがあります。

セキュリティの優先順位は以下の通りです:

- アクセス制御:強力な認証、最小限のアカウント、最小権限

- ネットワーク範囲:デフォルトはLANのみ、リモートアクセスには明示的なルールを設定

- トランスポートセキュリティ: TLS をローカルホスト外に出る通信に適用

- シークレット管理:設定ファイルやログにキーをハードコーディングしない

- パッチ管理:OS、コンテナ、Web UIの定期的なアップデート

- バックアップとリストア:リストアテストを行って初めてバックアップは本物になる

リモートアクセスには、オープンポートよりもVPNや信頼できるトンネルを優先してください。もし リバースプロキシを使う場合は、認証とレート制限の背後にしっかりとロックしてください。これはOWASPのAPIセキュリティガイドラインに沿ったもので、実際のシステムでよくある失敗原因として認証と認可の破綻を繰り返し指摘しています。

メンテナンスは、週末のデモと信頼できるプライベートアシスタントを分けるものです。軽いルーチンで十分です:

- 毎週:モデルファイルやインデックスのディスク使用量の確認

- 毎月:アップデートの適用と影響の少ない時間帯での再起動

- 四半期ごと:バックアップの検証、認証情報のローテーション、公開サービスのレビュー

ローカルAIスタックを ホームラボの他のコアサービスと同じように扱いましょう。その考え方が不安を減らし、プライバシーの約束を守ります。

今日からプライベートAIホームラボをオンラインにしましょう!

家庭でプライベートな人工知能を実用的にするには、落ち着いた信頼性に注目しましょう。安定したパフォーマンス、安定したコスト、そしてプライバシーの境界を目指します。大きな言語モデルをローカルで1つ動かし、シンプルなインターフェースを追加し、信頼できるデバイスと人だけがアクセスできるように制限します。その後、実際の使用に基づいて改善を行い、例えばより速いストレージで読み込みを高速化したり、強化されたセキュリティや少数のドキュメントに対するRAGを導入したりします。信頼できるホームラボ環境を構築し、今日からローカルAIを日常のワークフローに取り入れましょう!

よくある質問

Q1: 低消費電力のミニサーバーでローカルLLMをホームラボで動かせますか?

はい、特に軽い文章作成や短いプロンプトの場合は多くのケースで可能です。 CPUのみのシステムでは応答が遅くなることがあるため、小型またはより強く量子化されたモデルを選びましょう。日常的にスムーズに使いたい場合は、十分なRAMと 高速NVMeストレージ を用意して負荷遅延を減らす計画を立ててください。

Q2: ローカルAIはノートパソコンで動作し、ホームラボのサービスと連携できますか?

はい、しばしば必要です。旅行中はノートパソコンでローカルにモデルを動かし、LANや VPNに接続できる自宅のホームラボのエンドポイントにツールを切り替えられます。設定は一貫したローカルAPIパターンと単一のインターフェースを使ってシンプルに保ちましょう。

Q3: セットアップ後に自己ホスト型AIを使うのにインターネット接続は必要ですか?

いいえ、ランタイムとモデルがインストールされていれば基本的な推論では不要です。ただし、新しいモデルの取得、コンテナの更新、ドキュメントの同期など、一部の機能はネットワークサービスに依存することがあります。完全なオフライン運用を目指すなら、事前にモデルをダウンロードし、ローカルのドキュメントや埋め込みデータをホームラボのストレージに保存してください。

Q4: ローカルチャットボットが他のユーザーにプライベートデータを漏らさないようにするには?

ワークスペースやデータセットごとに別々のアカウントと厳格な権限を設定しましょう。検索対象は特定のフォルダに限定し、共有のホームディレクトリはインデックス化しないようにします。ログも重要です。ログは最小限にし、機密情報が含まれていないか確認しましょう。複数ユーザーのホームラボでは、コンテナとネットワークルールでサービスを分離してください。

Q5: ローカルLLMやドキュメント検索のストレージ必要量を合理的に見積もる方法は?

成長を見越して計画しましょう。1台か2台のモデルは問題なく収まるかもしれませんが、コレクションはすぐに増えます。 数十ギガバイト を出発点と考え、複数モデルやキャッシュファイル、そして ドキュメントの検索インデックス のための余裕を持たせましょう。NVMeはパフォーマンスを向上させ、大容量のHDDはアーカイブ保存に適しています。

Zima キャンペーンハブ

もっと読む

ZimaCubeホームラボ監視ガイド:Uptime KumaからAIエージェントまで

Uptime Kuma、Pulse、Proxmox Data Center Manager、またはAIエージェントを使ってホームサーバーを監視し、稼働時間、バックアップ、仮想マシン、アラートを追跡し、重要なサービスのダウンタイムを回避しましょう。

スパークステーションからZimaBladeへ:57歳のギークのセルフホスティングの旅

フランスの管理職の方が故障したRaspberry Pi 4をZimaBlade 7700に置き換え、Debian 13、XFS、BorgBackupを使用しました。フルバックアップサーバーの構築が1時間以内に完了しました。

ZimaCubeとDIY NAS:どちらがあなたに適している?

既製のNASかDIYか?実際のコスト、セットアップ時間、Thunderbolt 4、メンテナンスの違いを詳しく解説し、どの構成があなたのニーズと予算に最適かを判断するお手伝いをします。