Cloud-KI kann mühelos wirken, bis sie etwas berührt, das Sie niemals absichtlich hochladen würden. Kundendateien, private Notizen, interne Dokumente, Familienfotos, sogar Rohentwürfe führen alle zur gleichen Frage: Wer kann das sonst noch sehen? Ein großes Sprachmodell lokal auszuführen, hält diese Inhalte auf Hardware, die Sie kontrollieren, und bietet dennoch die Geschwindigkeit und Bequemlichkeit, die Menschen von moderner KI erwarten.

Ein lokales Setup gewinnt nur dann Vertrauen, wenn es zuverlässig bleibt. Das bedeutet vorhersehbare Kosten, Offline-Zugriff, wenn Sie ihn brauchen, und ein System, das Sie wie jeden anderen Dienst warten können. Für viele Menschen ist ein Homelab der natürliche Ort für private KI, weil es bereits auf den Gewohnheiten basiert, die Stabilität gewährleisten: klare Grenzen, Backups und sinnvolle Voreinstellungen.

Wählen Sie Ihren lokalen KI-Anwendungsfall und Erfolgskriterien

Lokale KI funktioniert am besten, wenn sie eine klare Aufgabe hat. Entscheiden Sie, was das Modell am häufigsten tun soll, denn diese einzelne Wahl bestimmt alles andere: Modellgröße, Speicherbedarf, Speicherlayout und die Tools, die Sie installieren.

Die meisten Homelab-Setups fallen in einige wiederkehrende Muster:

- Privater Schreibassistent für E-Mails, Berichte, Zusammenfassungen und Umschreibungen

- Codierungsunterstützung zum Erklären von Code, Generieren von Tests und Entwerfen von Refaktorisierungen

- Dokumenten-Q&A über Handbücher, PDFs, Notizen und Wissensdatenbanken

- Offline-Produktivität wenn die Verbindung eingeschränkt ist oder Sie einen luftgetrennten Workflow bevorzugen

- Haushaltsaufgaben wie Heimprojekte, Garantien und Inventare

Wählen Sie zwei oder drei Messgrößen, damit Sie erkennen können, was funktioniert und was verbessert werden muss:

| Metrik | Was es in der Praxis bedeutet | Wie man es misst |

| Reaktionsfähigkeit | Antworten kommen schnell genug, um den Fluss zu halten | Messen Sie die Zeit Ihrer häufigen Eingaben |

| Ausgabequalität | Weniger falsche Behauptungen und bessere Struktur | Vergleichen Sie Antworten über einen kleinen Testsatz |

| Datenschutzgrenze | Nur genehmigte Quellen erscheinen in den Antworten | Überprüfen Sie Zitate und Abrufumfang |

| Zuverlässigkeit | Der Dienst bleibt verfügbar und erholt sich sauber | Neustart-Test, Update-Test, Wiederherstellungstest |

| Kostenkontrolle | Keine Überraschungsrechnungen, stabiler Stromverbrauch | Verfolgen Sie Energie- und Hardwareausgaben |

Bauen Sie eine ausgewogene Hardwarebasis für lokale Inferenz auf

Die Hardwareauswahl ist einfacher als sie scheint, wenn Sie sich auf das Wesentliche konzentrieren. Lokale Inferenz ist ein Gleichgewicht aus Rechenleistung, Speicher und Speicherplatz, geprägt von Ihrem Workflow und Ihren Erwartungen. Es gibt zwei grundlegende Wege:

1. CPU-fokussierte Inferenz: Das kann für kleinere Modelle und Hintergrundaufgaben wie das Indexieren von Dokumenten gut funktionieren. Für lange, interaktive Chats fühlt es sich besonders bei größeren Kontextfenstern möglicherweise träge an.

2. Beschleunigte Inferenz: Eine dedizierte GPU oder ein anderer Beschleuniger verbessert normalerweise die Generierungsgeschwindigkeit und macht größere Modelle für den täglichen Gebrauch praktikabel. Das ändert auch die Betrachtung des Speichers, da VRAM zu einer wichtigen Einschränkung wird.

Der Arbeitsspeicher ist meist die entscheidende Einschränkung. Modellgewichte benötigen Platz, und die Laufzeit braucht zusätzlich Raum, planen Sie also Puffer für das Betriebssystem, Container und alle anderen Dienste ein, die neben der Inferenz laufen. Quantisierung hilft, den Modell-Fußabdruck zu verkleinern, beseitigt aber nicht den Overhead.

Der Speicher entscheidet dann, wie sich das System im Alltag anfühlt. Modellbibliotheken wachsen mit der Zeit, und langsame Festplatten verwandeln Neustarts und Modellwechsel in lange Wartezeiten. Ollama, eine lokale LLM-Laufzeit, merkt an, dass der Modell-Speicher je nach installierten Modellen von einigen zehn bis zu mehreren hundert Gigabyte reichen kann, also platzieren Sie Modelle und Vektorindizes wenn möglich auf schnellem Speicher, idealerweise NVMe.

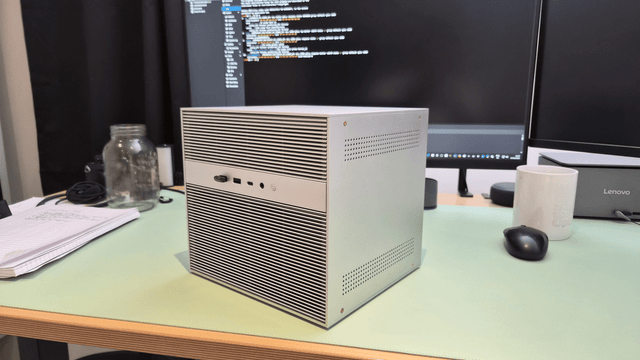

Wenn Sie einen kompakten Server für selbstgehostete Workloads möchten, kann hardwarefreundliche Erweiterbarkeit das Experimentieren erleichtern. Ein Beispiel ist ZimaBoard 2, positioniert als Heimserver mit PCIe-Erweiterung, der Add-ons wie schnelleren Speicher oder Beschleuniger für lokale KI-Workloads unterstützen kann.

Für ein Homelab bedeutet „ausgewogen“ auch wartbar: stabile Kühlung, vorhersehbarer Geräuschpegel und ein Stromverbrauch, der es nicht bestraft, wenn es 24/7 läuft.

Größe, Quantisierung und Kontextlänge: Das richtige Modell auswählen

Wählen Sie das Modell aus, nachdem Sie entschieden haben, was das System gut können muss. Für lokale KI bestimmen drei Faktoren die Erfahrung: Parameteranzahl, Quantisierung und Kontextlänge.

1. Parameteranzahl: Größere Modelle bewältigen in der Regel komplexere Schlussfolgerungen und behalten bei längeren Aufgaben die Kohärenz. Kleinere Modelle können dennoch hervorragend für Zusammenfassungen, Umschreibungen und viele Programmieraufgaben sein, besonders in Kombination mit guten Eingaben und Retrieval.

2. Quantisierung: Quantisierung stellt Modellgewichte mit geringerer Präzision dar, um Speicher- und Rechenkosten zu reduzieren. Dies ist einer der Hauptgründe, warum lokale LLMs auf Consumer-Hardware praktikabel sind. Erwarten Sie einen Kompromiss: geringere Präzision benötigt oft weniger Speicher und kann schneller laufen, kann aber auch die Genauigkeit verringern, besonders bei Randfällen.

3. Kontextlänge: Lange Kontexte klingen verlockend, können aber die Verarbeitung der Eingaben verlangsamen und den Speicherbedarf erhöhen. Ein Modell mit einem enormen Kontextfenster kann sich trotzdem langsam anfühlen, wenn Ihre Hardware Schwierigkeiten bei der Eingabe der Aufforderungen hat.

Praktische Vorgehensweise bei der Auswahl: Behalten Sie ein reaktionsschnelles Tagesmodell, fügen Sie ein zweites nur hinzu, wenn es eine spezifische Lücke schließt, und validieren Sie es mit eigenen Eingaben. Verwenden Sie einen kleinen Testsatz: eine tonkontrollierte Schreibaufforderung, eine Dokumentenfrage, die Zitate erfordert, eine echte Programmieraufgabe und eine mehrdeutige Eingabe, um erfundene Fakten zu überprüfen. Im Homelab ist das beste Modell das, das Sie die ganze Woche ohne Abstürze betreiben können.

Installieren Sie einen einfachen lokalen Stack mit Ollama und einer Weboberfläche

Halten Sie die erste Bereitstellung minimal. Ein Gerät führt die Inferenz aus und stellt eine lokale API bereit, dann greifen Ihre anderen Geräte über das LAN darauf zu. Dieses Setup ist einfach zu debuggen, leicht zu sichern und unkompliziert in einem Homelab zu warten.

Ollama funktioniert gut als Laufzeitumgebung, da es Modell-Downloads, Speicherung und Bereitstellung an einem Ort verwaltet. Planen Sie die Festplatte von Anfang an. Modellbibliotheken wachsen schnell, und es ist üblich, dass installierte Modelle im Laufe der Zeit von zehn bis hunderten Gigabyte an Speicherplatz beanspruchen. Legen Sie das Modellverzeichnis auf einem geräumigen, schnellen Laufwerk ab, idealerweise NVMe, damit das Laden und Wechseln der Modelle nicht zur ständigen Belastung wird.

Ein praktischer Bereitstellungsablauf:

- Installieren Sie Ollama auf dem Gerät, das die Inferenz ausführen wird.

- Laden Sie ein Modell, das in Ihre Speichergrenzen passt.

- Überprüfen Sie eine lokale Anfrage auf demselben Gerät.

- Überprüfen Sie den Zugriff von einem anderen Gerät in Ihrem LAN.

Fügen Sie eine Weboberfläche für Chatverlauf, Sitzungen und grundlegende Steuerungen hinzu.

Für die Schnittstellenebene passt Open WebUI gut, weil es für Self-Hosting gebaut ist, offline läuft und OpenAI-kompatible Chat-APIs unterstützt. Diese API-Kompatibilität ist wichtig, wenn Sie ein lokales Modell mit Editoren, Notiztools und einfachen Skripten verbinden wollen, ohne Ihre Integrationen neu zu gestalten.

Bevor Sie weitere Funktionen hinzufügen, machen Sie die Einrichtung widerstandsfähig:

- Führen Sie Ollama als Dienst aus, der Neustarts überlebt

- Speichern Sie Open WebUI Daten dauerhaft, damit Updates die Konfiguration nicht zurücksetzen

- Behalten Sie den LAN-Zugang nur während der frühen Tests bei

- Schreiben Sie Ports, Pfade und Volumes in eine kurze README

Sobald diese Basis stabil ist, wird das Hinzufügen von RAG und das Verschärfen der Sicherheit einfach.

Fügen Sie RAG hinzu, damit das Modell Ihre Dateien und Notizen nutzen kann

Ein lokales Modell ist leistungsstark, kennt Ihre Dokumente aber nicht automatisch. Copy-Paste funktioniert für einen Absatz, versagt aber bei echten Workflows. RAG, kurz für retrieval augmented generation, behebt das, indem es relevanten Text aus Ihren Dateien abruft und dem Modell als Kontext für jede Antwort bereitstellt.

RAG funktioniert am besten, wenn die Pipeline explizit ist. Das hilft auch beim Datenschutz, da Sie definieren können, welche Quellen erlaubt sind.

Eine typische RAG-Pipeline hat diese klaren Phasen:

- Ingestion: sammeln Dokumente aus genehmigten Ordnern

- Chunking: teilen Text in abfragefreundliche Segmente auf

- Embeddings: repräsentieren Abschnitte als Vektoren

- Indexierung: speichern Vektoren plus Metadaten

- Abfrage: holen die besten Treffer für eine Frage

- Antworten: generieren eine Antwort, die auf abgerufenem Text basiert

- Zitate: zeigen, welche Quellen verwendet wurden

Bevor Sie Automatisierung hinzufügen, entscheiden Sie, wie „gut“ aussieht. Diese Prüfungen machen das RAG-Verhalten leichter auditierbar:

- Antworten enthalten klare Zitate zum genauen Datei- und Abschnittsbereich

- Das System verweigert die Antwort, wenn die Abfrage nichts Relevantes zurückgibt

- Empfindliche Ordner sind standardmäßig ausgeschlossen und werden dann gezielt hinzugefügt

- Der Index-Aktualisierungsprozess ist vorhersehbar und protokolliert

Chunking ist ein häufiger Fehlerpunkt. Wenn die Abschnitte riesig sind, liefert die Abfrage eine Textwand. Wenn die Abschnitte winzig sind, geht der Kontext verloren. Ein guter Kompromiss variiert je nach Dokumenttyp, also testen Sie an Ihren tatsächlichen Dateien und passen Sie dann an. In einem Homelab wird diese Feinabstimmung zu einer einmaligen Investition, die sich jeden Tag auszahlt.

Sichern und warten Sie Ihre privaten KI-Dienste zu Hause

Lokale KI ist immer noch ein Netzwerkdienst, und Netzwerkdienste werden ständig versehentlich exponiert. Eine Portweiterleitung, ein falsch konfigurierter Reverse Proxy oder eine „temporäre“ Regel können einen privaten Endpunkt in einen öffentlichen verwandeln.

Sicherheitsprioritäten, in dieser Reihenfolge:

- Zugriffskontrolle: starke Authentifizierung, minimale Konten, geringste Rechte

- Netzwerkbereich: standardmäßig nur LAN, explizite Regeln für jeden Fernzugriff

- Transportsicherheit: TLS für alles, was den localhost verlässt

- Geheimnishygiene: Vermeiden Sie das Hardcodieren von Schlüsseln in Konfigurationen und Logs

- Patch-Disziplin: regelmäßige Updates für Betriebssystem, Container und Web-UI

- Backups und Wiederherstellungen: Backups sind erst nach einem Wiederherstellungstest echt

Für den Fernzugriff bevorzugen Sie ein VPN oder einen vertrauenswürdigen Tunnel gegenüber offenen Ports. Wenn Sie einen Reverse Proxy betreiben, halten Sie ihn hinter Authentifizierung und Ratenbegrenzungen gesperrt. Das entspricht den OWASP-API-Sicherheitsrichtlinien, die wiederholt fehlerhafte Authentifizierung und Autorisierung als häufige Fehlerquellen in realen Systemen hervorheben.

Wartung ist das, was eine Wochenend-Demo von einem verlässlichen privaten Assistenten unterscheidet. Eine leichte Routine funktioniert gut:

- Wöchentlich: Festplattenwachstum für Modell-Dateien und Indizes prüfen

- Monatlich: Updates anwenden und während eines wenig belasteten Zeitfensters neu starten

- Vierteljährlich: Backups überprüfen, Zugangsdaten rotieren, exponierte Dienste überprüfen

Behandeln Sie Ihren lokalen KI-Stack wie jeden anderen Kernservice in Ihrem Homelab. Diese Einstellung reduziert Ängste und hält das Datenschutzversprechen ein.

Bringen Sie Ihr privates KI-Homelab noch heute online!

Um private künstliche Intelligenz zu Hause praktisch zu machen, konzentrieren Sie sich auf ruhige Zuverlässigkeit. Streben Sie nach stetiger Leistung, stabilen Kosten und Datenschutzgrenzen. Führen Sie ein großes Sprachmodell lokal aus, fügen Sie eine einfache Schnittstelle hinzu und beschränken Sie den Zugriff auf die Geräte und Personen, denen Sie vertrauen. Verbessern Sie dann basierend auf der tatsächlichen Nutzung, z. B. schnelleren Speicher für schnelleres Laden, stärkere Sicherheit oder RAG für eine kleine Dokumentensammlung. Bauen Sie ein Homelab-Setup auf, auf das Sie sich verlassen können, und lassen Sie Ihre lokale KI ab heute ihren Platz in Ihrem täglichen Workflow verdienen!

FAQs

F1: Kann ich ein lokales LLM auf einem stromsparenden Mini-Server im Homelab betreiben?

Ja, in vielen Fällen, besonders für leichtere Schreibaufgaben und kurze Eingaben. Erwarten Sie langsamere Antworten auf CPU-only-Systemen und wählen Sie kleinere oder stärker quantisierte Modelle. Für eine flüssigere tägliche Nutzung planen Sie ausreichend RAM und schnellen NVMe-Speicher ein, um Ladeverzögerungen zu reduzieren.

F2: Funktioniert lokale KI auf meinem Laptop und integriert sich trotzdem in meine Homelab-Dienste?

Ja, oft. Sie können das Modell lokal auf einem Laptop für unterwegs ausführen und Ihre Tools dann wieder auf einen Homelab-Endpunkt zu Hause richten, wenn Sie im LAN oder VPN sind. Halten Sie die Konfigurationen einfach, indem Sie ein konsistentes lokales API-Muster und eine Schnittstelle verwenden.

F3: Brauche ich Internetzugang, um selbstgehostete KI nach der Einrichtung zu nutzen?

Nein, nicht für einfache Inferenz, sobald die Laufzeit und Modelle installiert sind. Einige Funktionen können jedoch weiterhin von Netzwerkdiensten abhängen, wie dem Herunterladen neuer Modelle, dem Aktualisieren von Containern oder dem Synchronisieren von Dokumenten. Für einen echten Offline-Workflow laden Sie Modelle im Voraus herunter und halten Sie lokale Dokumentation und Einbettungen auf Ihrem Homelab-Speicher.

F4: Wie verhindere ich, dass mein lokaler Chatbot private Daten an andere Nutzer weitergibt?

Verwenden Sie separate Konten und strenge Berechtigungen pro Arbeitsbereich oder Datensatz. Beschränken Sie Abrufquellen auf bestimmte Ordner und vermeiden Sie das Indizieren gemeinsamer Home-Verzeichnisse. Auch das Logging ist wichtig. Halten Sie Protokolle minimal und überprüfen Sie sie auf sensible Inhalte. In einem Mehrbenutzer-Homelab isolieren Sie Dienste mit Containern und Netzwerkrichtlinien.

F5: Wie kann ich den Speicherbedarf für lokale LLMs und die Dokumentensuche vernünftig abschätzen?

Planen Sie für Wachstum. Ein oder zwei Modelle passen vielleicht bequem, aber Sammlungen wachsen schnell. Betrachten Sie Zehntausende Gigabyte als Ausgangspunkt und fügen Sie dann Platz für mehrere Modelle, Cache-Dateien und einen Abrufindex für Ihre Dokumente hinzu. NVMe verbessert die Leistung, während größere HDDs Archive speichern können.

Zima Kampagnen-Zentrale

Mehr zum Lesen

ZimaCube Home-Lab-Überwachungsleitfaden: Von Uptime Kuma bis zu KI-Agenten

Überwachen Sie Ihren Heimserver mit Uptime Kuma, Pulse, Proxmox Data Center Manager oder einem KI-Agenten, um die Betriebszeit, Backups, VMs, Warnungen zu verfolgen und...

Von der Sparcstation zum ZimaBlade: Die Self-Hosting-Reise eines 57-jährigen Geek

Ein französischer Verwaltungsfachmann ersetzte seinen ausgefallenen Raspberry Pi 4 durch einen ZimaBlade 7700, der Debian 13, XFS und BorgBackup verwendet. Der vollständige Backup-Server wurde...

ZimaCube vs. DIY-NAS: Was passt besser zu Ihnen?

Fertiges NAS oder DIY? Wir analysieren die tatsächlichen Kosten, die Einrichtungszeit, Thunderbolt 4 und die Wartungsunterschiede, um Ihnen zu helfen, herauszufinden, welche Lösung wirklich...