L'IA dans le cloud peut sembler sans effort jusqu'à ce qu'elle touche quelque chose que vous ne voudriez jamais télécharger volontairement. Fichiers clients, notes privées, documents internes, photos de famille, même des brouillons mènent tous à la même question : qui d'autre peut voir cela ? Faire tourner un grand modèle de langage localement garde ce contenu sur un matériel que vous contrôlez, tout en offrant la rapidité et la commodité attendues de l'IA moderne.

Une configuration locale ne gagne la confiance que si elle reste fiable. Cela signifie des coûts prévisibles, un accès hors ligne quand vous en avez besoin, et un système que vous pouvez maintenir comme n'importe quel autre service. Pour beaucoup, un homelab est le lieu naturel pour l'IA privée car il fonctionne déjà selon des habitudes qui maintiennent la stabilité : limites claires, sauvegardes et paramètres par défaut raisonnables.

Choisissez votre cas d'utilisation d'IA locale et vos indicateurs de succès

L'IA locale fonctionne mieux lorsqu'elle a une tâche claire. Décidez ce que vous voulez que le modèle fasse le plus souvent, car ce choix unique détermine tout le reste : taille du modèle, besoins en mémoire, organisation du stockage et outils que vous installez.

La plupart des configurations homelab suivent quelques schémas répétables :

- Assistant d'écriture privé pour les e-mails, notes, résumés et réécritures

- Soutien au codage pour expliquer le code, générer des tests et rédiger des refontes

- Questions-réponses sur documents à travers manuels, PDF, notes et bases de connaissances

- Productivité hors ligne lorsque la connectivité est limitée, ou si vous préférez un flux de travail isolé

- Opérations domestiques comme les projets à la maison, les garanties et les inventaires

Choisissez deux ou trois mesures pour pouvoir identifier ce qui fonctionne et ce qui doit être corrigé :

| Métrique | Ce que cela signifie en pratique | Comment le mesurer |

| Réactivité | Les réponses arrivent assez vite pour maintenir le flux | Chronométrez vos invites courantes |

| Qualité de sortie | Moins d'affirmations erronées et meilleure structure | Comparez les réponses sur un petit ensemble de tests |

| Limite de confidentialité | Seules les sources approuvées apparaissent dans les réponses | Vérifiez les citations et la portée de récupération |

| Fiabilité | Le service reste opérationnel et se rétablit proprement | Test de redémarrage, test de mise à jour, test de restauration |

| Contrôle des coûts | Pas de factures surprises, consommation électrique stable | Suivez la consommation d'énergie et les dépenses matérielles |

Construisez une base matérielle équilibrée pour l'inférence locale

La sélection du matériel est plus simple qu'il n'y paraît lorsque vous vous concentrez sur l'essentiel. L'inférence locale est un équilibre entre calcul, mémoire et stockage, façonné par votre flux de travail et vos attentes. Deux grandes voies existent :

1. Inférence centrée sur le CPU : Cela peut parfaitement fonctionner pour les modèles plus petits et pour des tâches en arrière-plan comme l’indexation de documents. Cela peut sembler lent pour des conversations longues et interactives, surtout avec des fenêtres de contexte plus larges.

2. Inférence accélérée : Un GPU dédié ou un autre accélérateur améliore généralement la vitesse de génération et rend les modèles plus grands viables pour un usage quotidien. Cela change aussi la façon de penser la mémoire, puisque la VRAM devient une contrainte clé.

La mémoire est généralement la contrainte décisive. Les poids des modèles prennent de la place, et le runtime a besoin d’espace supplémentaire, donc prévoyez une marge pour le système d’exploitation, les conteneurs et tout autre service fonctionnant en parallèle à l’inférence. La quantification aide à réduire l’empreinte du modèle, mais elle n’élimine pas la surcharge.

Le stockage détermine ensuite la fluidité du système au quotidien. Les bibliothèques de modèles s’agrandissent avec le temps, et les disques lents transforment les redémarrages et changements de modèles en longues attentes. Ollama, un runtime local pour LLM, note que le stockage des modèles peut atteindre des dizaines à des centaines de gigaoctets selon ce que vous gardez installé, donc placez les modèles et les index vectoriels sur un stockage rapide quand vous le pouvez, idéalement NVMe.

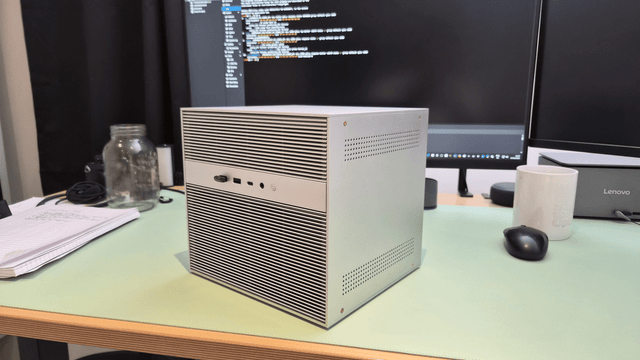

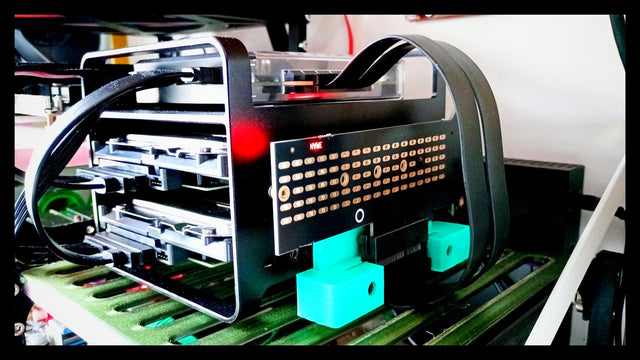

Si vous voulez un serveur compact conçu pour des charges de travail auto-hébergées, un matériel compatible avec l’extension peut simplifier les expérimentations. Un exemple est ZimaBoard 2, positionné comme un serveur domestique avec extension PCIe pouvant supporter des ajouts comme un stockage plus rapide ou des accélérateurs pour des charges d’IA locales.

Pour un homelab, « équilibré » signifie aussi maintenable : refroidissement stable, bruit prévisible et profil énergétique qui ne vous pénalise pas pour une utilisation 24/7.

Taille, quantification et longueur du contexte : choisir le bon modèle

Choisissez le modèle après avoir décidé ce que le système doit bien faire. Pour l'IA locale, trois facteurs déterminent l'expérience : le nombre de paramètres, la quantification et la longueur du contexte.

1. Nombre de paramètres : Les modèles plus grands gèrent généralement un raisonnement plus complexe et maintiennent la cohérence sur des tâches plus longues. Les modèles plus petits peuvent toujours être excellents pour la synthèse, la réécriture et de nombreuses tâches de codage, surtout lorsqu'ils sont associés à de bonnes invites et à la récupération d'informations.

2. Quantification : La quantification représente les poids du modèle à une précision plus faible pour réduire les coûts en mémoire et en calcul. C'est l'une des principales raisons pour lesquelles les LLM locaux sont pratiques sur du matériel grand public. Attendez-vous à un compromis : une précision plus faible fonctionne souvent avec une mémoire plus restreinte et peut être plus rapide, mais elle peut aussi réduire la précision, surtout sur les cas limites.

3. Longueur du contexte : Un contexte long semble attrayant, mais il peut ralentir le traitement des invites et augmenter la pression sur la mémoire. Un modèle avec une fenêtre de contexte énorme peut toujours sembler lent si votre matériel a du mal à ingérer les invites.

Méthode pratique pour choisir : gardez un modèle quotidien réactif, ajoutez un second seulement s'il comble un besoin spécifique, puis validez avec vos propres invites. Utilisez un petit ensemble de tests : une invite d'écriture avec ton contrôlé, une question sur un document nécessitant des citations, une tâche de codage réelle, et une invite ambiguë pour vérifier les faits inventés. Dans un homelab, le meilleur modèle est celui que vous pouvez faire tourner toute la semaine sans plantage.

Installez une pile locale simple avec Ollama et une interface web

Gardez le premier déploiement minimal. Une machine exécute l'inférence et expose une API locale, puis vos autres appareils y accèdent via le réseau local. Cette configuration est facile à déboguer, simple à sécuriser et facile à maintenir dans un homelab.

Ollama fonctionne bien comme environnement d'exécution car il gère les téléchargements, le stockage et la diffusion des modèles en un seul endroit. Prévoyez de l'espace disque dès le premier jour. Les bibliothèques de modèles grossissent rapidement, et il est courant que les modèles installés occupent des dizaines à des centaines de gigaoctets au fil du temps. Placez le répertoire des modèles sur un volume spacieux et rapide, idéalement NVMe, pour que le chargement et le changement de modèles ne deviennent pas une source constante de frustration.

Un flux de déploiement pratique :

- Installez Ollama sur la machine qui exécutera l'inférence.

- Choisissez un modèle qui correspond à vos limites de mémoire.

- Vérifiez une requête locale sur la même machine.

- Vérifiez l'accès depuis un autre appareil sur votre réseau local.

Ajoutez une interface web pour l'historique des discussions, les sessions et les contrôles de base.

Pour la couche interface, Open WebUI convient bien car il est conçu pour l’auto-hébergement, fonctionne hors ligne et prend en charge les API de chat compatibles OpenAI. Cette compatibilité API est importante lorsque vous souhaitez connecter un modèle local à des éditeurs, outils de notes et scripts simples sans revoir vos intégrations.

Avant d’ajouter plus de fonctionnalités, rendez la configuration résiliente :

- Exécutez Ollama comme un service qui survit aux redémarrages

- Conservez les données de Open WebUI pour que les mises à jour ne réinitialisent pas la configuration

- Limitez l’accès au LAN uniquement pendant les premiers tests

- Notez les ports, chemins et volumes dans un court README

Une fois cette base stable, ajouter RAG et renforcer la sécurité devient simple.

Ajoutez RAG pour permettre au modèle d’utiliser vos fichiers et notes

Un modèle local est puissant, mais il ne connaît pas automatiquement vos documents. Copier-coller fonctionne pour un paragraphe, puis échoue pour des flux de travail réels. RAG, abréviation de retrieval augmented generation, résout ce problème en récupérant le texte pertinent de vos fichiers et en le fournissant au modèle comme contexte pour chaque réponse.

RAG fonctionne mieux lorsque le pipeline est explicite. Cela aide aussi à la confidentialité, car vous pouvez définir quelles sources sont autorisées.

Un pipeline RAG typique comporte ces étapes distinctes :

- Ingestion : collecter les documents depuis les dossiers approuvés

- Découpage : diviser le texte en segments adaptés à la récupération

- Représentations vectorielles : représenter les segments sous forme de vecteurs

- Indexation : stocker les vecteurs ainsi que les métadonnées

- Récupération : extraire les meilleures correspondances pour une question

- Réponse : générer une réponse fondée sur le texte récupéré

- Citations : montrer quelles sources ont été utilisées

Avant d’ajouter toute automatisation, décidez à quoi ressemble un résultat « bon ». Ces vérifications facilitent l’audit du comportement RAG :

- Les réponses incluent des citations claires vers le fichier et la section exacts

- Le système refuse de répondre lorsque la récupération ne renvoie rien de pertinent

- Les dossiers sensibles sont exclus par défaut, puis ajoutés intentionnellement

- Le processus de rafraîchissement de l’index est prévisible et journalisé

Le découpage en segments est un point de défaillance courant. Si les segments sont énormes, la récupération renvoie un mur de texte. Si les segments sont minuscules, le contexte se perd. Un bon compromis varie selon le type de document, alors testez sur vos fichiers réels, puis ajustez. Dans un homelab, cet ajustement devient un investissement unique qui rapporte chaque jour.

Sécurisez et maintenez vos services d'IA privée à la maison

L'IA locale est toujours un service réseau, et les services réseau sont souvent exposés accidentellement. Un transfert de port, un proxy inverse mal configuré ou une règle « temporaire » peut transformer un point d'accès privé en un point public.

Priorités de sécurité, dans l'ordre :

- Contrôle d'accès : authentification forte, comptes minimaux, moindre privilège

- Portée réseau : LAN uniquement par défaut, règles explicites pour tout accès à distance

- Sécurité des transports : TLS pour tout ce qui sort du localhost

- Hygiène des secrets : évitez de coder en dur les clés dans les configurations et les journaux

- Discipline des correctifs : mises à jour régulières pour le système d'exploitation, les conteneurs et l'interface web

- Sauvegardes et restaurations : les sauvegardes ne sont réelles qu'après un test de restauration

Pour l'accès à distance, préférez un VPN ou un tunnel de confiance plutôt que des ports ouverts. Si vous utilisez un proxy inverse, gardez-le verrouillé derrière une authentification et des limites de débit. Cela correspond aux recommandations de sécurité API de style OWASP, qui soulignent à plusieurs reprises que l'authentification et l'autorisation défaillantes sont des modes d'échec courants dans les systèmes réels.

La maintenance est ce qui distingue une démonstration de week-end d'un assistant privé fiable. Une routine légère fonctionne bien :

- Hebdomadaire : vérifiez la croissance des disques pour les fichiers de modèles et les index

- Mensuel : appliquez les mises à jour et redémarrez pendant une période à faible impact

- Trimestriel : vérifiez les sauvegardes, changez les identifiants, passez en revue les services exposés

Considérez votre pile d'IA locale comme n'importe quel autre service central dans votre homelab. Cette approche réduit l'anxiété et maintient la promesse de confidentialité intacte.

Mettez votre homelab d'IA privée en ligne dès aujourd'hui !

Pour rendre l'intelligence artificielle privée pratique à la maison, concentrez-vous sur une fiabilité calme. Visez une performance stable, des coûts maîtrisés et des limites claires en matière de confidentialité. Faites fonctionner un grand modèle de langage localement, ajoutez une interface simple et limitez l'accès aux appareils et aux personnes de confiance. Ensuite, améliorez-le en fonction de l'utilisation réelle, comme un stockage plus rapide pour un chargement accéléré, une sécurité renforcée ou le RAG pour un petit ensemble de documents. Construisez une configuration homelab sur laquelle vous pouvez compter, et laissez votre IA locale gagner sa place dans votre flux de travail quotidien dès aujourd'hui !

FAQ

Q1 : Puis-je exécuter un LLM local sur un mini serveur basse consommation dans un homelab ?

Oui, dans de nombreux cas, surtout pour des tâches d'écriture légères et des invites courtes. Attendez-vous à des réponses plus lentes sur des systèmes CPU uniquement, et choisissez des modèles plus petits ou plus fortement quantifiés. Si vous souhaitez une utilisation quotidienne plus fluide, prévoyez suffisamment de RAM et un stockage NVMe rapide pour réduire les délais de chargement.

Q2 : L'IA locale fonctionnera-t-elle sur mon ordinateur portable tout en s'intégrant à mes services homelab ?

Oui, souvent. Vous pouvez exécuter le modèle localement sur un ordinateur portable lors de vos déplacements, puis rediriger vos outils vers un point d'accès homelab à la maison lorsque vous êtes sur votre LAN ou VPN. Gardez les configurations simples en utilisant un modèle d'API locale cohérent et une seule interface.

Q3 : Ai-je besoin d'accès internet pour utiliser l'IA auto-hébergée après la configuration ?

Non, pas pour l'inférence basique une fois le runtime et les modèles installés. Certaines fonctionnalités peuvent encore dépendre de services réseau, comme le téléchargement de nouveaux modèles, la mise à jour des conteneurs, ou la synchronisation des documents. Pour un vrai workflow hors ligne, téléchargez les modèles à l'avance et conservez la documentation locale ainsi que les embeddings sur votre stockage homelab.

Q4 : Comment empêcher mon chatbot local de divulguer des données privées à d'autres utilisateurs ?

Utilisez des comptes séparés et des permissions strictes par espace de travail ou ensemble de données. Limitez les sources de récupération à des dossiers spécifiques, et évitez d'indexer les répertoires partagés du domicile. La journalisation est également importante. Gardez les logs au minimum et vérifiez-les pour détecter des contenus sensibles. Dans un homelab multi-utilisateurs, isolez les services avec des conteneurs et des règles réseau.

Q5 : Quelle est une méthode raisonnable pour estimer les besoins de stockage pour les LLM locaux et la recherche documentaire ?

Planifiez la croissance. Un ou deux modèles peuvent suffire, mais les collections s'élargissent rapidement. Considérez des dizaines de gigaoctets comme point de départ, puis ajoutez de l'espace pour plusieurs modèles, des fichiers cache, et un index de récupération pour vos documents. Le NVMe améliore les performances, tandis que des disques durs plus grands peuvent contenir des archives.

Centre de campagne Zima

À lire aussi

Guide de surveillance du laboratoire domestique ZimaCube : de Uptime Kuma aux agents IA

Surveillez votre serveur domestique avec Uptime Kuma, Pulse, Proxmox Data Center Manager ou un agent IA pour suivre le temps de fonctionnement, les sauvegardes,...

De Sparcstation à ZimaBlade : le parcours d’auto-hébergement d’un geek de 57 ans

Un professionnel administratif français a remplacé son Raspberry Pi 4 défaillant par un ZimaBlade 7700, fonctionnant sous Debian 13, XFS et BorgBackup. La construction...

ZimaCube vs NAS DIY : Lequel vous convient le mieux ?

NAS préconstruit ou bricolé ? Nous décomposons les coûts réels, le temps d'installation, Thunderbolt 4 et les différences de maintenance pour vous aider à...