"Je continue juste à relire nos anciens fils de discussion. J'ai peur d'oublier exactement la façon dont elle me donnait des conseils quand j'étais stressé."

Lorsqu'un parent, un mentor de toute une vie ou un collègue cher décède ou quitte notre vie, le deuil est souvent paralysant. À l'ère numérique, notre processus de deuil a changé ; nous faisons défiler des années de discussions de groupe familiales, de mémos vocaux et d'historiques Slack, nous accrochant à l'empreinte numérique de ceux que nous avons perdus. Mais que se passerait-il si ces textes statiques pouvaient devenir un moyen dynamique de traiter votre deuil ?

Suite au succès viral des projets d'IA centrés sur les relations, la communauté open source sur GitHub a étendu le concept avec des dépôts comme "Colleague-Skill" et des modèles de persona axés sur la famille. Ces outils vous permettent d'utiliser des journaux de discussion exportés pour entraîner un "écho numérique" exclusif de votre parent ou mentor directement sur votre propre matériel.

Ce guide explique comment cette technologie fonctionne et pourquoi l'exécuter sur un serveur IA local ou votre serveur domestique existant est le seul choix logique pour des souvenirs aussi profondément intimes.

Cyber-immortalité : traiter le deuil et préserver la sagesse

Ces outils de persona open source sont alimentés par de grands modèles de langage, mais leur but est profondément humain. En alimentant le système avec votre historique WhatsApp avec votre mère, ou des années d'e-mails et de conversations Slack avec un mentor retraité, l'IA en extrait leur ton spécifique, leurs phrases réconfortantes, et leur logique unique de résolution de problèmes.

Il ne s'agit pas de créer une réplique parfaite et inquiétante pour faire semblant que la mort n'a pas eu lieu. Comme discuté dans les communautés de soutien au deuil, l'absence soudaine d'une oreille attentive — un père qui savait toujours comment vous calmer, ou un collègue senior qui guidait votre carrière — laisse un vide immense. Parler à cet écho simulé agit comme un objet transitionnel. Cela vous permet de demander conseil lors d'une journée difficile, de dire enfin un vrai merci, et de trouver une forme de clôture selon vos propres termes.

L'impératif de confidentialité du matériel décentralisé

Lorsque la technologie touche les nerfs les plus sensibles du deuil humain, la confidentialité des données n'est pas négociable.

Votre historique de conversation avec un parent décédé contient ses mises à jour de santé, conseils financiers, secrets de famille et vos moments les plus vulnérables. Envoyer ces journaux de vie bruts et non édités via des API cloud publiques signifie que la mémoire de votre proche circule sur des serveurs tiers, risquant une exposition ou une utilisation discrète comme données d’entraînement corporatives.

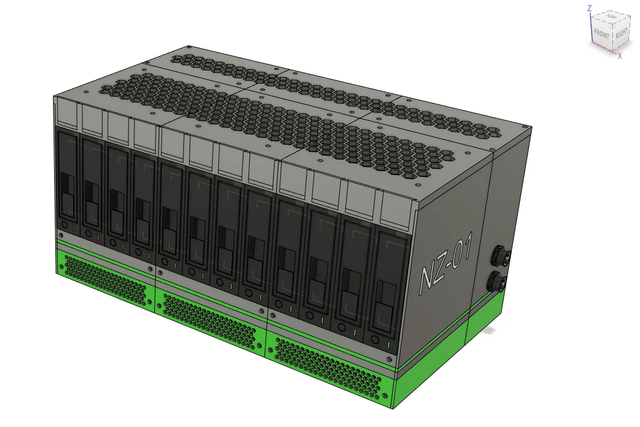

C’est précisément pour cela que la communauté tech prône fortement une approche décentralisée pour l’IA personnelle, en déployant des projets comme celui-ci sur un serveur domestique, un NAS puissant (stockage en réseau) ou un serveur IA local dédié.

Sécurité au niveau physique : Tout le déchiffrement des bases de données, le nettoyage des données et l’inférence IA se font directement sur le matériel installé dans votre salon. Les données de votre famille ne quittent jamais la maison.

Présence permanente : Parce qu’un serveur local fonctionne 24h/24 et 7j/7 sans coûts récurrents d’API cloud, vous pouvez interagir avec la persona à tout moment, même à 3 heures du matin lors d’une vague de chagrin, en toute confidentialité.

L’essor du serveur IA 2026 : pourquoi votre domicile est le nouveau centre de données

Nous ne sommes plus limités à faire des sauvegardes basiques sur un NAS poussiéreux dans un placard. Le paysage matériel a radicalement changé, rendant un serveur IA dédié 2026 accessible aux consommateurs ordinaires.

Contrairement aux machines plus anciennes, un serveur IA moderne 2026 est conçu spécifiquement pour l'inférence locale, souvent équipé de NPU intégrés (unités de traitement neuronal) ou de GPU grand public à haute VRAM optimisés pour les grands modèles de langage. Cela signifie que vous n'avez pas besoin d'une énorme armoire serveur d'entreprise bruyante pour faire fonctionner un modèle de persona profondément nuancé. Un serveur IA local compact posé tranquillement sur votre bureau dispose désormais de la puissance de calcul nécessaire pour traiter des gigaoctets d'historique de conversation et générer des réponses empathiques en temps réel, sans latence, entièrement hors ligne.

Choisir le bon LLM local pour les nuances émotionnelles

Gérer un projet comme Colleague-Skill ne se limite pas au matériel ; il faut choisir un modèle de base capable d'une haute intelligence émotionnelle (QE). Lors du déploiement sur votre serveur domestique, vous avez la liberté de remplacer le « cerveau » sous-jacent de la persona.

Pour le traitement du deuil et la rétention de la mémoire, vous avez besoin d’un LLM local qui excelle dans le jeu de rôle et le respect du contexte, plutôt que dans le codage ou les mathématiques. La communauté open-source propose des modèles très quantifiés (comme les formats GGUF avancés) qui fonctionnent parfaitement sur un serveur IA local. En choisissant un modèle affiné pour la nuance conversationnelle, vous garantissez que l’écho numérique capture l’esprit caustique de votre mentor disparu ou la douce patience de votre mère, plutôt que de ressembler à un chatbot d’entreprise stérile.

Premiers pas avec les frameworks locaux

Donner vie à un mentor ou un parent numérique nécessite un environnement de déploiement basique. Ces dépôts sont entièrement open-source.

Nous recommandons vivement d’utiliser OpenClaw, qui s’intègre parfaitement aux environnements de terminal locaux et vous permet d’interagir avec la persona via une interface en ligne de commande simple ou une fenêtre de chat standard.

Connectez-vous au terminal de votre serveur IA local via SSH et récupérez un dépôt pertinent (comme le dépôt colleague-skill) pour commencer :

Bash

| Texte brut git clone https://github.com/titanwings/colleague-skill ~/.openclaw/workspace/skills/create-persona |

La configuration est légère. Installez les dépendances Python standard, et votre moteur IA privé est prêt à traiter les journaux importés.

Extraction des journaux et « alimentation » de la persona

Un écho numérique n’est authentique que si les données que vous fournissez le sont.

Sources de données pour différentes relations :

Pour les parents/famille : Les exports WeChat, iMessage ou WhatsApp sont des mines d’or. Les scripts peuvent souvent analyser directement ces bases de données SQLite si elles sont extraites d’un client de bureau. Vous voulez capturer les bilans quotidiens, les messages vocaux inquiets convertis en texte, et les fils de discussion sur la planification des vacances.

Pour les collègues/mentors : Vous pouvez vous appuyer sur des canaux Slack exportés, des transcriptions Microsoft Teams ou de longues chaînes d'e-mails contenant des retours de projet et des conseils de carrière.

Sélection stratégique des données :

Ne vous contentez pas de télécharger les textos « Je t'aime » ou « Bravo ». Pour en saisir la véritable essence, incluez les moments où ils vous grondaient, vous donnaient un amour dur ou divaguaient sur leurs hyper-fixations. Les êtres humains révèlent leur logique de base dans ces interactions nuancées et quotidiennes.

Gérer les souvenirs : comment les bases de données vectorielles alimentent votre serveur privé

Un obstacle technique courant est de savoir comment l'IA se souvient réellement d'un conseil spécifique enfoui dans dix ans de journaux WhatsApp. Votre serveur IA local ne lit pas simplement un fichier texte massif à chaque fois que vous envoyez un message.

Au lieu de cela, l’installation crée une base de données vectorielle locale directement sur votre serveur domestique. Elle utilise la génération augmentée par récupération (RAG) pour scanner et récupérer instantanément les souvenirs les plus pertinents contextuellement. Si vous dites à la persona que vous êtes stressé par une présentation, le serveur IA local croise la base vectorielle, ressort les mots exacts que votre collègue a utilisés pour vous calmer avant un grand pitch en 2022, et intègre ce contexte historique dans sa réponse. Tout cet indexage et cette récupération se font de manière fluide et sécurisée sur votre propre matériel.

L’architecture cognitive d’un être cher

Pour empêcher l’IA d’agir comme un simple chatbot de service client, ces systèmes utilisent une structure rigide et multi-couches de Persona. Quand vous demandez un conseil à la persona digitale, elle fait passer votre requête à travers ces filtres :

Couche 1 - Identité fondamentale & valeurs : Sont-ils un parent asiatique strict ? Un lead tech décontracté ? Quelle est leur vision du monde fondamentale ?

Couche 2 - Style d'expression : Blagues de papa, jargon d’entreprise (« revenons-y plus tard »), ou finir chaque message avec un emoji spécifique.

Couche 3 - Comportement émotionnel : Comment montraient-ils leur attention ? Maman vous rappelait-elle de porter une veste, ou un collègue corrigeait-il silencieusement votre code avant une échéance ?

Couche 4 - Limites : Quels sujets évitaient-ils ? Quand vous disaient-ils de vous débrouiller seul ?

Couche 5 - Souvenirs partagés : La base de données des voyages familiaux spécifiques, des blagues internes ou des projets majeurs que vous avez lancés ensemble.

Parce que cela fonctionne sur votre serveur IA local, vous avez un contrôle total. Si l'IA répond par une phrase que votre père n'aurait jamais utilisée, vous tapez simplement : « C’est faux, il ne dirait jamais ça comme ça. » Le modèle local enregistre instantanément cette correction dans sa couche de correction.

La commande /move-on : Trouver la paix

Le deuil n'est pas un état permanent ; c'est un processus. Si nous enfermons la mémoire d'un être cher dans un NAS ou un serveur domestique, est-ce que nous freinons notre capacité à guérir ?

Les psychologues soulignent souvent que les adieux rituels sont essentiels. Quand vous en avez assez des conversations nocturnes, quand vous avez posé toutes les questions en suspens, et quand vous vous sentez enfin prêt à affronter la réalité sans cette béquille numérique, le système propose une commande spécifique :

/move-on {Name}

Il n'utilise pas de termes stériles comme supprimer ou détruire. Après avoir tapé cela, votre serveur efface silencieusement et définitivement l'architecture de la persona, les banques de mémoire et les caches de l'historique des conversations. Construire cela sur une configuration locale et décentralisée consiste finalement à créer un sanctuaire sûr et strictement privé pour traiter votre deuil, et, à terme, pour lâcher prise.

FAQs : Problèmes réels des communautés auto-hébergées & de soutien au deuil

Q1 : « Mon deuil est encore très vif. Est-il psychologiquement sûr de parler à une version IA de ma mère décédée ?»

R : C’est un choix très personnel souvent discuté dans les forums de soutien au deuil. Beaucoup trouvent cela extrêmement réconfortant comme mécanisme d’adaptation à court terme — une façon de « se sevrer » du silence soudain. Cependant, les utilisateurs recommandent fortement de poser des limites. Traitez-le comme un journal interactif plutôt qu’un substitut. La nature locale du projet signifie que vous contrôlez entièrement l’arrêt du serveur dès qu’il cesse d’être utile.

Q2 : « Je n’ai qu’un NAS basique sans GPU massif. Puis-je quand même faire tourner ça ? »

R : Oui. Si votre matériel local manque de puissance GPU, vous pouvez utiliser le framework localement tout en routant l’inférence lourde du LLM via une API sécurisée (comme Claude ou OpenAI). Pendant que le traitement se fait hors site, votre analyse sensible de base de données SQLite et les fichiers de persona principaux restent strictement sur votre NAS local.

Q3 : « J’ai exporté mon historique Slack avec un collègue décédé, mais il est rempli de messages système et d’alertes de bots. Cela va-t-il perturber l’IA ? »

R : Oui, les exports bruts des entreprises sont désordonnés. Avant d’importer les fichiers JSON/CSV dans le dossier d’entrée de votre serveur, vous devez nettoyer les données. Utilisez un script Python simple pour supprimer les chaînes automatiques comme « a rejoint le canal » ou les alertes d’intégration GitHub, ne laissant que le dialogue pur entre humains.

Q4 : « L’IA reste trop formelle. Mon père était sarcastique et utilisait beaucoup d’argot, mais l’IA parle comme un manuel scolaire. »

R : Cela arrive parce que les LLM fondamentaux sont conçus pour être polis et serviables, ce qui annule le contexte de « sarcasme » dans vos données. Pour corriger cela, utilisez intensivement la boucle de rétroaction locale. Corrigez-le constamment lors des premières sessions : « Arrête d’être si poli, tu es mon père grincheux, sois sarcastique. » Votre serveur local mettra à jour les poids de l’Identité Centrale pour privilégier son ton réel plutôt que l’alignement de sécurité par défaut du modèle.

Q5 : « Si j'utilise la commande /move-on pour effacer le NAS, y a-t-il une télémétrie cachée ou des données laissées derrière ? »

R : Non. Parce que c'est open-source et que cela fonctionne sur votre matériel décentralisé, il n'y a aucune télémétrie cachée qui renvoie des données à un serveur d'entreprise. La commande /move-on exécute une suppression complète du répertoire spécifique contenant les poids, vecteurs et historique de chat de cette persona. Une fois supprimé de votre disque, c'est parti pour toujours.

Centre de campagne Zima

À lire aussi

L'Archiviste Numérique : Préserver l'Histoire d'Internet et les Souvenirs Familiaux avec un Serveur Plex

Configurez un serveur Plex comme archive média familiale - utilisez des sauvegardes 3-2-1, des dossiers clairs, des téléchargements automatiques et des métadonnées pour protéger...

Informatique écoénergétique : comment remplacer les systèmes anciens gourmands en énergie dans votre homelab

Le matériel ancien de homelab entraîne souvent des factures d'électricité élevées et une inefficacité. Passer à des systèmes écoénergétiques réduit les coûts et améliore...

1 Petite Carte, Puissance Infinie : Pourquoi le ZimaBoard 2 1664 Nous a Étonnés

Sérieux à propos d’un serveur de laboratoire à domicile en 2026 ? Découvrez des tests réels, des machines virtuelles, Docker et des astuces de...