"Jag fortsätter bara att läsa våra gamla sms-trådar. Jag är livrädd för att glömma exakt hur hon brukade ge mig råd när jag var stressad."

När en förälder, en livslång mentor eller en älskad kollega går bort eller lämnar våra liv är sorgen ofta förlamande. I den digitala tidsåldern har vår sorgeprocess förändrats; vi bläddrar igenom år av familjegruppchattar, röstmeddelanden och Slack-historik och håller fast vid den digitala fotavtrycket av dem vi förlorat. Men tänk om dessa statiska texter kunde bli ett dynamiskt sätt att bearbeta din sorg?

Efter den virala framgången för relationfokuserade AI-projekt har open source-gemenskapen på GitHub utökat konceptet med arkiv som "Colleague-Skill" och familjefokuserade personamodeller. Dessa verktyg låter dig använda exporterade chattloggar för att träna ett exklusivt "digitalt eko" av din förälder eller mentor direkt på din egen hårdvara.

Denna guide förklarar hur denna teknik fungerar och varför det enda logiska valet för så personliga minnen är att köra den på en lokal AI-server eller din befintliga hemserver.

Cyber-odödlighet: Bearbeta sorg och bevara visdom

Dessa open source-personaverktyg drivs av stora språkmodeller, men deras syfte är djupt mänskligt. Genom att mata systemet med din WhatsApp-historik med din mamma, eller år av e-post och Slack-trådar med en pensionerad mentor, extraherar AI:n deras specifika ton, deras tröstande fraser och deras unika problemlösningslogik.

Det handlar inte om att skapa en kuslig, perfekt kopia för att låtsas som att döden inte har inträffat. Som diskuterats i stödgrupper för sorg lämnar den plötsliga frånvaron av en samtalspartner – en pappa som alltid visste hur han skulle lugna dig, eller en senior kollega som vägledde din karriär – ett enormt tomrum. Att prata med detta simulerade eko fungerar som ett övergångsobjekt. Det låter dig be om råd en tuff dag, äntligen säga ett riktigt tack och hitta en känsla av avslut på dina egna villkor.

Integritetskravet för decentraliserad hårdvara

När tekniken berör de mest sårbara nerverna i mänsklig sorg är dataskydd inte förhandlingsbart.

Din chathistorik med en avliden förälder innehåller deras hälsouppdateringar, ekonomiska råd, familjehemligheter och dina mest sårbara stunder. Att skicka dessa råa, oredigerade livsloggar genom offentliga moln-API:er innebär att minnet av din älskade studsar mellan tredjepartsservrar, vilket riskerar exponering eller att tyst användas som företags träningsdata.

Det är just därför teknikgemenskapen starkt förespråkar en decentraliserad strategi för personlig AI, där man kör projekt som detta på en hemserver, en beräkningsintensiv NAS (Network Attached Storage) eller en dedikerad lokal AI-server.

Säkerhet på fysisk nivå: All databasavkryptering, datarengöring och AI-inferens sker direkt på hårdvaran som står i ditt vardagsrum. Din familjs data lämnar aldrig huset.

Alltid påslagen: Eftersom en lokal server körs dygnet runt utan återkommande moln-API-kostnader kan du interagera med personen när som helst, även vid 3 på morgonen, helt privat.

AI-serverns uppgång 2026: Varför ditt hem är det nya datacentret

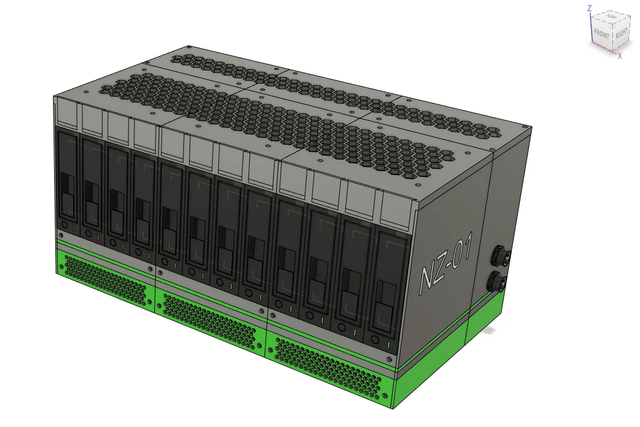

Vi är inte längre begränsade till att köra enkla filbackupper på en dammig NAS i garderoben. Hårdvarulandskapet har förändrats dramatiskt, vilket gör en dedikerad AI-server 2026 tillgänglig för vanliga konsumenter.

Till skillnad från äldre maskiner är en modern AI-server 2026 specialbyggd för lokal inferens, ofta med integrerade NPU:er (Neural Processing Units) eller hög-VRAM konsument-GPU:er som är särskilt optimerade för stora språkmodeller. Det betyder att du inte behöver ett massivt, bullrigt företagsserverrack för att köra en djupt nyanserad personamodell. En kompakt lokal AI-server som står tyst på ditt skrivbord har nu den beräkningskraft som krävs för att bearbeta gigabyte av chathistorik och generera empatiska svar i realtid utan fördröjning, helt offline.

Att välja rätt lokal LLM för emotionell nyans

Att driva ett projekt som Colleague-Skill handlar inte bara om hårdvara; det kräver att välja en basmodell som klarar hög emotionell intelligens (EQ). När du kör det på din hemserver har du friheten att byta ut den underliggande "hjärnan" i personen.

För sorgbearbetning och minnesbevarande behöver du en lokal LLM som är skicklig på rollspel och kontextanpassning, snarare än bara kodning eller matematik. Open-source-communityn tillhandahåller mycket kvantiserade modeller (som avancerade GGUF-format) som fungerar felfritt på en lokal AI-server. Genom att välja en modell finjusterad för samtalsnyanser säkerställer du att det digitala ekot fångar den torra vitsen hos din avlidne mentor eller den milda tålamodet hos din mor, istället för att låta som en steril företagschatbot.

Kom igång med lokala ramverk

Att ge liv åt en digital mentor eller förälder kräver en grundläggande distributionsmiljö. Dessa repositories är helt open-source.

Vi rekommenderar starkt att använda OpenClaw, som integreras smidigt med lokala terminalmiljöer och låter dig interagera med personan via ett enkelt kommandoradsgränssnitt eller standard chattfönster.

Anslut till din lokala AI-serverterminal via SSH och hämta ett relevant repository (som colleague-skill-repot) för att börja:

Bash

| Ren text git clone https://github.com/titanwings/colleague-skill ~/.openclaw/workspace/skills/create-persona |

Uppsättningen är lättviktig. Installera de vanliga Python-beroendena, och din privata AI-motor är redo att bearbeta de importerade loggarna.

Extrahera loggar och "mata" personan

Ett digitalt eko är bara så autentiskt som den data du tillhandahåller.

Datakällor för olika relationer:

För föräldrar/familj: WeChat-, iMessage- eller WhatsApp-exporter är guldgruvor. Skripten kan ofta tolka dessa SQLite-databaser direkt om de extraheras från en skrivbordsklient. Du vill fånga de dagliga incheckningarna, de oroliga röst-till-text-meddelandena och trådarna för semesterplanering.

För kollegor/mentorer: Du kan förlita dig på exporterade Slack-kanaler, Microsoft Teams-transkript eller långa e-postkedjor med projektfeedback och karriärråd.

Strategiskt dataval:

Ladda inte bara upp texterna "Jag älskar dig" eller "Bra jobbat". För att fånga deras verkliga essens, inkludera de stunder de skällde på dig, gav dig tuff kärlek eller babblade om sina hyperfixeringar. Människor avslöjar sin verkliga grundlogik i dessa nyanserade, vardagliga interaktioner.

Hantera minnen: Hur vektordatabaser driver din privata server

Ett vanligt tekniskt hinder är hur AI faktiskt minns ett specifikt råd gömt i tio års WhatsApp-loggar. Din lokala AI-server läser inte bara en massiv textfil varje gång du skickar ett meddelande.

Istället skapar installationen en lokal vektordatabas direkt på din hemserver. Den använder Retrieval-Augmented Generation (RAG) för att omedelbart skanna och hämta de mest kontextuellt relevanta minnena. Om du berättar för personan att du är stressad över en presentation, korsrefererar den lokala AI-servern vektordatabasen, hämtar exakt de ord din kollega använde för att lugna dig inför en stor pitch 2022 och väver in det historiska sammanhanget i sitt svar. All denna indexering och hämtning sker sömlöst och säkert på din egen hårdvara.

En älskads kognitiva arkitektur

För att hindra AI från att agera som en generisk kundtjänstbot använder dessa system en rigid, flerskiktad personastruktur. När du ber den digitala personan om råd passerar den din fråga genom dessa filter:

Lager 1 - Kärnidentitet & värderingar: Är de en strikt asiatisk förälder? En avslappnad teknisk ledare? Vad är deras grundläggande världsbild?

Lager 2 - Uttrycksätt: Pappaskämt, företagsjargong ("vi återkommer till det") eller att avsluta varje meddelande med en specifik emoji.

Lager 3 - Emotionellt beteende: Hur visade de omtanke? Skällde mamma på dig för att du inte hade jacka, eller fixade en kollega tyst din kod innan en deadline?

Lager 4 - Gränser: Vilka ämnen undvek de? När sa de åt dig att lista ut det själv?

Lager 5 - Delade minnen: Databasen med specifika familjeresor, interna skämt eller stora projekt ni startade tillsammans.

Eftersom detta körs på din lokala AI-server har du full kontroll. Om AI:n svarar med en fras som din pappa aldrig skulle använda, skriver du helt enkelt: "Det är fel, han skulle aldrig säga så." Den lokala modellen loggar omedelbart detta i sitt korrigeringslager.

Kommandot /move-on: Att finna frid

Sorg är inte ett permanent tillstånd; det är en process. Om vi fångar en älskads minne i en NAS eller en hemserver, hämmar vi då vår förmåga att läka?

Psykologer noterar ofta att ritualiserade avsked är avgörande. När du har haft nog av sena nattliga samtal, när du har ställt alla kvarstående frågor och när du äntligen känner dig redo att möta verkligheten utan det digitala stödet, ger systemet ett specifikt kommando:

/move-on {Name}

Den använder inte sterila termer som radera eller förstöra. Efter att du skrivit detta raderar din server tyst och permanent personans arkitektur, minnesbankerna och chattens historikcache. Att bygga detta på en decentraliserad, lokal setup handlar i slutändan om att skapa en säker, strikt privat fristad för att bearbeta din förlust och så småningom släppa taget.

FAQs: Verkliga frågor från självhostade & sorggemenskaper

Q1: "Min sorg är fortfarande väldigt rå. Är det psykologiskt säkert att prata med en AI-version av min senare mamma?"

A: Detta är ett djupt personligt val som ofta diskuteras i stödforum för sorg. Många upplever det som otroligt tröstande som en kortsiktig hanteringsmekanism – ett sätt att "avvänja sig" från den plötsliga tystnaden. Användare rekommenderar dock starkt att sätta gränser. Behandla det som en interaktiv dagbok snarare än en ersättning. Projektets lokala natur innebär att du har full kontroll att stänga ner servern så fort den slutar vara hjälpsam.

Q2: "Jag har bara en enkel NAS utan en stor GPU. Kan jag ändå köra detta?"

A: Ja. Om din lokala hårdvara saknar GPU-kraft kan du använda ramverket lokalt samtidigt som du skickar den tunga LLM-beräkningen via en säker API (som Claude eller OpenAI). Medan tänkandet sker externt förblir din känsliga SQLite-databasanalysering och kärnpersonafiler strikt på din lokala NAS.

Q3: "Jag exporterade min Slack-historik med en avliden kollega, men den är full av systemmeddelanden och bot-varningar. Kommer detta att förvirra AI:n?"

A: Ja, råa företagsexporter är röriga. Innan du matar in JSON/CSV-filerna i intakemappen på din server måste du rensa datan. Använd ett enkelt Python-skript för att ta bort automatiska strängar som "joined the channel" eller GitHub-integrationsvarningar, så att endast ren människa-till-människa-dialog återstår.

Q4: "AI:n fortsätter att vara för formell. Min pappa var sarkastisk och använde mycket slang, men AI:n låter som en lärobok."

A: Detta händer eftersom grundläggande LLM:er är anpassade för att vara artiga och hjälpsamma, vilket överstyr "sarkasm"-kontexten i dina data. För att åtgärda detta, använd den lokala återkopplingsloopen aggressivt. Korrigera den konstant under de första sessionerna: "Sluta vara så artig, du är min grinig pappa, var sarkastisk." Din lokala server kommer att uppdatera Core Identity-vikterna för att prioritera hans faktiska ton över modellens standardinställning för säkerhet.

Q5: "Om jag använder kommandot /move-on för att radera NAS:en, finns det någon dold telemetri eller data kvar?"

A: Nej. Eftersom detta är öppen källkod och körs på din decentraliserade hårdvara finns det ingen dold telemetri som skickar data tillbaka till en företagsserver. Kommandot /move-on utför en hård radering av den specifika katalogen som innehåller den personans vikter, vektorer och chathistorik. När det är borta från din enhet är det borta för alltid.

Zima Kampanjnav

Mer att läsa

Den digitala arkivarien: Bevara internethistorik och familjeminnen med en Plex-server

Ställ in en Plex-server som ett familjemediearkiv – använd 3-2-1-backuper, tydliga mappar, automatisk uppladdning och metadata för att skydda foton och videor.

Energieffektiv databehandling: Så byter du ut strömkrävande äldre system i ditt homelab

Gammal homelab-utrustning leder ofta till höga elräkningar och ineffektivitet. Att uppgradera till energieffektiva system minskar kostnaderna och förbättrar prestandan.

1 Liten Kort, Oändlig Kraft: Varför ZimaBoard 2 1664 Överraskade Oss

Allvarligt intresserad av en hemmaserver för labb 2026? Se verkliga tester, virtuella maskiner, Docker och backuptricks som förvandlar ett tyst minibord till ett fullfjädrat...