Under lång tid räckte det med en enkortsdator med ARM och en extra hårddisk för att kalla sig homelabber. Raspberry Pi gjorde hela grejen tillgänglig. Kostnaderna hölls låga, strömförbrukningen var försumbar och en blomstrande community betydde att svar aldrig var långt borta.

Men när hemnätverken blev snabbare, mediebiblioteken tyngre och självhosting expanderade från en enda app till ett helt ekosystem av tjänster, började samma hårdvara som en gång kändes befriande kännas som ett tak. Samtalet i homelab-communityn har tyst gått från "hur sätter jag upp detta?" till "varför fungerar det inte ordentligt?" Den frågan pekar oftare än inte tillbaka på arkitekturen under ytan.

Varför ARM fortfarande dominerar nybörjarhomelabs 2026

ARM-baserade enkortsdatorer har en verklig och legitim plats i homelab-landskapet. Raspberry Pi 5, som kör en fyrkärnig Arm Cortex-A76 på 2,4 GHz med upp till 8 GB RAM, hanterar Pi-hole, lätta Nextcloud-instansar och grundläggande hemautomation utan klagomål. Strömförbrukningen ligger på ungefär 3W i viloläge, vilket ger betydande besparingar över ett år med 24/7-drift.

Ekosystemet som byggts runt dessa kort är verkligen imponerande. År av community-guider, förbyggda OS-avbilder och aktiva forum betyder att nästan varje problem har en dokumenterad lösning. För någon som just börjat med självhosting eller kör en handfull lågkrävande containrar är ARM fortfarande en helt rimlig startpunkt.

De verkliga begränsningarna med att köra ARM i ditt homelab

Det finns en specifik frustration som ARM-homelabbare tenderar att stöta på ungefär vid samma punkt i sin resa. Den uppsättning som fungerade smidigt med två eller tre Docker-containrar börjar bete sig konstigt när den pressas hårdare. Grundorsakerna är värda att förstå tydligt, eftersom de är arkitektoniska snarare än tillfälliga. Tre distinkta begränsningar dyker upp i diskussioner i communityn, och de påverkar var och en ett annat lager i stacken.

Programvarukompatibilitet

Många serverapplikationer distribuerar förkompilerade x86-binärer som sitt primära utgivningsformat. ARM-byggnader finns för populära verktyg som Plex, Jellyfin och Nextcloud, men de ligger ofta efter i funktioner, får långsammare säkerhetspatchar eller kräver extra kompilationssteg. Hypervisorer som Proxmox VE och brandväggsdistributioner som pfSense och OPNsense är byggda och optimerade för x86-64. Att köra dem på ARM innebär lösningar som varierar från besvärliga till genuint instabila.

Expansion och I/O

De flesta ARM single-board-datorer ansluter lagring och kringutrustning via USB eller en begränsad PCIe-gränssnitt. USB-ansluten lagring fungerar för lätta NAS-uppgifter, men under samtidig läs-/skrivbelastning från flera klienter blir genomströmningsgränsen snabbt tydlig. Äkta PCIe-expansion, den typ som rymmer NVMe-enheter, 10GbE-nätverkskort eller beräkningsacceleratorer, saknas eller är begränsad till en enda långsam bana på de flesta konsument-ARM-kort.

Beteende vid kontinuerlig belastning

ARM SoC:er är designade med mobila och inbäddade arbetsbelastningar i åtanke, där kortvarig prestanda är viktigare än kontinuerlig genomströmning. Att köra en transkodningsuppgift tillsammans med flera aktiva containers och en schemalagd backup skapar den typ av jämn belastning som dessa chip aldrig optimerades för. Termisk strypning under kontinuerliga arbetsbelastningar är ett dokumenterat problem över flera ARM-korts generationer, och passiv kylning förvärrar problemet över tid.

Varför x86 ger ditt homelab mer utrymme att växa

Övergången till x86 i små formfaktor-serverhårdvaror är inte en ny utveckling, men ekonomin förbättrades avsevärt med Intels Alder Lake-N processorserie. Chip som N100 och N150 levererar fyrkärnig prestanda med en angiven TDP på 6W, vilket gör alltid-på-distribution verkligt praktisk utan en högljudd fläkt eller märkbar elkostnad. Fördelarna samlas i tre områden där ARM konsekvent har svårigheter.

| Område | ARM Homelabb | x86 Homelabb |

| Operativsystemsstöd | Anpassade bilder, begränsade distros | Vilken standard Linux-distro som helst, fullt Proxmox/TrueNAS-stöd |

| Virtualisering | Begränsad, inget hårdvaru-VT-stöd | KVM med Intel VT-x, nästan inbyggd VM-prestanda |

| Nätverk | Vanligtvis max 1GbE | Dubbel 2,5GbE standard, 10GbE via PCIe |

| PCIe-expansion | Saknas eller är begränsad | Fullt x4-plats för NVMe, nätverkskort, acceleratorer |

| Mjukvaruekosystem | ARM-byggnader, ofta fördröjda | Nativa x86-binärer, ingen ominstallation behövs |

På mjukvarusidan installeras vilken Linux-distribution som helst som körs på en standardlaptop på x86-homelabbhårdvara utan modifiering. Proxmox VE distribueras från den officiella ISO:n. TrueNAS SCALE körs exakt som dokumenterat. pfSense och OPNsense beter sig som deras wikis beskriver. Avsaknaden av arkitekturspecifika hinder innebär att tiden läggs på faktisk konfiguration istället för kompatibilitetsfelsökning.

Virtualisering berättar en liknande historia. KVM, den kärnbaserade hypervisorn som är inbyggd i Linux, körs med hårdvaruassisterad virtualisering via Intel VT-x-tillägg, vilket tillåter flera isolerade virtuella maskiner att dela en fysisk värd med nästan inbyggd prestanda. Att köra en dedikerad VM för en mediaserver, en separat för en brandvägg och en tredje för utvecklingsarbete är en rutinmässig x86-homelabbkonfiguration. Att försöka samma sak på ARM innebär kompromisser som snabbt urholkar fördelarna.

Växer ditt homelabb ur sitt ARM-kort?

För många homelabbare är det ärliga svaret ja. När en installation går från några få containers till verkligt multi-tjänsteområde tenderar ARM-kort att visa sina begränsningar på förutsägbara sätt. Några specifika scenarier dyker upp återkommande i communitydiskussioner och är värda att känna igen tidigt.

Media server-transkodning är den vanligaste avgörande faktorn. Plex och Jellyfin stödjer båda hårdvaruaccelererad transkodning på Intel-processorer via Quick Sync Video. På en modern Intel N-serieprocessor kräver konvertering av en 4K HEVC-ström till H.264 för en klient som inte kan spela upp den nativt bara en bråkdel av CPU-kapaciteten som mjukvarutranskodning kräver. ARM-kort saknar antingen helt denna accelerationsväg eller stödjer den inkonsekvent, beroende på drivrutinsstacken. För den som siktar på flera samtidiga strömmar är x86 det praktiska valet.

Spelserverhosting avslöjar liknande brister. De flesta communitydrivna multiplayer-spelservrar distribuerar binärer som främst är kompilerade för x86, och att köra dem på ARM innebär ofta att förlita sig på emulering via QEMU eller inofficiella communitybyggen som kanske inte hålls uppdaterade med upstream-releaser. Utöver kompatibilitet gynnar uthållig enkeltrådad prestanda, som spelserverns tick rate är starkt beroende av, moderna x86-chip framför ARM vid jämförbara prisnivåer.

Multitjänstvirtualisering är den tredje signalen att uppmärksamma. Om målet är en Proxmox-nod som kör isolerade VMer för en NAS, en reverse proxy, en VPN-endpoint och en hemautomationshub samtidigt, är ARM fel grund. Hypervisor-ekosystemet och hårdvaruvirtualiseringsstödet på x86 är helt enkelt i en annan klass.

Vad du ska leta efter i ett x86-homelabkort

Strömförbrukning är viktigt för alltid påslagen hårdvara. Community-benchmarks visar konsekvent att Intel N100 och N150-processorer håller ungefär 10-12W under blandade verkliga arbetsbelastningar, inklusive containers, lätta VMer och medieuppgifter som körs samtidigt. Det är konkurrenskraftigt med ARM-kluster som försöker liknande arbetsbelastningar och utmanar antagandet att x86 automatiskt innebär högre energikostnader.

PCIe-expandering förtjänar noggrann uppmärksamhet. En PCIe 3.0 x4-plats öppnar uppgraderingsvägen till NVMe-lagringsadaptrar, ytterligare SATA-kontroller, 10GbE-nätverkskort och lågströms AI-acceleratorkort. Dubbel Ethernet är värt att prioritera för den som planerar nätverkssegmentering, en dedikerad router-VM eller multi-WAN-konfigurationer. Inbyggd eMMC för OS-boot är en praktisk detalj som håller SATA- och NVMe-bandbredden helt tillgänglig för lagringsuppgifter.

OS-kompatibilitet bör verifieras innan du bestämmer dig för något kort. Plattformar byggda på standard Intel-chipset med stöd i mainline Linux-kärnan tenderar att ha minst överraskningar efter driftsättning. Communityaktivitet kring ett specifikt kort, forumtrådar, GitHub-ärenden och dokumenterade byggen är en pålitlig indikator på hur väl hårdvaran faktiskt stöds i vardagen.

| Faktor | Vad du bör prioritera |

| Processor | Intel N100 / N150 (Alder Lake-N) |

| Strömförbrukning | 10-12W vid typisk belastning |

| PCIe | minst x4-plats för framtida expansion |

| Nätverk | Dubbel 2,5GbE eller bättre |

| Lagrings-I/O | Inbyggt stöd för SATA + NVMe |

| Operativsystemsstöd | Verifierat för Proxmox VE, TrueNAS, Debian, Ubuntu |

Bygg ett smartare homelab kring ett enda x86-kort

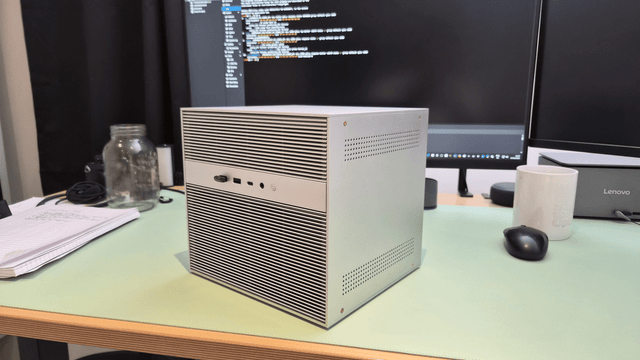

De flesta homelab-uppsättningar börjar inte komplexa. De växer en enhet i taget, tills hyllan rymmer tre kort, två strömadaptrar och en hanteringsbörda som ingen planerat för. Ett enda kapabelt x86-kort förändrar den dynamiken helt. Kort som ZimaBoard 2 konsoliderar NAS, virtualisering, routing och mediaserver i en fläktlös enhet, vilket minskar både fysisk oreda och löpande underhåll. Uppgraderingen från ARM är mindre en hårdvaru-omkoppling och mer en förändring i hur mycket en homelab realistiskt kan hantera utan att kämpa mot sin egen grund.

Vanliga frågor

Q1: Betyder övergång till en Intel N100-baserad x86-plattform full AV1 hårdvaru-kodning?

Generellt nej. Medan Alder Lake-N (N100/N150) erbjuder utmärkt hårdvaru-avkodning för AV1, kräver hårdvaru-kodning vanligtvis högre presterande Intel Arc eller Core Ultra-chip. För tunga omkodningsuppgifter 2026 kommer du fortfarande att förlita dig på x86-CPU:ns överlägsna råkraft eller en extern GPU, snarare än en dedikerad inbyggd kodningsenhet.

Q2: Kan jag använda ECC-minne på instegs-x86-kort för att förhindra datakorruption?

Vanligtvis inte. De flesta konsumentinriktade N-serie moderkort använder icke-ECC SODIMM eller lödd LPDDR5 RAM. Om ditt mål är företagsklassad ZFS-dataintegritet behöver du vanligtvis uppgradera till Intel Atom C-serie eller Xeon-D-plattformar. ARM-kort delar denna begränsning och erbjuder sällan ECC utanför dyra industrimoduler.

Q3: Är x86 i grunden bättre för att köra lokala AI-modeller som LLMs eller Frigate?

Det beror på. x86 vinner på flexibilitet; du kan enkelt lägga till en Coral TPU eller en NVIDIA GPU via PCIe. Men år 2026 har vissa högpresterande ARM SoC:er specialiserade NPU:er som överträffar instegs-x86-chip i specifika objektigenkänningsuppgifter. x86 förblir det "säkra kortet" för bred kompatibilitet med mjukvarubibliotek.

Q4: Kan jag "hot-swappa" mina befintliga ARM Docker-containrar direkt till en x86-värd?

Nej. Även om dina konfigurationsfiler (YAML) och datavolymer är portabla, är de underliggande containerbilderna arkitekturspecifika. Du måste hämta amd64-versionen av varje bild. Lyckligtvis använder de flesta moderna register "multi-arch"-taggar, så en enkel Docker Compose pull på din nya x86-maskin hämtar vanligtvis rätt binärfil automatiskt.

Q5: Bör jag avveckla mina gamla ARM-kort när x86-servern är igång?

Inte nödvändigtvis. De mest effektiva homelabs 2026 använder en "hybrid"-metod. Behåll dina ARM-kort som lätta edge-noder. De är perfekta för lågströms "vittnes"-noder i en Proxmox-kluster (för att upprätthålla Quorum), dedikerade Zigbee/Z-Wave-gateways eller fjärranslutna WireGuard-endpunkter som förblir online även under underhåll av huvudservern.

Zima Kampanjnav

Mer att läsa

ZimaCube Home Lab-övervakningsguide: Från Uptime Kuma till AI-agenter

Övervaka din hemserver med Uptime Kuma, Pulse, Proxmox Data Center Manager eller en AI-agent för att följa drifttid, säkerhetskopior, virtuella maskiner, varningar och undvika...

Från Sparcstation till ZimaBlade: En 57-årig nörds resa med självhosting

En fransk administratör ersatte sin trasiga Raspberry Pi 4 med en ZimaBlade 7700, som kör Debian 13, XFS och BorgBackup. Fullständig backupserver byggd på...

ZimaCube vs DIY NAS: Vilket passar dig bäst?

Färdigbyggd NAS eller gör-det-själv? Vi går igenom verkliga kostnader, installationstid, Thunderbolt 4 och underhållsskillnader för att hjälpa dig avgöra vilken lösning som verkligen passar...