Chmura AI może wydawać się bezwysiłkowa, dopóki nie dotknie czegoś, czego nigdy nie chciałbyś świadomie przesłać. Pliki klientów, prywatne notatki, dokumenty wewnętrzne, rodzinne zdjęcia, nawet szkice – wszystko to prowadzi do tego samego pytania: kto jeszcze może to zobaczyć? Uruchamianie dużego modelu językowego lokalnie pozwala zachować te dane na sprzęcie, którym kontrolujesz, jednocześnie zapewniając szybkość i wygodę, jakiej oczekuje się od nowoczesnej AI.

Lokalna konfiguracja zyskuje zaufanie tylko wtedy, gdy jest niezawodna. Oznacza to przewidywalne koszty, dostęp offline, gdy jest potrzebny, oraz system, który można utrzymywać jak każdą inną usługę. Dla wielu osób homelab to naturalne środowisko dla prywatnej AI, ponieważ opiera się na nawykach, które utrzymują stabilność: jasne granice, kopie zapasowe i rozsądne ustawienia domyślne.

Wybierz swoje zastosowanie lokalnej AI i metryki sukcesu

Lokalna AI działa najlepiej, gdy ma jasno określone zadanie. Zdecyduj, co model ma robić najczęściej, ponieważ ta jedna decyzja determinuje wszystko inne: rozmiar modelu, potrzeby pamięci, układ magazynu i narzędzia, które zainstalujesz.

Większość konfiguracji homelabów wpisuje się w kilka powtarzalnych wzorców:

- Prywatny asystent pisania do e-maili, streszczeń, podsumowań i przepisywania tekstów

- Wsparcie programistyczne do wyjaśniania kodu, generowania testów i tworzenia refaktoryzacji

- Q&A dokumentów w instrukcjach, PDF-ach, notatkach i bazach wiedzy

- Produktywność offline gdy łączność jest ograniczona lub preferujesz workflow bez dostępu do sieci

- Operacje domowe takie jak projekty domowe, gwarancje i inwentaryzacje

Wybierz dwie lub trzy miary, aby wiedzieć, co działa, a co wymaga poprawy:

| Metryka | Co to oznacza w praktyce | Jak to zmierzyć |

| Reaktywność | Odpowiedzi pojawiają się wystarczająco szybko, by utrzymać płynność | Mierz czas swoich najczęstszych zapytań |

| Jakość wyników | Mniej błędnych twierdzeń i lepsza struktura | Porównuj odpowiedzi na małym zestawie testowym |

| Granica prywatności | W odpowiedziach pojawiają się tylko zatwierdzone źródła | Weryfikuj cytowania i zakres wyszukiwania |

| Niezawodność | Usługa działa i odzyskuje się bez problemów | Test ponownego uruchomienia, test aktualizacji, test przywracania |

| Kontrola kosztów | Brak niespodziewanych rachunków, stabilne zużycie energii | Śledź zużycie energii i wydatki na sprzęt |

Zbuduj zrównoważoną bazę sprzętową do lokalnej inferencji

Wybór sprzętu jest prostszy niż się wydaje, gdy skupisz się na najważniejszych elementach. Lokalna inferencja to równowaga między mocą obliczeniową, pamięcią i magazynem danych, kształtowana przez twój workflow i oczekiwania. Istnieją dwie główne ścieżki:

1. Inferencja skupiona na CPU: Może być całkowicie wystarczająca dla mniejszych modeli i zadań w tle, takich jak indeksowanie dokumentów. Może wydawać się powolna podczas długich, interaktywnych rozmów, zwłaszcza przy większych oknach kontekstu.

2. Przyspieszona inferencja: Dedykowany GPU lub inny akcelerator zwykle poprawia szybkość generowania i umożliwia codzienne użycie większych modeli. Zmienia to także sposób myślenia o pamięci, ponieważ VRAM staje się kluczowym ograniczeniem.

Pamięć RAM to zwykle kluczowe ograniczenie. Wagi modeli zajmują miejsce, a środowisko uruchomieniowe potrzebuje dodatkowej przestrzeni, więc zaplanuj zapas dla systemu operacyjnego, kontenerów i innych usług działających obok inferencji. Kwantyzacja pomaga zmniejszyć rozmiar modelu, ale nie eliminuje narzutu.

Pamięć masowa decyduje o codziennym odczuciu systemu. Biblioteki modeli rosną z czasem, a wolne dyski zamieniają restarty i wymiany modeli w długie oczekiwania. Ollama, lokalne środowisko uruchomieniowe LLM, zauważa, że przechowywanie modeli może zajmować od dziesiątek do setek gigabajtów w zależności od tego, co masz zainstalowane, więc umieszczaj modele i indeksy wektorowe na szybkiej pamięci, najlepiej NVMe.

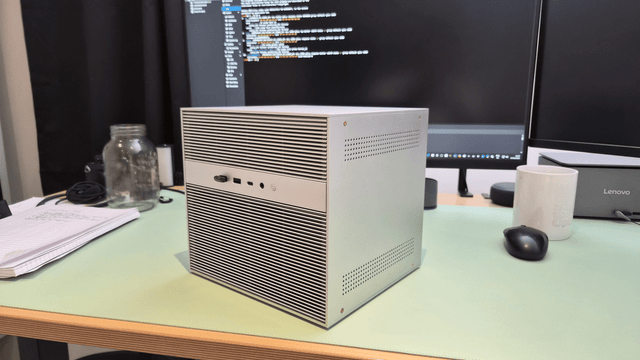

Jeśli chcesz kompaktowy serwer zaprojektowany do zadań self-hosted, sprzęt przyjazny rozbudowie może ułatwić eksperymenty. Przykładem jest ZimaBoard 2, pozycjonowany jako serwer domowy z rozszerzeniem PCIe, które może obsługiwać dodatki takie jak szybsza pamięć masowa lub akceleratory do lokalnych zadań AI.

Dla homelabu „zrównoważony” oznacza także łatwy w utrzymaniu: stabilne chłodzenie, przewidywalny hałas i profil energetyczny, który nie karze za pracę 24/7.

Rozmiar, kwantyzacja i długość kontekstu: wybór odpowiedniego modelu

Wybierz model po podjęciu decyzji, co system musi dobrze robić. Dla lokalnej AI trzy czynniki decydują o doświadczeniu: liczba parametrów, kwantyzacja i długość kontekstu.

1. Liczba parametrów: Większe modele zazwyczaj radzą sobie z trudniejszym rozumowaniem i utrzymują spójność przy dłuższych zadaniach. Mniejsze modele mogą być nadal doskonałe do streszczania, przepisywania i wielu zadań programistycznych, zwłaszcza w połączeniu z dobrymi promptami i wyszukiwaniem.

2. Kwantyzacja: Kwantyzacja reprezentuje wagi modelu z niższą precyzją, aby zmniejszyć zużycie pamięci i koszt obliczeń. To jedna z głównych przyczyn, dla których lokalne LLM są praktyczne na sprzęcie konsumenckim. Spodziewaj się kompromisu: niższa precyzja często działa w mniejszej pamięci i może działać szybciej, ale może też obniżyć dokładność, zwłaszcza w przypadkach brzegowych.

3. Długość kontekstu: Długi kontekst brzmi kusząco, ale może spowolnić przetwarzanie promptów i zwiększyć obciążenie pamięci. Model z ogromnym oknem kontekstowym może nadal działać wolno, jeśli twój sprzęt ma problemy z przetwarzaniem promptów.

Praktyczny sposób wyboru: utrzymuj jeden responsywny model codzienny, dodaj drugi tylko wtedy, gdy rozwiązuje konkretną lukę, a następnie zweryfikuj go własnymi promptami. Użyj małego zestawu testowego: jeden prompt do pisania z kontrolą tonu, jedno pytanie dotyczące dokumentu wymagające cytatów, jedno rzeczywiste zadanie programistyczne i jeden niejednoznaczny prompt do sprawdzenia wymyślonych faktów. W homelabie najlepszy model to ten, który możesz uruchamiać cały tydzień bez awarii.

Zainstaluj prosty lokalny stos z Ollama i interfejsem webowym

Utrzymaj pierwsze wdrożenie na minimalnym poziomie. Jedna maszyna uruchamia inferencję i udostępnia lokalne API, a inne urządzenia łączą się z nią przez LAN. Taki układ jest łatwy do debugowania, zabezpieczenia i prosty w utrzymaniu w homelabie.

Ollama sprawdza się jako środowisko uruchomieniowe, ponieważ obsługuje pobieranie modeli, przechowywanie i serwowanie w jednym miejscu. Zaplanuj miejsce na dysku od pierwszego dnia. Biblioteki modeli szybko rosną i często zainstalowane modele zajmują dziesiątki do setek gigabajtów z czasem. Umieść katalog modeli na pojemnym, szybkim wolumenie, najlepiej NVMe, aby ładowanie i przełączanie modeli nie stało się ciągłą uciążliwością.

Praktyczny przebieg wdrożenia:

- Zainstaluj Ollama na maszynie, która będzie uruchamiać inferencję.

- Pobierz jeden model, który mieści się w limitach pamięci.

- Zweryfikuj lokalne żądanie na tej samej maszynie.

- Zweryfikuj dostęp z innego urządzenia w sieci LAN.

Dodaj interfejs webowy do historii czatu, sesji i podstawowych kontroli.

Dla warstwy interfejsu, Open WebUI dobrze pasuje, ponieważ jest stworzony do self-hostingu, działa offline i obsługuje zgodne z OpenAI API czatu. Ta kompatybilność API ma znaczenie, gdy chcesz podłączyć lokalny model do edytorów, narzędzi do notatek i prostych skryptów bez przerabiania integracji.

Zanim dodasz więcej funkcji, uczyn setup odpornym:

- Uruchamiaj Ollama jako usługę, która przetrwa restart systemu

- Zachowuj dane Open WebUI , aby aktualizacje nie resetowały konfiguracji

- Podczas wczesnych testów utrzymuj dostęp tylko w LAN

- Zapisz porty, ścieżki i wolumeny w krótkim README

Gdy ta baza jest stabilna, dodanie RAG i zaostrzenie zabezpieczeń staje się proste.

Dodaj RAG, aby pozwolić modelowi korzystać z twoich plików i notatek

Lokalny model jest potężny, ale nie zna twoich dokumentów automatycznie. Kopiuj-wklej działa dla akapitu, ale zawodzi w prawdziwych przepływach pracy. RAG, czyli retrieval augmented generation, rozwiązuje to, pobierając odpowiedni tekst z twoich plików i dostarczając go modelowi jako kontekst do każdej odpowiedzi.

RAG działa najlepiej, gdy pipeline jest jawny. To także pomaga w prywatności, ponieważ możesz określić, które źródła są dozwolone.

Typowy pipeline RAG ma te wyraźne etapy:

- Ingestia: zbiera dokumenty z zatwierdzonych folderów

- Chunking: dzieli tekst na segmenty przyjazne do pobierania

- Osadzanie: reprezentuje fragmenty jako wektory

- Indeksowanie: przechowuje wektory oraz metadane

- Pobieranie: wyciąga najlepsze dopasowania do pytania

- Odpowiadanie: generuje odpowiedź opartą na pobranym tekście

- Cytowania: pokazują, jakie źródła zostały użyte

Zanim dodasz jakąkolwiek automatyzację, zdecyduj, jak wygląda „dobrze”. Te kontrole ułatwiają audyt zachowania RAG:

- Odpowiedzi zawierają jasne cytowania do dokładnego pliku i sekcji

- System odmawia odpowiedzi, gdy pobieranie nie zwraca nic istotnego

- Wrażliwe foldery są domyślnie wykluczone, a następnie dodawane celowo

- Proces odświeżania indeksu jest przewidywalny i rejestrowany

Chunking to częsty punkt awarii. Jeśli fragmenty są ogromne, pobieranie zwraca ścianę tekstu. Jeśli fragmenty są malutkie, kontekst się gubi. Dobry kompromis zależy od typu dokumentu, więc testuj na swoich rzeczywistych plikach, a potem dostosuj. W homelabie to dostosowanie staje się jednorazową inwestycją, która codziennie przynosi korzyści.

Zabezpiecz i utrzymuj swoje prywatne usługi AI w domu

Lokalna SI to nadal usługa sieciowa, a usługi sieciowe często są przypadkowo wystawiane na zewnątrz. Przekierowanie portu, błędnie skonfigurowane reverse proxy lub „tymczasowa” reguła mogą zmienić prywatny punkt końcowy w publiczny.

Priorytety bezpieczeństwa, w kolejności:

- Kontrola dostępu: silne uwierzytelnianie, minimalna liczba kont, zasada najmniejszych uprawnień

- Zakres sieci: domyślnie tylko LAN, wyraźne reguły dla każdego zdalnego dostępu

- Bezpieczeństwo transportu: TLS dla wszystkiego, co opuszcza localhost

- Higiena sekretów: unikaj twardego kodowania kluczy w konfiguracjach i logach

- Dyscyplina łatek: regularne aktualizacje systemu operacyjnego, kontenerów i interfejsu webowego

- Kopie zapasowe i przywracanie: kopie zapasowe są prawdziwe dopiero po teście przywracania

Do zdalnego dostępu preferuj VPN lub zaufany tunel zamiast otwartych portów. Jeśli uruchamiasz reverse proxy, trzymaj je zabezpieczone za pomocą uwierzytelniania i limitów szybkości. To zgodne z wytycznymi OWASP dotyczącymi bezpieczeństwa API, które wielokrotnie podkreślają, że złamane uwierzytelnianie i autoryzacja to powszechne przyczyny awarii w rzeczywistych systemach.

Konserwacja to to, co odróżnia weekendową demonstrację od niezawodnego prywatnego asystenta. Lekka rutyna sprawdza się dobrze:

- Co tydzień: sprawdzaj wzrost zajętości dysku przez pliki modeli i indeksy

- Miesięcznie: stosuj aktualizacje i restartuj w czasie o niskim wpływie na działanie

- Kwartalnie: weryfikuj kopie zapasowe, rotuj dane uwierzytelniające, przeglądaj wystawione usługi

Traktuj swój lokalny stos AI jak każdą inną kluczową usługę w swoim homelabie. Takie podejście zmniejsza niepokój i utrzymuje obietnicę prywatności.

Uruchom swój prywatny AI homelab już dziś!

Aby uczynić prywatną sztuczną inteligencję praktyczną w domu, skup się na spokojnej niezawodności. Dąż do stabilnej wydajności, stałych kosztów i granic prywatności. Uruchom jeden duży model językowy lokalnie, dodaj prosty interfejs i ogranicz dostęp do urządzeń oraz osób, którym ufasz. Następnie ulepszaj na podstawie rzeczywistego użytkowania, na przykład szybszą pamięć masową dla szybszego ładowania, silniejsze zabezpieczenia lub RAG dla niewielkiego zestawu dokumentów. Zbuduj homelab, na którym możesz polegać, i pozwól swojej lokalnej SI zająć miejsce w codziennej pracy już dziś!

Najczęściej zadawane pytania

P1: Czy mogę uruchomić lokalny LLM na niskomocowym mini serwerze w homelabie?

Tak, w wielu przypadkach, zwłaszcza do lżejszych zadań pisarskich i krótkich promptów. Spodziewaj się wolniejszych odpowiedzi na systemach tylko z CPU, wybieraj mniejsze lub mocniej kwantyzowane modele. Jeśli chcesz płynniejszego codziennego użytkowania, zaplanuj wystarczającą ilość RAM i szybki magazyn NVMe aby zmniejszyć opóźnienia ładowania.

P2: Czy lokalna AI będzie działać na moim laptopie i nadal integrować się z usługami homelabu?

Tak, często. Możesz uruchomić model lokalnie na laptopie podczas podróży, a następnie skierować narzędzia z powrotem do punktu końcowego homelabu w domu, gdy jesteś w swojej sieci LAN lub VPN. Utrzymuj konfiguracje proste, stosując spójny lokalny wzorzec API i jeden interfejs.

P3: Czy potrzebuję dostępu do internetu, aby korzystać z samodzielnie hostowanej AI po konfiguracji?

Nie, nie dla podstawowego wnioskowania, gdy środowisko uruchomieniowe i modele są już zainstalowane. Niektóre funkcje mogą nadal zależeć od usług sieciowych, takich jak pobieranie nowych modeli, aktualizacja kontenerów czy synchronizacja dokumentów. Dla prawdziwego trybu offline pobierz modele wcześniej i przechowuj lokalną dokumentację oraz osadzenia na magazynie homelabu.

P4: Jak zapobiec wyciekowi prywatnych danych mojego lokalnego chatbota do innych użytkowników?

Używaj oddzielnych kont i ścisłych uprawnień dla każdego workspace lub zestawu danych. Ogranicz źródła wyszukiwania do konkretnych folderów i unikaj indeksowania współdzielonych katalogów domowych. Logowanie też ma znaczenie. Utrzymuj logi na minimalnym poziomie i przeglądaj je pod kątem wrażliwych treści. W wieloużytkownikowym homelabie izoluj usługi za pomocą kontenerów i reguł sieciowych.

P5: Jaki jest rozsądny sposób oszacowania potrzeb magazynowych dla lokalnych LLM i wyszukiwania dokumentów?

Planuj rozwój. Jeden lub dwa modele mogą pasować wygodnie, ale kolekcje szybko się rozrastają. Traktuj dziesiątki gigabajtów jako punkt wyjścia, a następnie dodaj miejsce na wiele modeli, pliki cache oraz indeks wyszukiwania dla swoich dokumentów. NVMe poprawia wydajność, podczas gdy większe dyski HDD mogą przechowywać archiwa.

Centrum Kampanii Zima

Więcej do przeczytania

Przewodnik monitorowania laboratorium domowego ZimaCube: od Uptime Kuma do agentów AI

Monitoruj swój domowy serwer za pomocą Uptime Kuma, Pulse, Proxmox Data Center Manager lub agenta AI, aby śledzić czas pracy, kopie zapasowe, maszyny wirtualne,...

Od Sparcstation do ZimaBlade: 57-letnia podróż geeka przez self-hosting

Francuski specjalista ds. administracji zastąpił swojego niesprawnego Raspberry Pi 4 modelem ZimaBlade 7700, działającym na Debianie 13, XFS i BorgBackup. Pełna konfiguracja serwera kopii...

ZimaCube a DIY NAS: Który jest dla Ciebie odpowiedni?

Gotowy NAS czy zrób to sam? Analizujemy rzeczywiste koszty, czas konfiguracji, Thunderbolt 4 oraz różnice w utrzymaniu, aby pomóc Ci zdecydować, która konstrukcja naprawdę...