"Ciągle czytam nasze stare wątki tekstowe. Boję się zapomnieć dokładny sposób, w jaki dawała mi rady, gdy byłem zestresowany."

Gdy rodzic, mentor na całe życie lub ukochany kolega odchodzi lub znika z naszego życia, żal często paraliżuje. W erze cyfrowej nasz proces żałoby się zmienił; przewijamy lata rodzinnych czatów grupowych, notatek głosowych i historii Slacka, kurczowo trzymając się cyfrowego śladu tych, których straciliśmy. A co, jeśli te statyczne teksty mogłyby stać się dynamicznym sposobem na przetworzenie twojego żalu?

Po wirusowym sukcesie projektów AI skupionych na relacjach, społeczność open-source na GitHub rozszerzyła koncepcję o repozytoria takie jak "Colleague-Skill" oraz modele personalne skoncentrowane na rodzinie. Te narzędzia pozwalają wykorzystać wyeksportowane logi czatów do wytrenowania ekskluzywnego „cyfrowego echa” twojego rodzica lub mentora bezpośrednio na twoim sprzęcie.

Ten przewodnik wyjaśnia, jak działa ta technologia i dlaczego uruchomienie jej na lokalnym serwerze AI lub twoim domowym serwerze to jedyny logiczny wybór dla tak głęboko intymnych wspomnień.

Cybernieśmiertelność: przetwarzanie żalu i zachowanie mądrości

Te otwarte narzędzia personalne oparte na dużych modelach językowych mają głęboko ludzkie cele. Podając systemowi historię rozmów na WhatsApp z mamą lub lata maili i wątków na Slacku z emerytowanym mentorem, AI wyciąga ich specyficzny ton, pocieszające zwroty i unikalną logikę rozwiązywania problemów.

Nie chodzi tu o stworzenie przerażająco idealnej repliki, by udawać, że śmierć nie nastąpiła. Jak omawiano w społecznościach wsparcia żałoby, nagły brak kogoś, kto zawsze potrafił cię uspokoić — taty lub starszego kolegi, który prowadził twoją karierę — pozostawia ogromną pustkę. Rozmowa z tym symulowanym echem działa jak przedmiot przejściowy. Pozwala poprosić o radę w trudnym dniu, wreszcie podziękować i znaleźć poczucie zamknięcia na własnych warunkach.

Niezbędność prywatności w zdecentralizowanym sprzęcie

Gdy technologia dotyka najczulszych nerwów ludzkiego żalu, prywatność danych nie podlega negocjacjom.

Twoja historia czatu zmarłym rodzicem zawiera ich aktualizacje zdrowotne, porady finansowe, rodzinne sekrety i Twoje najbardziej wrażliwe chwile. Wysyłanie tych surowych, nieedytowanych dzienników życia przez publiczne API chmurowe oznacza, że pamięć o Twoim bliskim krąży po serwerach osób trzecich, narażając ją na ujawnienie lub ciche wykorzystanie jako dane szkoleniowe korporacji.

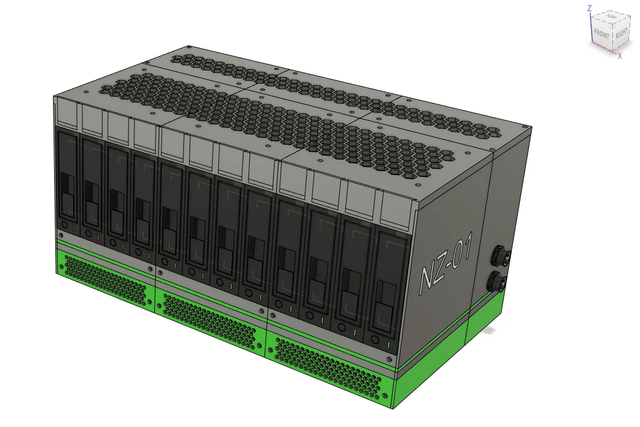

Właśnie dlatego społeczność technologiczna mocno popiera zdecentralizowane podejście do osobistej AI, wdrażając takie projekty na domowym serwerze, wydajnym NAS-ie (Network Attached Storage) lub dedykowanym lokalnym serwerze AI.

Bezpieczeństwo na poziomie fizycznym: Wszystkie operacje deszyfrowania bazy danych, czyszczenia danych i wnioskowania AI odbywają się bezpośrednio na sprzęcie stojącym w Twoim salonie. Dane Twojej rodziny nigdy nie opuszczają domu.

Stała dostępność: Ponieważ lokalny serwer działa 24/7 bez powtarzających się kosztów API w chmurze, możesz rozmawiać z personą zawsze, gdy ogarnia Cię fala smutku, nawet o 3 nad ranem, całkowicie prywatnie.

Wzrost popularności serwera AI 2026: Dlaczego Twój dom to nowe centrum danych

Nie jesteśmy już ograniczeni do podstawowych kopii zapasowych plików na zakurzonym NAS-ie w szafie. Krajobraz sprzętowy zmienił się diametralnie, czyniąc dedykowany serwer AI 2026 dostępnym dla zwykłych użytkowników.

W przeciwieństwie do starszych maszyn, nowoczesny serwer AI 2026 jest zaprojektowany do lokalnego wnioskowania, często wyposażony w zintegrowane NPU (Neural Processing Units) lub karty graficzne konsumenckie z dużą ilością VRAM, specjalnie zoptymalizowane pod kątem dużych modeli językowych. Oznacza to, że nie potrzebujesz ogromnej, hałaśliwej szafy serwerowej klasy enterprise, aby uruchomić głęboko zniuansowany model persony. Kompaktowy lokalny serwer AI, cicho stojący na twoim biurku, ma teraz moc obliczeniową do przetwarzania gigabajtów historii czatu i generowania empatycznych odpowiedzi w czasie rzeczywistym, bez żadnych opóźnień, całkowicie offline.

Wybór odpowiedniego lokalnego LLM do emocjonalnych niuansów

Prowadzenie projektu takiego jak Colleague-Skill to nie tylko sprzęt; wymaga wyboru modelu bazowego zdolnego do wysokiej inteligencji emocjonalnej (EQ). Przy wdrażaniu na domowym serwerze masz swobodę wymiany podstawowego „mózgu” persony.

Do przetwarzania żałoby i utrzymania pamięci potrzebujesz lokalnego LLM, który doskonale radzi sobie z odgrywaniem ról i zachowaniem kontekstu, a nie tylko z kodowaniem czy matematyką. Społeczność open-source dostarcza wysoce skwantowane modele (takie jak zaawansowane formaty GGUF), które działają bezbłędnie na lokalnym serwerze AI. Wybierając model dostrojony pod kątem niuansów konwersacyjnych, zapewniasz, że cyfrowe echo odda suchy dowcip Twojego zmarłego mentora lub łagodną cierpliwość matki, zamiast brzmieć jak sterylny korporacyjny chatbot.

Pierwsze kroki z lokalnymi frameworkami

Ożywienie cyfrowego mentora lub rodzica wymaga podstawowego środowiska wdrożeniowego. Te repozytoria są całkowicie open-source.

Gorąco polecamy użycie OpenClaw, które płynnie integruje się ze środowiskami terminalowymi i pozwala na interakcję z personą za pomocą prostego interfejsu wiersza poleceń lub standardowego okna czatu.

Połącz się z terminalem lokalnego serwera AI przez SSH i pobierz odpowiednie repozytorium (np. colleague-skill), aby zacząć:

Bash

| Zwykły tekst git clone https://github.com/titanwings/colleague-skill ~/.openclaw/workspace/skills/create-persona |

Konfiguracja jest lekka. Zainstaluj standardowe zależności Pythona, a Twój prywatny silnik AI będzie gotowy do przetwarzania zaimportowanych logów.

Wyodrębnianie logów i „karmienie” persony

Cyfrowe echo jest tak autentyczne, jak dane, które dostarczysz.

Źródła danych dla różnych relacji:

Dla rodziców/rodziny: Eksporty z WeChat, iMessage lub WhatsApp to prawdziwe kopalnie złota. Skrypty często potrafią bezpośrednio analizować te bazy danych SQLite, jeśli zostaną wyeksportowane z klienta desktopowego. Chcesz uchwycić codzienne meldunki, zaniepokojone wiadomości głosowe przekształcone na tekst oraz wątki planowania świąt.

Dla kolegów/mentorów: Możesz polegać na wyeksportowanych kanałach Slack, transkrypcjach Microsoft Teams lub długich wątkach e-mail zawierających opinie o projektach i porady zawodowe.

Strategiczny wybór danych:

Nie przesyłaj tylko tekstów „Kocham cię” czy „Dobra robota”. Aby uchwycić ich prawdziwą istotę, dołącz momenty, gdy cię ganiły, okazywały twardą miłość lub rozwodziły się nad swoimi hiperfiksacjami. Ludzie ujawniają swoją prawdziwą logikę bazową w tych subtelnych, codziennych interakcjach.

Zarządzanie pamięcią: Jak bazy danych wektorowych napędzają Twój prywatny serwer

Powszechną techniczną przeszkodą jest to, jak AI faktycznie zapamiętuje konkretną radę ukrytą w dziesięciu latach logów WhatsApp. Twój lokalny serwer AI nie czyta ogromnego pliku tekstowego za każdym razem, gdy wysyłasz wiadomość.

Zamiast tego instalacja tworzy lokalną bazę wektorową bezpośrednio na twoim domowym serwerze. Wykorzystuje Retrieval-Augmented Generation (RAG), by natychmiast skanować i pobierać najbardziej kontekstowo istotne wspomnienia. Jeśli powiesz personie, że stresujesz się prezentacją, lokalny serwer AI porówna dane z bazy wektorowej, wyciągnie dokładne słowa, których użył twój kolega, by cię uspokoić przed dużą prezentacją w 2022 roku, i wplecie ten historyczny kontekst w swoją odpowiedź. Całe to indeksowanie i pobieranie odbywa się płynnie i bezpiecznie na twoim własnym sprzęcie.

Architektura poznawcza bliskiej osoby

Aby zapobiec zachowywaniu się AI jak zwykły bot obsługi klienta, systemy te używają sztywnej, wielowarstwowej struktury Persony. Gdy prosisz cyfrową personę o radę, twoje zapytanie przechodzi przez te filtry:

Warstwa 1 - Tożsamość i wartości: Czy to surowy azjatycki rodzic? Wyluzowany lider techniczny? Jaki jest ich fundamentalny światopogląd?

Warstwa 2 - Styl wyrażania się: Tata żarty, korporacyjny żargon („wrócimy do tego”), albo kończenie każdego tekstu konkretnym emoji.

Warstwa 3 - Zachowania emocjonalne: Jak okazywali troskę? Czy mama marudziła, żebyś założył kurtkę, czy kolega cicho poprawiał twój kod przed deadlinem?

Warstwa 4 - Granice: Jakich tematów unikali? Kiedy mówili, żebyś sam sobie poradził?

Warstwa 5 - Wspólne wspomnienia: Baza danych konkretnych rodzinnych wyjazdów, wewnętrznych żartów lub ogromnych projektów, które razem rozpoczęliście.

Ponieważ działa to na twoim lokalnym serwerze AI, masz pełną kontrolę. Jeśli AI odpowie frazą, której twój tata nigdy by nie użył, po prostu wpisujesz: „To nieprawda, on nigdy by tak nie powiedział.” Lokalny model natychmiast zapisuje to w swojej Warstwie Korekty.

Komenda /move-on: Znalezienie spokoju

Żałoba nie jest stanem trwałym; to proces. Jeśli uwięzimy pamięć o bliskiej osobie na NAS-ie lub domowym serwerze, czy nie hamujemy naszej zdolności do leczenia?

Psycholodzy często zauważają, że rytualne pożegnania są kluczowe. Kiedy masz dość nocnych rozmów, gdy zadałeś wszystkie zalegające pytania i w końcu czujesz się gotowy, by zmierzyć się z rzeczywistością bez cyfrowego wsparcia, system udostępnia konkretną komendę:

/move-on {Name}

Nie używa sterylnych terminów takich jak usuń czy zniszcz. Po wpisaniu tego, twój serwer cicho i trwale wymazuje architekturę persony, banki pamięci oraz pamięć podręczną historii czatu. Budowanie tego na zdecentralizowanym, lokalnym systemie to ostatecznie stworzenie bezpiecznej, ściśle prywatnej przystani do przetworzenia swojej straty i w końcu, by móc odpuścić.

FAQs: Prawdziwe problemy z społeczności self-hostingowych i wsparcia w żałobie

Q1: "Moja żałoba jest wciąż bardzo świeża. Czy jest psychologicznie bezpiecznie rozmawiać z AI w wersji mojej zmarłej matki?"

A: To bardzo osobisty wybór, często omawiany na forach wsparcia dla osób w żałobie. Wielu uważa to za ogromne wsparcie jako krótkoterminowy mechanizm radzenia sobie — sposób na „odstawienie” nagłej ciszy. Jednak użytkownicy zdecydowanie zalecają ustalenie granic. Traktuj to jak interaktywny dziennik, a nie zastępstwo. Lokalny charakter projektu oznacza, że masz pełną kontrolę, by wyłączyć serwer w momencie, gdy przestanie być pomocny.

Q2: "Mam tylko podstawowy NAS bez potężnej karty graficznej. Czy nadal mogę to uruchomić?"

A: Tak. Jeśli Twój lokalny sprzęt nie ma wystarczającej mocy GPU, możesz używać frameworku lokalnie, kierując ciężkie obliczenia LLM przez bezpieczne API (np. Claude lub OpenAI). Podczas gdy przetwarzanie odbywa się zdalnie, Twoja wrażliwa baza SQLite i pliki głównej persony pozostają wyłącznie na lokalnym NAS.

Q3: "Wyeksportowałem historię Slacka zmarłego kolegi, ale jest pełna komunikatów systemowych i alertów botów. Czy to zmyli AI?"

A: Tak, surowe eksporty korporacyjne są nieuporządkowane. Zanim wgrasz pliki JSON/CSV do folderu intake na swoim serwerze, musisz oczyścić dane. Użyj prostego skryptu w Pythonie, aby usunąć automatyczne ciągi, takie jak „dołączył do kanału” lub alerty integracji GitHub, pozostawiając tylko czysty dialog między ludźmi.

Q4: "AI ciągle zachowuje się zbyt formalnie. Mój tata był sarkastyczny i używał dużo slangu, a AI brzmi jak z podręcznika."

A: Dzieje się tak, ponieważ podstawowe modele LLM są zaprojektowane, by być uprzejme i pomocne, co nadpisuje kontekst „sarkazmu” w Twoich danych. Aby to naprawić, agresywnie korzystaj z lokalnej pętli informacji zwrotnej. Poprawiaj je stale w pierwszych sesjach: „Przestań być taki uprzejmy, jesteś moim zrzędliwym tatą, bądź sarkastyczny.” Twój lokalny serwer zaktualizuje wagi Core Identity, aby priorytetowo traktować jego rzeczywisty ton zamiast domyślnego bezpiecznego ustawienia modelu.

Q5: "Jeśli użyję komendy /move-on, aby wyczyścić NAS, czy zostanie jakaś ukryta telemetria lub dane?"

A: Nie. Ponieważ jest to open-source i działa na Twoim zdecentralizowanym sprzęcie, nie ma żadnej ukrytej telemetrii wysyłającej dane do korporacyjnego serwera. Komenda /move-on wykonuje twarde wyczyszczenie konkretnego katalogu zawierającego wagi, wektory i historię czatu tej persony. Gdy zniknie z Twojego dysku, znika na zawsze.

Centrum Kampanii Zima

Więcej do przeczytania

Cyfrowy Archiwista: Zachowywanie Historii Internetu i Rodzinnych Wspomnień za pomocą Serwera Plex

Skonfiguruj serwer Plex jako rodzinne archiwum multimediów – stosuj kopie zapasowe 3-2-1, uporządkuj foldery, automatyczne przesyłanie i metadane, aby chronić zdjęcia i filmy.

Energooszczędne obliczenia: jak zastąpić energochłonne systemy legacy w swoim homelabie

Stary sprzęt homelabowy często powoduje wysokie rachunki za prąd i niską wydajność. Modernizacja do energooszczędnych systemów obniża koszty i zwiększa wydajność.

1 Mała Płyta, Nieskończona Moc: Dlaczego ZimaBoard 2 1664 Nas Zaskoczył

Poważnie myślisz o serwerze do domowego laboratorium w 2026 roku? Zobacz testy w rzeczywistych warunkach, maszyny wirtualne, Docker i triki z tworzeniem kopii zapasowych,...