La IA en la nube puede parecer sencilla hasta que toca algo que nunca subirías a propósito. Archivos de clientes, notas privadas, documentos internos, fotos familiares, incluso borradores llevan a la misma pregunta: ¿quién más puede ver esto? Ejecutar un modelo de lenguaje grande localmente mantiene ese contenido en hardware que controlas, mientras sigue ofreciendo la velocidad y conveniencia que la gente espera de la IA moderna.

Una configuración local solo genera confianza cuando se mantiene confiable. Eso significa costos predecibles, acceso sin conexión cuando lo necesitas y un sistema que puedes mantener como cualquier otro servicio. Para muchas personas, un homelab es el hogar natural para la IA privada porque ya funciona con los hábitos que mantienen la estabilidad: límites claros, copias de seguridad y configuraciones sensatas.

Elige tu caso de uso de IA local y métricas de éxito

La IA local funciona mejor cuando tiene un trabajo claro. Decide qué quieres que el modelo haga con más frecuencia, porque esa única elección determina todo lo demás: tamaño del modelo, necesidades de memoria, disposición del almacenamiento y las herramientas que instalas.

La mayoría de las configuraciones de homelab siguen algunos patrones repetibles:

- Asistente privado de escritura para correos electrónicos, informes, resúmenes y reescritura

- Soporte de programación para explicar código, generar pruebas y redactar refactorizaciones

- Preguntas y respuestas de documentos a través de manuales, PDFs, notas y bases de conocimiento

- Productividad sin conexión cuando la conectividad es limitada o prefieres un flujo de trabajo aislado

- Operaciones domésticas como proyectos en casa, garantías e inventarios

Elige dos o tres medidas para que puedas saber qué funciona y qué necesita arreglo:

| Métrica | Qué significa en la práctica | Cómo medirlo |

| Capacidad de respuesta | Las respuestas llegan lo suficientemente rápido para mantener el flujo | Cronometra tus indicaciones comunes |

| Calidad de salida | Menos afirmaciones incorrectas y mejor estructura | Compara respuestas en un pequeño conjunto de prueba |

| Límite de privacidad | Solo fuentes aprobadas aparecen en las respuestas | Verifica las citas y el alcance de recuperación |

| Confiabilidad | El servicio permanece activo y se recupera limpiamente | Prueba de reinicio, prueba de actualización, prueba de restauración |

| Control de costos | Sin facturas sorpresa, consumo de energía estable | Controla el gasto en energía y hardware |

Construye una base de hardware equilibrada para la inferencia local

La selección de hardware es más sencilla de lo que parece cuando te concentras en lo esencial. La inferencia local es un equilibrio entre computación, memoria y almacenamiento, moldeado por tu flujo de trabajo y expectativas. Existen dos caminos generales:

1. Inferencia centrada en CPU: Esto puede funcionar perfectamente para modelos más pequeños y para tareas en segundo plano como indexar documentos. Puede sentirse lento para chats largos e interactivos, especialmente con ventanas de contexto más grandes.

2. Inferencia acelerada: Una GPU discreta u otro acelerador generalmente mejora la velocidad de generación y hace que modelos más grandes sean viables para uso diario. También cambia cómo piensas en la memoria, ya que la VRAM se convierte en una limitación clave.

La memoria suele ser la limitación decisiva. Los pesos del modelo ocupan espacio, y el entorno de ejecución necesita espacio extra además, así que planifica margen para el sistema operativo, contenedores y cualquier otro servicio que se ejecute junto con la inferencia. La cuantización ayuda a reducir la huella del modelo, pero no elimina la sobrecarga.

El almacenamiento luego decide cómo se siente el sistema día a día. Las bibliotecas de modelos crecen con el tiempo, y los discos lentos convierten los reinicios y cambios de modelo en largas esperas. Ollama, un entorno de ejecución local para LLM, nota que el almacenamiento de modelos puede alcanzar decenas o cientos de gigabytes dependiendo de lo que mantengas instalado, así que coloca los modelos y los índices vectoriales en almacenamiento rápido cuando puedas, idealmente NVMe.

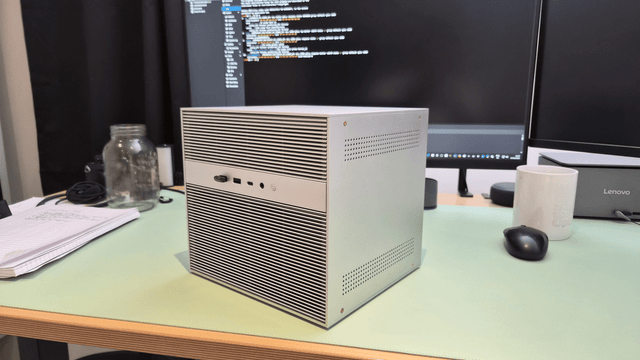

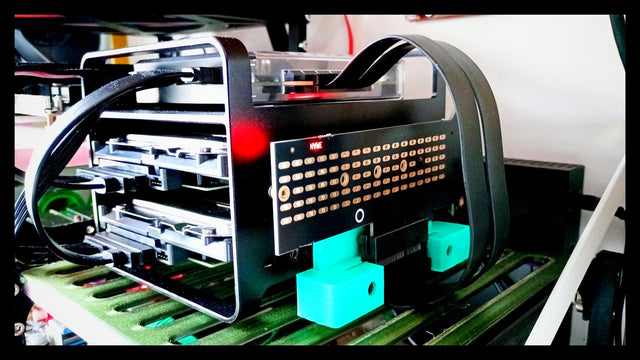

Si quieres un servidor compacto diseñado para cargas de trabajo autoalojadas, un hardware con capacidad de expansión puede simplificar la experimentación. Un ejemplo es ZimaBoard 2, posicionado como un servidor doméstico con expansión PCIe que puede soportar complementos como almacenamiento más rápido o aceleradores para cargas de trabajo locales de IA.

Para un homelab, “equilibrado” también significa mantenible: refrigeración estable, ruido predecible y un perfil de consumo que no te castiga por usarlo 24/7.

Tamaño, Cuantización y Longitud de Contexto: Elegir el Modelo Adecuado

Elige el modelo después de decidir qué debe hacer bien el sistema. Para la IA local, tres factores determinan la experiencia: cantidad de parámetros, cuantización y longitud del contexto.

1. Cantidad de parámetros: Los modelos más grandes generalmente manejan razonamientos más complejos y mantienen coherencia en tareas largas. Los modelos más pequeños pueden ser excelentes para resúmenes, reescritura y muchas tareas de codificación, especialmente cuando se combinan con buenos prompts y recuperación.

2. Cuantización: La cuantización representa los pesos del modelo a menor precisión para reducir costos de memoria y cómputo. Es una de las principales razones por las que los LLM locales son prácticos en hardware de consumo. Espera un compromiso: menor precisión suele funcionar con menos memoria y puede ser más rápido, pero también puede reducir la precisión, especialmente en casos límite.

3. Longitud del contexto: Un contexto largo suena atractivo, pero puede ralentizar el procesamiento del prompt y aumentar la presión de memoria. Un modelo con una ventana de contexto enorme puede sentirse lento si tu hardware tiene dificultades para procesar el prompt.

Forma práctica de elegir: mantén un modelo diario que responda bien, añade un segundo solo cuando resuelva una brecha específica, y luego valida con tus propios prompts. Usa un conjunto pequeño de pruebas: un prompt de escritura con tono controlado, una pregunta sobre un documento que requiera citas, una tarea real de codificación y un prompt ambiguo para verificar hechos inventados. En un homelab, el mejor modelo es el que puedes usar toda la semana sin fallos.

Instala una pila local simple con Ollama y una interfaz web

Mantén el primer despliegue minimalista. Una máquina ejecuta la inferencia y expone una API local, luego tus otros dispositivos acceden a ella a través de la LAN. Esta configuración es fácil de depurar, segura y sencilla de mantener en un homelab.

Ollama funciona bien como entorno de ejecución porque maneja las descargas, almacenamiento y servicio de modelos en un solo lugar. Planifica el disco desde el primer día. Las bibliotecas de modelos crecen rápido, y es común que los modelos instalados sumen decenas a cientos de gigabytes con el tiempo. Coloca el directorio de modelos en un volumen espacioso y rápido, idealmente NVMe, para que cargar y cambiar modelos no se convierta en una molestia constante.

Un flujo práctico de despliegue:

- Instala Ollama en la máquina que ejecutará la inferencia.

- Descarga un modelo que se ajuste a los límites de tu memoria.

- Verifica una solicitud local en la misma máquina.

- Verifica el acceso desde otro dispositivo en tu LAN.

Agrega una interfaz web para el historial de chat, sesiones y controles básicos.

Para la capa de interfaz, Open WebUI es adecuado porque está diseñado para autoalojamiento, funciona sin conexión y soporta APIs de chat compatibles con OpenAI. Esa compatibilidad API es importante cuando quieres conectar un modelo local a editores, herramientas de notas y scripts simples sin rehacer tus integraciones.

Antes de añadir más funciones, haz que la configuración sea resistente:

- Ejecuta Ollama como un servicio que sobreviva a reinicios

- Conserva los datos de Open WebUI para que las actualizaciones no restablezcan la configuración

- Mantén el acceso LAN solo durante las pruebas iniciales

- Anota puertos, rutas y volúmenes en un README corto

Una vez que esta base es estable, añadir RAG y reforzar la seguridad se vuelve sencillo.

Añade RAG para que el modelo use tus archivos y notas

Un modelo local es potente, pero no conoce tus documentos automáticamente. Copiar y pegar funciona para un párrafo, pero falla en flujos de trabajo reales. RAG, abreviatura de generación aumentada por recuperación, soluciona esto obteniendo texto relevante de tus archivos y proporcionándolo al modelo como contexto para cada respuesta.

RAG funciona mejor cuando la canalización es explícita. Eso también ayuda con la privacidad, ya que puedes definir qué fuentes están permitidas.

Una canalización típica de RAG tiene estas etapas distintas:

- Ingesta: recopila documentos de carpetas aprobadas

- Fragmentación: divide el texto en segmentos adecuados para la recuperación

- Embeddings: representan fragmentos como vectores

- Indexación: almacena vectores más metadatos

- Recuperación: extrae las mejores coincidencias para una pregunta

- Respuesta: genera una respuesta basada en el texto recuperado

- Citas: muestran qué fuentes se usaron

Antes de añadir cualquier automatización, decide cómo es un “buen” resultado. Estas comprobaciones facilitan auditar el comportamiento de RAG:

- Las respuestas incluyen citas claras al archivo y sección exactos

- El sistema se niega a responder cuando la recuperación no devuelve nada relevante

- Las carpetas sensibles se excluyen por defecto y luego se añaden intencionadamente

- El proceso de actualización del índice es predecible y está registrado

La fragmentación es un punto común de fallo. Si los fragmentos son enormes, la recuperación devuelve un muro de texto. Si los fragmentos son muy pequeños, se pierde el contexto. Un buen compromiso varía según el tipo de documento, así que prueba con tus archivos reales y luego ajusta. En un homelab, ese ajuste se convierte en una inversión única que sigue dando frutos cada día.

Asegura y Mantén tus Servicios Privados de IA en Casa

La IA local sigue siendo un servicio de red, y los servicios de red se exponen accidentalmente todo el tiempo. Un reenvío de puerto, un proxy inverso mal configurado o una regla “temporal” pueden convertir un punto final privado en uno público.

Prioridades de seguridad, en orden:

- Control de acceso: autenticación fuerte, cuentas mínimas, privilegios mínimos

- Alcance de red: solo LAN por defecto, reglas explícitas para cualquier acceso remoto

- Seguridad de transporte: TLS para todo lo que salga del localhost

- Higiene de secretos: evita codificar claves en configuraciones y registros

- Disciplina de parches: actualizaciones regulares para el sistema operativo, contenedores y la interfaz web

- Copias de seguridad y restauraciones: las copias de seguridad solo son reales después de una prueba de restauración

Para acceso remoto, prefiere una VPN o un túnel confiable en lugar de puertos abiertos. Si usas un proxy inverso, mantenlo protegido con autenticación y límites de tasa. Eso se alinea con las recomendaciones de seguridad API al estilo OWASP, que destacan repetidamente la autenticación y autorización rotas como modos comunes de falla en sistemas reales.

El mantenimiento es lo que separa una demostración de fin de semana de un asistente privado confiable. Una rutina ligera funciona bien:

- Semanalmente: revisa el crecimiento del disco para archivos de modelos e índices

- Mensualmente: aplica actualizaciones y reinicia durante una ventana de bajo impacto

- Trimestralmente: verifica las copias de seguridad, rota las credenciales, revisa los servicios expuestos

Trata tu pila local de IA como cualquier otro servicio central en tu homelab. Esa mentalidad reduce la ansiedad y mantiene intacta la promesa de privacidad.

¡Pon tu homelab de IA privada en línea hoy!

Para hacer que la inteligencia artificial privada sea práctica en casa, enfócate en la fiabilidad tranquila. Apunta a un rendimiento constante, costos estables y límites claros de privacidad. Ejecuta un modelo de lenguaje grande localmente, añade una interfaz sencilla y limita el acceso a los dispositivos y personas en las que confías. Luego mejora basado en el uso real, como almacenamiento más rápido para cargas más ágiles, seguridad reforzada o RAG para un conjunto pequeño de documentos. Construye una configuración de homelab en la que puedas confiar y deja que tu IA local se gane su lugar en tu flujo de trabajo diario desde hoy mismo.

Preguntas frecuentes

P1: ¿Puedo ejecutar un LLM local en un mini servidor de bajo consumo en un homelab?

Sí, en muchos casos, especialmente para tareas de escritura ligeras y prompts cortos. Espera respuestas más lentas en sistemas solo con CPU, y elige modelos más pequeños o más cuantizados. Si quieres un uso diario más fluido, planea suficiente RAM y almacenamiento NVMe rápido para reducir los retrasos de carga.

P2: ¿Funcionará la IA local en mi laptop y aún se integrará con mis servicios de homelab?

Sí, a menudo. Puedes ejecutar el modelo localmente en una laptop para viajar, luego dirigir tus herramientas a un endpoint del homelab en casa cuando estés en tu LAN o VPN. Mantén las configuraciones simples usando un patrón de API local consistente y una sola interfaz.

P3: ¿Necesito acceso a internet para usar IA autoalojada después de la configuración?

No, no para inferencia básica una vez que el entorno de ejecución y los modelos están instalados. Algunas funciones aún pueden depender de servicios en red, como descargar nuevos modelos, actualizar contenedores o sincronizar documentos. Para un flujo de trabajo verdaderamente offline, descarga los modelos con anticipación y mantén la documentación y los embeddings locales en el almacenamiento de tu homelab.

P4: ¿Cómo evito que mi chatbot local filtre datos privados a otros usuarios?

Usa cuentas separadas y permisos estrictos por espacio de trabajo o conjunto de datos. Limita las fuentes de recuperación a carpetas específicas y evita indexar directorios compartidos del hogar. El registro también es importante. Mantén los registros mínimos y revísalos para contenido sensible. En un homelab multiusuario, aísla los servicios con contenedores y reglas de red.

P5: ¿Cuál es una forma razonable de estimar las necesidades de almacenamiento para LLMs locales y búsqueda de documentos?

Planifica para el crecimiento. Uno o dos modelos pueden encajar cómodamente, pero las colecciones se expanden rápidamente. Considera decenas de gigabytes como punto de partida, luego añade espacio para múltiples modelos, archivos de caché y un índice de recuperación para tus documentos. NVMe ayuda al rendimiento, mientras que discos duros más grandes pueden almacenar archivos archivados.

Centro de Campañas Zima

Más para leer

Guía de monitoreo para ZimaCube Home Lab: de Uptime Kuma a agentes de IA

Monitorea tu servidor doméstico con Uptime Kuma, Pulse, Proxmox Data Center Manager o un agente de IA para rastrear el tiempo de actividad, las...

De Sparcstation a ZimaBlade: El viaje de autoalojamiento de un geek de 57 años

Un profesional administrativo francés reemplazó su Raspberry Pi 4 averiada con un ZimaBlade 7700, ejecutando Debian 13, XFS y BorgBackup. Construcción completa del servidor...

ZimaCube vs NAS DIY: ¿Cuál es el adecuado para ti?

¿NAS preconstruido o bricolaje? Desglosamos los costos reales, el tiempo de configuración, Thunderbolt 4 y las diferencias de mantenimiento para ayudarte a decidir qué...