L'IA cloud può sembrare senza sforzo finché non tocca qualcosa che non caricheresti mai volontariamente. File dei clienti, appunti privati, documenti interni, foto di famiglia, anche bozze portano tutti alla stessa domanda: chi altro può vedere questo? Eseguire un modello linguistico di grandi dimensioni localmente mantiene quel contenuto sull'hardware che controlli, offrendo comunque la velocità e la comodità che le persone si aspettano dall'IA moderna.

Una configurazione locale guadagna fiducia solo se rimane affidabile. Ciò significa costi prevedibili, accesso offline quando necessario e un sistema che puoi mantenere come qualsiasi altro servizio. Per molte persone, un homelab è la casa naturale per l'IA privata perché si basa già sulle abitudini che mantengono la stabilità: confini chiari, backup e impostazioni sensate.

Scegli il tuo caso d'uso dell'IA locale e le metriche di successo

L'IA locale funziona meglio quando ha un compito chiaro. Decidi cosa vuoi che il modello faccia più spesso, perché quella singola scelta determina tutto il resto: dimensione del modello, necessità di memoria, disposizione dell'archiviazione e strumenti da installare.

La maggior parte delle configurazioni homelab rientra in pochi schemi ripetibili:

- Assistente di scrittura privato per email, relazioni, riassunti e riscritture

- Supporto alla programmazione per spiegare codice, generare test e progettare refactoring

- Domande e risposte su documenti su manuali, PDF, appunti e basi di conoscenza

- Produttività offline quando la connettività è limitata o preferisci un flusso di lavoro isolato

- Operazioni domestiche come progetti casalinghi, garanzie e inventari

Scegli due o tre misure per capire cosa funziona e cosa necessita di correzioni:

| Metrica | Cosa significa nella pratica | Come misurarla |

| Reattività | Le risposte arrivano abbastanza velocemente da mantenere il flusso | Cronometra i tuoi prompt comuni |

| Qualità dell'output | Meno affermazioni errate e migliore struttura | Confronta le risposte su un piccolo set di test |

| Confine della privacy | Solo fonti approvate appaiono nelle risposte | Verifica delle citazioni e dell'ambito di recupero |

| Affidabilità | Il servizio rimane attivo e si ripristina senza problemi | Test di riavvio, test di aggiornamento, test di ripristino |

| Controllo dei costi | Nessuna bolletta a sorpresa, consumo energetico stabile | Monitora il consumo energetico e la spesa hardware |

Costruisci una base hardware bilanciata per l'inferenza locale

La selezione dell'hardware è più semplice di quanto sembri quando ti concentri sull'essenziale. L'inferenza locale è un equilibrio tra calcolo, memoria e archiviazione, modellato dal tuo flusso di lavoro e dalle tue aspettative. Esistono due percorsi principali:

1. Inferenza focalizzata sulla CPU: Può funzionare perfettamente per modelli più piccoli e per attività in background come l’indicizzazione di documenti. Può sembrare lenta per chat interattive lunghe, specialmente con finestre di contesto più ampie.

2. Inferenza accelerata: Una GPU discreta o altro acceleratore di solito migliora la velocità di generazione e rende modelli più grandi utilizzabili quotidianamente. Cambia anche il modo in cui pensi alla memoria, poiché la VRAM diventa un vincolo chiave.

La memoria è di solito il vincolo decisivo. I pesi del modello occupano spazio, e il runtime necessita di spazio extra, quindi pianifica margine per il sistema operativo, i container e qualsiasi altro servizio che gira insieme all’inferenza. La quantizzazione aiuta a ridurre l’ingombro del modello, ma non elimina l’overhead.

Lo storage determina poi come il sistema si comporta quotidianamente. Le librerie di modelli crescono nel tempo, e dischi lenti trasformano riavvii e cambi di modello in attese lunghe. Ollama, un runtime LLM locale, nota che lo storage dei modelli può raggiungere decine o centinaia di gigabyte a seconda di cosa tieni installato, quindi posiziona modelli e indici vettoriali su storage veloce quando puoi, idealmente NVMe.

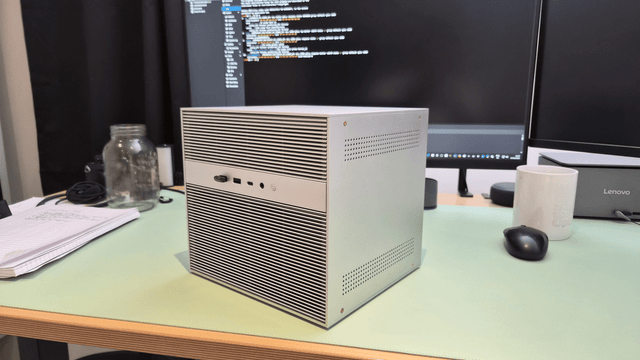

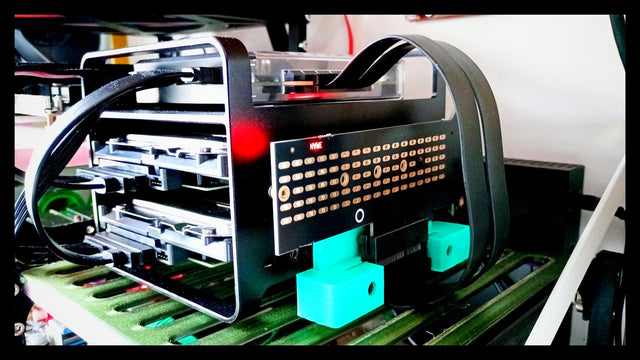

Se vuoi un server compatto progettato per carichi di lavoro self-hosted, un hardware espandibile può semplificare gli esperimenti. Un esempio è ZimaBoard 2, posizionato come server domestico con espansione PCIe che può supportare componenti aggiuntivi come storage più veloce o acceleratori per carichi di lavoro AI locali.

Per un homelab, “bilanciato” significa anche mantenibile: raffreddamento stabile, rumore prevedibile e un profilo energetico che non ti penalizza per l’uso 24/7.

Dimensione, Quantizzazione e Lunghezza del Contesto: Scegliere il Modello Giusto

Scegli il modello dopo aver deciso cosa il sistema deve fare bene. Per l'AI locale, tre fattori determinano l'esperienza: numero di parametri, quantizzazione e lunghezza del contesto.

1. Numero di parametri: I modelli più grandi generalmente gestiscono ragionamenti più complessi e mantengono coerenza in compiti più lunghi. I modelli più piccoli possono comunque essere eccellenti per riassunti, riscritture e molti compiti di programmazione, specialmente se abbinati a buoni prompt e recupero.

2. Quantizzazione: La quantizzazione rappresenta i pesi del modello a precisione inferiore per ridurre i costi di memoria e calcolo. È uno dei motivi principali per cui i LLM locali sono pratici su hardware consumer. Aspettati un compromesso: la precisione inferiore spesso consente di usare meno memoria e può essere più veloce, ma può anche ridurre l'accuratezza, specialmente nei casi limite.

3. Lunghezza del contesto: Un contesto lungo sembra allettante, ma può rallentare l'elaborazione dei prompt e aumentare la pressione sulla memoria. Un modello con una finestra di contesto enorme può comunque sembrare lento se l'hardware fatica a gestire l'ingestione dei prompt.

Modo pratico per scegliere: mantieni un modello reattivo per l'uso quotidiano, aggiungi un secondo solo quando risolve una lacuna specifica, poi convalida con i tuoi prompt. Usa un piccolo set di test: un prompt di scrittura con tono controllato, una domanda su un documento che richiede citazioni, un compito reale di programmazione e un prompt ambiguo per verificare fatti inventati. In un homelab, il miglior modello è quello che puoi usare tutta la settimana senza crash.

Installa uno stack locale semplice con Ollama e un'interfaccia web

Mantieni la prima distribuzione minima. Una macchina esegue l'inferenza ed espone un'API locale, poi gli altri dispositivi vi accedono tramite LAN. Questa configurazione è facile da debuggare, sicura e semplice da mantenere in un homelab.

Ollama funziona bene come runtime perché gestisce download, archiviazione e servizio dei modelli in un unico posto. Pianifica il disco fin dal primo giorno. Le librerie di modelli crescono rapidamente, ed è comune che i modelli installati raggiungano decine o centinaia di gigabyte col tempo. Metti la directory dei modelli su un volume spazioso e veloce, idealmente NVMe, così il caricamento e il cambio dei modelli non diventano un fastidio costante.

Un flusso di distribuzione pratico:

- Installa Ollama sulla macchina che eseguirà l'inferenza.

- Scarica un modello che rientri nei limiti di memoria.

- Verifica una richiesta locale sulla stessa macchina.

- Verifica l'accesso da un altro dispositivo sulla tua LAN.

Aggiungi un'interfaccia web per la cronologia chat, le sessioni e i controlli di base.

Per il livello di interfaccia, Open WebUI è adatto perché è progettato per il self-hosting, funziona offline e supporta API chat compatibili con OpenAI. Questa compatibilità API è importante quando vuoi collegare un modello locale a editor, strumenti per appunti e script semplici senza rifare le integrazioni.

Prima di aggiungere altre funzionalità, rendi il setup resiliente:

- Esegui Ollama come servizio che sopravvive ai riavvii

- Conserva i dati di Open WebUI così gli aggiornamenti non resettano la configurazione

- Mantieni l'accesso LAN solo durante i primi test

- Annota porte, percorsi e volumi in un breve README

Una volta che questa base è stabile, aggiungere RAG e rafforzare la sicurezza diventa semplice.

Aggiungi RAG per far usare al modello i tuoi file e appunti

Un modello locale è potente, ma non conosce automaticamente i tuoi documenti. Copia e incolla funziona per un paragrafo, poi si rompe per flussi di lavoro reali. RAG, abbreviazione di retrieval augmented generation, risolve questo recuperando testo rilevante dai tuoi file e fornendolo al modello come contesto per ogni risposta.

RAG funziona meglio quando la pipeline è esplicita. Questo aiuta anche con la privacy, perché puoi definire quali fonti sono consentite.

Una tipica pipeline RAG ha queste fasi distinte:

- Ingestione: raccoglie documenti da cartelle approvate

- Chunking: suddivide il testo in segmenti adatti al recupero

- Embedding: rappresenta i chunk come vettori

- Indicizzazione: memorizza vettori più metadati

- Recupero: estrai le migliori corrispondenze per una domanda

- Risposta: genera una risposta basata sul testo recuperato

- Citazioni: mostra quali fonti sono state usate

Prima di aggiungere qualsiasi automazione, decidi come deve essere un risultato “buono”. Questi controlli rendono più facile verificare il comportamento RAG:

- Le risposte includono citazioni chiare al file e alla sezione esatti

- Il sistema si rifiuta di rispondere quando il recupero non restituisce nulla di rilevante

- Le cartelle sensibili sono escluse di default, poi aggiunte intenzionalmente

- Il processo di aggiornamento dell'indice è prevedibile e registrato

La suddivisione in chunk è un punto di fallimento comune. Se i chunk sono enormi, il recupero restituisce un muro di testo. Se i chunk sono minuscoli, il contesto si perde. Un buon compromesso varia in base al tipo di documento, quindi prova sui tuoi file reali, poi regola. In un homelab, quella regolazione diventa un investimento una tantum che continua a ripagare ogni giorno.

Proteggi e Mantieni i Tuoi Servizi di AI Privata a Casa

L'AI locale è ancora un servizio di rete, e i servizi di rete vengono esposti accidentalmente tutto il tempo. Un port forwarding, un reverse proxy mal configurato o una regola “temporanea” possono trasformare un endpoint privato in uno pubblico.

Priorità di sicurezza, in ordine:

- Controllo accessi: autenticazione forte, account minimi, privilegi ridotti al minimo

- Ambito di rete: solo LAN di default, regole esplicite per ogni accesso remoto

- Sicurezza del trasporto: TLS per tutto ciò che esce da localhost

- Igiene dei segreti: evita di codificare chiavi in modo rigido in configurazioni e log

- Disciplina delle patch: aggiornamenti regolari per OS, container e interfaccia web

- Backup e ripristini: i backup sono reali solo dopo un test di ripristino

Per l'accesso remoto, preferisci una VPN o un tunnel affidabile rispetto a porte aperte. Se usi un reverse proxy, tienilo protetto dietro autenticazione e limiti di velocità. Questo è in linea con le linee guida di sicurezza API in stile OWASP, che evidenziano ripetutamente l'autenticazione e l'autorizzazione difettose come cause comuni di fallimenti nei sistemi reali.

La manutenzione è ciò che distingue una demo del weekend da un assistente privato affidabile. Una routine leggera funziona bene:

- Settimanale: controlla la crescita del disco per i file dei modelli e gli indici

- Mensile: applica aggiornamenti e riavvia durante una finestra a basso impatto

- Trimestrale: verifica i backup, ruota le credenziali, rivedi i servizi esposti

Tratta il tuo stack di AI locale come qualsiasi altro servizio fondamentale nel tuo homelab. Questo approccio riduce l'ansia e mantiene intatta la promessa di privacy.

Metti Online il Tuo Homelab di AI Privata Oggi!

Per rendere pratica l'intelligenza artificiale privata a casa, concentrati su affidabilità e tranquillità. Punta a prestazioni costanti, costi stabili e confini chiari per la privacy. Esegui un grande modello linguistico localmente, aggiungi un'interfaccia semplice e limita l'accesso ai dispositivi e alle persone di cui ti fidi. Poi migliora in base all'uso reale, come uno storage più veloce per caricamenti rapidi, una sicurezza più forte o RAG per un piccolo set di documenti. Costruisci un setup homelab su cui puoi contare e lascia che la tua AI locale guadagni il suo posto nel tuo flusso di lavoro quotidiano a partire da oggi!

Domande frequenti

D1: Posso eseguire un LLM locale su un mini server a basso consumo in un homelab?

Sì, in molti casi, specialmente per compiti di scrittura leggeri e prompt brevi. Aspettati risposte più lente su sistemi solo CPU, e scegli modelli più piccoli o fortemente quantizzati. Se vuoi un uso quotidiano più fluido, pianifica abbastanza RAM e storage NVMe veloce per ridurre i ritardi di caricamento.

D2: L'AI locale funziona sul mio laptop e si integra ancora con i servizi del mio homelab?

Sì, spesso. Puoi eseguire il modello localmente su un laptop in viaggio, poi puntare i tuoi strumenti a un endpoint homelab a casa quando sei sulla tua LAN o VPN. Mantieni le configurazioni semplici usando un pattern API locale coerente e un'interfaccia unica.

D3: Ho bisogno di accesso a internet per usare l'AI self-hosted dopo la configurazione?

No, non per l'inferenza di base una volta installati runtime e modelli. Alcune funzionalità possono comunque dipendere da servizi di rete, come scaricare nuovi modelli, aggiornare container o sincronizzare documenti. Per un vero flusso di lavoro offline, scarica i modelli in anticipo e conserva documentazione ed embedding localmente sullo storage del tuo homelab.

D4: Come posso evitare che il mio chatbot locale perda dati privati ad altri utenti?

Usa account separati e permessi rigorosi per ogni workspace o dataset. Limita le fonti di recupero a cartelle specifiche ed evita di indicizzare directory condivise della home. Anche il logging è importante. Mantieni i log minimi e controllali per contenuti sensibili. In un homelab multiutente, isola i servizi con container e regole di rete.

D5: Qual è un modo ragionevole per stimare le esigenze di archiviazione per LLM locali e ricerca documenti?

Pianifica la crescita. Uno o due modelli possono andare bene, ma le collezioni si espandono rapidamente. Considera decine di gigabyte come punto di partenza, poi aggiungi spazio per più modelli, file di cache e un indice di recupero per i tuoi documenti. NVMe migliora le prestazioni, mentre HDD più grandi possono contenere archivi.

Centro Campagna Zima

Altro da leggere

Guida al Monitoraggio del Home Lab ZimaCube: Da Uptime Kuma agli Agenti AI

Monitora il tuo server domestico con Uptime Kuma, Pulse, Proxmox Data Center Manager o un agente AI per tracciare il tempo di attività, i...

Da Sparcstation a ZimaBlade: il viaggio di self-hosting di un geek di 57 anni

Un professionista amministrativo francese ha sostituito il suo Raspberry Pi 4 guasto con uno ZimaBlade 7700, eseguendo Debian 13, XFS e BorgBackup. Costruzione completa...

ZimaCube vs NAS fai-da-te: quale è la scelta giusta per te?

NAS preassemblato o fai-da-te? Analizziamo i costi reali, i tempi di configurazione, Thunderbolt 4 e le differenze di manutenzione per aiutarti a decidere quale...