Pendant longtemps, un ordinateur monocarte ARM et un disque dur de rechange suffisaient pour se considérer comme un homelabber. Raspberry Pi a rendu tout cela accessible. Les coûts restaient bas, la consommation électrique négligeable, et une communauté dynamique signifiait que les réponses n’étaient jamais loin.

Mais à mesure que les réseaux domestiques sont devenus plus rapides, que les bibliothèques multimédias se sont alourdies, et que l’auto-hébergement s’est étendu au-delà d’une seule application vers un écosystème complet de services, le même matériel qui semblait libérateur est devenu une limite. La conversation dans les communautés homelab a discrètement évolué de « comment configurer ça ? » à « pourquoi ça ne fonctionne pas correctement ? » Cette question, le plus souvent, renvoie à l’architecture sous-jacente.

Pourquoi ARM domine encore les homelabs d’entrée de gamme en 2026

Les ordinateurs monocartes basés sur ARM occupent une place réelle et légitime dans le paysage du homelab. Le Raspberry Pi 5, équipé d’un processeur quad-core Arm Cortex-A76 à 2,4 GHz avec jusqu’à 8 Go de RAM, gère Pi-hole, des instances Nextcloud légères, et l’automatisation domestique basique sans problème. La consommation électrique est d’environ 3W au repos, ce qui représente des économies significatives sur une année de fonctionnement 24/7.

L’écosystème construit autour de ces cartes est vraiment impressionnant. Des années de guides communautaires, d’images OS préconstruites, et de forums actifs signifient que presque tous les problèmes ont une solution documentée. Pour quelqu’un qui débute dans l’auto-hébergement, ou qui fait tourner quelques conteneurs peu exigeants, ARM reste un point d’entrée parfaitement raisonnable.

Les véritables limites de l’utilisation d’ARM dans votre homelab

Il y a une frustration spécifique que les passionnés d’ARM en homelab rencontrent souvent au même stade de leur parcours. Le système qui fonctionnait parfaitement avec deux ou trois conteneurs Docker commence à mal se comporter lorsqu’on le sollicite davantage. Les causes profondes méritent d’être bien comprises, car elles sont architecturales plutôt qu’incidentes. Trois limitations distinctes reviennent fréquemment dans les discussions communautaires, chacune affectant une couche différente de la pile.

Compatibilité logicielle

De nombreuses applications serveur distribuent des binaires x86 précompilés comme format principal. Des versions ARM existent pour des outils populaires comme Plex, Jellyfin et Nextcloud, mais elles accusent souvent un retard fonctionnel, reçoivent des correctifs de sécurité plus lents ou nécessitent des étapes de compilation supplémentaires. Des hyperviseurs comme Proxmox VE et des distributions de pare-feu telles que pfSense et OPNsense sont conçus et optimisés pour x86-64. Les faire fonctionner sur ARM implique des contournements allant de l'inconfortable au véritablement instable.

Extension et E/S

La plupart des ordinateurs monocartes ARM connectent le stockage et les périphériques via USB ou une interface PCIe restreinte. Le stockage attaché en USB convient pour des tâches NAS légères, mais sous une pression simultanée de lecture/écriture de plusieurs clients, le plafond de débit devient rapidement évident. Une véritable extension PCIe, capable d'accueillir des disques NVMe, des cartes réseau 10GbE ou des accélérateurs de calcul, est soit absente soit limitée à une seule voie lente sur la plupart des cartes ARM grand public.

Comportement sous charge soutenue

Les SoC ARM sont conçus pour des charges mobiles et embarquées, où la performance en rafale est plus importante que le débit continu. Exécuter un travail de transcodage en parallèle de plusieurs conteneurs actifs et d'une sauvegarde programmée crée une charge stable pour laquelle ces puces n'ont jamais été optimisées. La limitation thermique sous charges continues est un problème documenté sur plusieurs générations de cartes ARM, et le refroidissement passif ne fait qu'aggraver le problème avec le temps.

Pourquoi x86 offre plus de marge de croissance à votre homelab

La transition vers x86 dans le matériel serveur de petit format n'est pas une nouveauté, mais l'économie s'est nettement améliorée avec la gamme de processeurs Alder Lake-N d'Intel. Des puces comme le N100 et le N150 offrent des performances quad-core avec un TDP nominal de 6W, rendant le déploiement en permanence vraiment pratique sans ventilateur bruyant ni coût électrique notable. Les avantages s'accumulent dans trois domaines où ARM rencontre régulièrement des difficultés.

| Domaine | Homelab ARM | Homelab x86 |

| Support des OS | Images personnalisées, distributions limitées | Toute distro Linux standard, support complet Proxmox/TrueNAS |

| Virtualisation | Limité, pas de support matériel VT | KVM avec Intel VT-x, performances VM proches du natif |

| Réseau | Typiquement 1 GbE max | Double 2,5 GbE standard, 10 GbE via PCIe |

| Extension PCIe | Absent ou restreint | Slot x4 complet pour NVMe, cartes réseau, accélérateurs |

| Écosystème logiciel | Versions ARM souvent retardées | Binaires x86 natifs, pas de recompilation nécessaire |

Côté logiciel, toute distribution Linux standard qui s’installe sur un ordinateur portable classique s’installe sur du matériel homelab x86 sans modification. Proxmox VE se déploie depuis l’ISO officielle. TrueNAS SCALE fonctionne exactement comme documenté. pfSense et OPNsense se comportent comme leurs wikis le décrivent. L’absence de friction spécifique à l’architecture signifie que le temps est consacré à la configuration réelle plutôt qu’au débogage de compatibilité.

La virtualisation raconte une histoire similaire. KVM, l’hyperviseur basé sur le noyau natif de Linux, fonctionne avec la virtualisation assistée par matériel via les extensions Intel VT-x, permettant à plusieurs machines virtuelles isolées de partager un hôte physique avec des performances proches du natif. Exécuter une VM dédiée pour un serveur multimédia, une autre pour un pare-feu, et une troisième pour le développement est une configuration courante d’homelab x86. Tenter la même chose sur ARM implique des compromis qui réduisent rapidement les avantages.

Votre homelab dépasse-t-il sa carte ARM ?

Pour de nombreux homelabbers, la réponse honnête est oui. Une fois qu’une configuration dépasse quelques conteneurs pour entrer dans un véritable environnement multi-services, les cartes ARM montrent leurs limites de manière prévisible. Quelques scénarios spécifiques reviennent souvent dans les discussions communautaires et méritent d’être identifiés tôt.

La transcodification de serveur multimédia est le point de bascule le plus courant. Plex et Jellyfin prennent tous deux en charge la transcodification accélérée par matériel sur les processeurs Intel via Quick Sync Video. Sur une puce Intel N-series moderne, convertir un flux 4K HEVC en H.264 pour un client qui ne peut pas le lire nativement consomme une fraction des ressources CPU qu’exige la transcodification logicielle. Les cartes ARM manquent soit totalement de cette accélération, soit la supportent de manière inégale, selon la pile de pilotes. Pour quiconque vise plusieurs flux simultanés, x86 est le choix pratique.

L'hébergement de serveurs de jeux révèle des lacunes similaires. La plupart des serveurs de jeux multijoueurs communautaires distribuent des binaires compilés principalement pour x86, et les faire tourner sur ARM signifie souvent recourir à l'émulation via QEMU ou à des builds communautaires non officiels qui peuvent ne pas rester à jour avec les versions officielles. Au-delà de la compatibilité, la performance soutenue en mono-thread, dont dépendent fortement les taux de tick des serveurs de jeux, favorise les puces x86 modernes par rapport à ARM à prix comparable.

La virtualisation multi-services est le troisième critère à considérer. Si l'objectif est un nœud Proxmox exécutant simultanément des VM isolées pour un NAS, un proxy inverse, un point d'accès VPN et un hub domotique, ARM n'est pas la bonne base. L'écosystème hyperviseur et le support matériel de la virtualisation sur x86 sont tout simplement d'une autre catégorie.

Ce qu'il faut rechercher dans une carte Homelab x86

La consommation électrique est importante pour du matériel toujours allumé. Les benchmarks communautaires montrent régulièrement que les processeurs Intel N100 et N150 maintiennent environ 10-12W sous des charges mixtes réelles, incluant conteneurs, VM légères et tâches multimédia simultanées. Cela est compétitif avec des configurations ARM en cluster tentant des charges équivalentes, et remet en question l'idée que x86 signifie automatiquement des coûts énergétiques plus élevés.

L'extensibilité PCIe mérite une attention particulière. Un slot PCIe 3.0 x4 ouvre la voie aux mises à niveau vers des adaptateurs de stockage NVMe, des contrôleurs SATA supplémentaires, des cartes réseau 10GbE et des cartes accélératrices d'IA à faible consommation. Le double Ethernet est à privilégier pour quiconque prévoit une segmentation réseau, une VM routeur dédiée ou des configurations multi-WAN. La mémoire eMMC intégrée pour le disque de démarrage de l'OS est un détail pratique qui libère entièrement la bande passante SATA et NVMe pour les charges de travail de stockage.

La compatibilité des OS doit être vérifiée avant de s'engager sur une carte. Les plateformes basées sur des chipsets Intel standards avec un support du noyau Linux mainline ont tendance à offrir le moins de surprises après déploiement. L'activité communautaire autour d'une carte spécifique, les fils de discussion sur les forums, les problèmes GitHub et les constructions documentées sont des indicateurs fiables du niveau de support matériel au quotidien.

| Facteur | Ce qu'il faut prioriser |

| Processeur | Intel N100 / N150 (Alder Lake-N) |

| Consommation électrique | 10-12W en charge typique |

| PCIe | Slot x4 minimum pour extension future |

| Réseau | Double 2,5GbE ou mieux |

| Entrées/sorties de stockage | Support natif SATA + NVMe |

| Support des OS | Proxmox VE, TrueNAS, Debian, Ubuntu vérifiés |

Construisez un Homelab Plus Intelligent Autour d'une Seule Carte x86

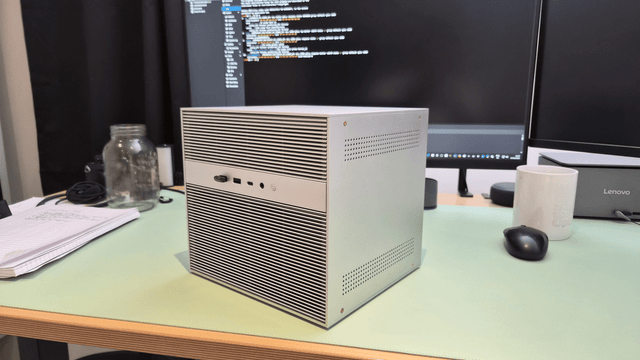

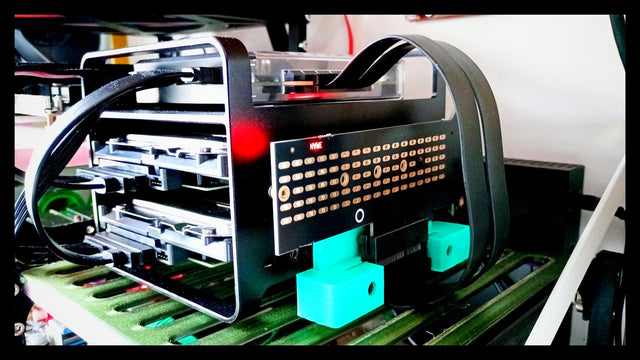

La plupart des homelabs ne commencent pas complexes. Ils évoluent un appareil à la fois, jusqu’à ce que l’étagère contienne trois cartes, deux blocs d’alimentation, et une surcharge de gestion imprévue. Une seule carte x86 performante change complètement cette dynamique. Des cartes comme la ZimaBoard 2 consolident NAS, virtualisation, routage et diffusion multimédia en une unité sans ventilateur, réduisant à la fois l’encombrement physique et la maintenance continue. La mise à niveau depuis ARM est moins un échange matériel qu’un changement dans la capacité réaliste d’un homelab à gérer sans lutter contre ses propres fondations.

FAQ

Q1 : Passer à une plateforme x86 basée sur Intel N100 garantit-il un encodage matériel AV1 complet ?

Généralement non. Bien que Alder Lake-N (N100/N150) offre un excellent décodage matériel pour AV1, l’encodage matériel nécessite généralement des puces Intel Arc ou Core Ultra plus haut de gamme. Pour les tâches lourdes de ré-encodage en 2026, vous dépendrez toujours de la puissance brute du CPU x86 ou d’un GPU externe, plutôt que d’un bloc d’encodage embarqué dédié.

Q2 : Puis-je utiliser de la mémoire ECC sur des cartes x86 d’entrée de gamme pour éviter la corruption des données ?

Typiquement non. La plupart des cartes mères grand public de la série N utilisent de la RAM SODIMM non ECC ou du LPDDR5 soudé. Si votre objectif est une intégrité des données ZFS de niveau entreprise, vous devez généralement passer à des plateformes Intel Atom C-series ou Xeon-D. Les cartes ARM partagent cette limitation, offrant rarement de l’ECC en dehors des modules industriels coûteux.

Q3 : Le x86 est-il intrinsèquement meilleur pour héberger des modèles d’IA locaux comme les LLM ou Frigate ?

Ça dépend. Le x86 l’emporte en flexibilité ; vous pouvez facilement ajouter un TPU Coral ou un GPU NVIDIA via PCIe. Cependant, en 2026, certains SoC ARM haut de gamme disposent de NPU spécialisés qui surpassent les puces x86 d’entrée de gamme dans certaines tâches de détection d’objets. Le x86 reste le « choix sûr » pour une compatibilité large avec les bibliothèques logicielles.

Q4 : Puis-je « échanger à chaud » mes conteneurs Docker ARM existants directement sur un hôte x86 ?

Non. Bien que vos fichiers de configuration (YAML) et volumes de données soient portables, les images de conteneurs sous-jacentes sont spécifiques à l’architecture. Vous devez récupérer la version amd64 de chaque image. Heureusement, la plupart des registres modernes utilisent des tags « multi-arch », donc un simple Docker Compose pull sur votre nouvelle machine x86 récupère généralement automatiquement le binaire correct.

Q5 : Dois-je retirer mes anciennes cartes ARM une fois que le serveur x86 est opérationnel ?

Pas nécessairement. Les homelabs les plus efficaces en 2026 utilisent une approche « hybride ». Gardez vos cartes ARM comme des nœuds périphériques légers. Ils sont parfaits pour des nœuds « témoins » à faible consommation dans un cluster Proxmox (pour maintenir le Quorum), des passerelles Zigbee/Z-Wave dédiées, ou des points d’accès WireGuard distants qui restent en ligne même pendant la maintenance du serveur principal.

Centre de campagne Zima

À lire aussi

Guide de surveillance du laboratoire domestique ZimaCube : de Uptime Kuma aux agents IA

Surveillez votre serveur domestique avec Uptime Kuma, Pulse, Proxmox Data Center Manager ou un agent IA pour suivre le temps de fonctionnement, les sauvegardes,...

De Sparcstation à ZimaBlade : le parcours d’auto-hébergement d’un geek de 57 ans

Un professionnel administratif français a remplacé son Raspberry Pi 4 défaillant par un ZimaBlade 7700, fonctionnant sous Debian 13, XFS et BorgBackup. La construction...

ZimaCube vs NAS DIY : Lequel vous convient le mieux ?

NAS préconstruit ou bricolé ? Nous décomposons les coûts réels, le temps d'installation, Thunderbolt 4 et les différences de maintenance pour vous aider à...