Przez długi czas jednopłytkowy komputer ARM i zapasowy dysk twardy wystarczały, by nazwać się homelabberem. Raspberry Pi uczyniło to wszystko dostępnym. Koszty pozostawały niskie, zużycie energii było znikome, a prężna społeczność oznaczała, że odpowiedzi nigdy nie były daleko.

Jednak wraz z przyspieszeniem sieci domowych, rozrostem bibliotek multimediów i rozszerzeniem self-hostingu z pojedynczej aplikacji do całego ekosystemu usług, ten sam sprzęt, który kiedyś dawał poczucie wolności, zaczął przypominać sufit. Rozmowy w społecznościach homelabowych cicho przesunęły się z „jak to skonfigurować?” na „dlaczego to nie działa poprawnie?” To pytanie, częściej niż nie, odnosi się do architektury pod spodem.

Dlaczego ARM wciąż dominuje w homelabach na poziomie podstawowym w 2026 roku

Jednopłytkowe komputery oparte na ARM mają realne i uzasadnione miejsce w krajobrazie homelabów. Raspberry Pi 5, wyposażony w czterordzeniowy procesor Arm Cortex-A76 o taktowaniu 2,4 GHz i do 8 GB RAM, bez problemu obsługuje Pi-hole, lekkie instancje Nextcloud oraz podstawową automatykę domową. Zużycie energii wynosi około 3W w trybie bezczynności, co przekłada się na znaczące oszczędności przy całorocznej pracy 24/7.

Ekosystem zbudowany wokół tych płytek jest naprawdę imponujący. Lata przewodników społecznościowych, gotowych obrazów systemów operacyjnych i aktywnych forów oznaczają, że prawie każdy problem ma udokumentowane rozwiązanie. Dla kogoś, kto dopiero zaczyna z self-hostingiem lub uruchamia kilka niewymagających kontenerów, ARM pozostaje całkowicie rozsądnym punktem startowym.

Prawdziwe ograniczenia uruchamiania ARM w Twoim homelabie

Istnieje specyficzna frustracja, na którą natrafiają entuzjaści ARM w homelabach mniej więcej w tym samym momencie swojej drogi. Konfiguracja, która działała płynnie z dwoma lub trzema kontenerami Docker, zaczyna sprawiać problemy, gdy jest bardziej obciążona. Warto jasno zrozumieć przyczyny, ponieważ są one architektoniczne, a nie przypadkowe. W dyskusjach społecznościowych pojawiają się trzy wyraźne ograniczenia, z których każde dotyczy innej warstwy stosu.

Kompatybilność oprogramowania

Wiele aplikacji serwerowych dystrybuuje prekompilowane binaria x86 jako główny format wydania. Istnieją wersje ARM popularnych narzędzi jak Plex, Jellyfin i Nextcloud, ale często są one mniej funkcjonalne, otrzymują wolniejsze poprawki bezpieczeństwa lub wymagają dodatkowych kroków kompilacji. Hyperwizory takie jak Proxmox VE oraz dystrybucje zapór sieciowych takie jak pfSense i OPNsense są budowane i optymalizowane pod x86-64. Uruchamianie ich na ARM wymaga obejść, które bywają niewygodne lub wręcz niestabilne.

Rozbudowa i I/O

Większość jednopłytkowych komputerów ARM łączy pamięć masową i peryferia przez USB lub ograniczony interfejs PCIe. Pamięć masowa podłączona przez USB sprawdza się do lekkich zadań NAS, ale pod jednoczesnym obciążeniem odczytu i zapisu z wielu klientów szybko ujawnia się limit przepustowości. Prawdziwa rozbudowa PCIe, taka, która obsługuje dyski NVMe, karty sieciowe 10GbE lub akceleratory obliczeniowe, jest albo nieobecna, albo ograniczona do pojedynczej wolnej linii na większości konsumenckich płyt ARM.

Zachowanie pod stałym obciążeniem

Układy ARM SoC są projektowane z myślą o zastosowaniach mobilnych i wbudowanych, gdzie ważniejsza jest wydajność chwilowa niż ciągły przepływ danych. Uruchomienie zadania transkodowania obok kilku aktywnych kontenerów i zaplanowanej kopii zapasowej tworzy obciążenie stałe, do którego te układy nigdy nie były optymalizowane. Termiczne ograniczanie taktowania pod ciągłym obciążeniem to udokumentowany problem w wielu generacjach płyt ARM, a pasywne chłodzenie tylko pogarsza sytuację z czasem.

Dlaczego x86 daje Twojemu homelabowi więcej przestrzeni do rozwoju

Przejście na x86 w małych serwerach o niewielkich rozmiarach nie jest nowym zjawiskiem, ale ekonomia znacznie się poprawiła dzięki procesorom Intel Alder Lake-N. Układy takie jak N100 i N150 oferują wydajność czterordzeniową przy deklarowanym TDP 6W, co sprawia, że ciągłe działanie jest naprawdę praktyczne bez głośnego wentylatora czy znaczących kosztów energii. Zalety kumulują się w trzech obszarach, z którymi ARM konsekwentnie ma problemy.

| Obszar | Homelab ARM | Homelab x86 |

| Wsparcie systemów operacyjnych | Obrazy niestandardowe, ograniczone dystrybucje | Dowolna standardowa dystrybucja Linuksa, pełne wsparcie Proxmox/TrueNAS |

| Wirtualizacja | Ograniczona, brak sprzętowego wsparcia VT | KVM z Intel VT-x, wydajność VM bliska natywnej |

| Sieć | Zwykle maksymalnie 1GbE | Standardowo podwójne 2,5GbE, 10GbE przez PCIe |

| Rozszerzenia PCIe | Brak lub ograniczony | Pełny slot x4 dla NVMe, kart sieciowych, akceleratorów |

| Ekosystem oprogramowania | Budowy ARM, często opóźnione | Natywne binaria x86, bez potrzeby rekompilacji |

Po stronie oprogramowania każda dystrybucja Linuksa działająca na standardowym laptopie instaluje się na sprzęcie homelabowym x86 bez modyfikacji. Proxmox VE instaluje się z oficjalnego ISO. TrueNAS SCALE działa dokładnie tak, jak opisano. pfSense i OPNsense zachowują się zgodnie z opisami w swoich wiki. Brak architektonicznych przeszkód oznacza, że czas poświęca się na rzeczywistą konfigurację, a nie na debugowanie kompatybilności.

Wirtualizacja opowiada podobną historię. KVM, natywny dla Linuksa hyperwizor oparty na jądrze, działa z wirtualizacją wspomaganą sprzętowo dzięki rozszerzeniom Intel VT-x, pozwalając wielu izolowanym maszynom wirtualnym współdzielić jeden fizyczny host z wydajnością bliską natywnej. Uruchomienie dedykowanej maszyny wirtualnej dla serwera multimediów, osobnej dla zapory sieciowej i trzeciej do pracy deweloperskiej to rutynowa konfiguracja homelabu x86. Próba tego samego na ARM wiąże się z kompromisami, które szybko zmniejszają korzyści.

Czy Twój homelab wyrasta z płytki ARM?

Dla wielu entuzjastów homelabów uczciwa odpowiedź brzmi tak. Gdy konfiguracja wykracza poza kilka kontenerów i wchodzi w prawdziwe wieloserwisowe środowisko, płytki ARM zwykle pokazują swoje ograniczenia w przewidywalny sposób. Kilka konkretnych scenariuszy pojawia się wielokrotnie w dyskusjach społeczności i warto je rozpoznać wcześnie.

Transkodowanie serwera multimediów to najczęstszy punkt zwrotny. Zarówno Plex, jak i Jellyfin obsługują sprzętowe przyspieszenie transkodowania na procesorach Intel dzięki Quick Sync Video. Na nowoczesnym chipie Intel serii N konwersja strumienia 4K HEVC do H.264 dla klienta, który nie może go odtwarzać natywnie, zużywa ułamek mocy CPU, jaką wymaga transkodowanie programowe. Płytki ARM albo całkowicie nie mają tej ścieżki przyspieszenia, albo obsługują ją nieregularnie, w zależności od stosu sterowników. Dla każdego, kto celuje w wiele jednoczesnych strumieni, x86 jest praktycznym wyborem.

Hosting serwerów gier ujawnia podobne braki. Większość serwerów gier multiplayer prowadzonych przez społeczność dystrybuuje binaria skompilowane głównie dla x86, a uruchamianie ich na ARM często oznacza poleganie na emulacji przez QEMU lub nieoficjalnych buildach społeczności, które mogą nie być aktualizowane zgodnie z oficjalnymi wydaniami. Poza kompatybilnością, utrzymująca się wydajność jednowątkowa, od której w dużej mierze zależą szybkości ticków serwerów gier, faworyzuje nowoczesne układy x86 w porównywalnych przedziałach cenowych.

Wirtualizacja wielousługowa to trzeci sygnał, na który warto zwrócić uwagę. Jeśli celem jest węzeł Proxmox uruchamiający izolowane maszyny wirtualne dla NAS, reverse proxy, punktu końcowego VPN i centrum automatyki domowej jednocześnie, ARM to niewłaściwa podstawa. Ekosystem hypervisora i wsparcie sprzętowej wirtualizacji na x86 są po prostu na innym poziomie.

Na co zwracać uwagę przy wyborze płyty x86 do homelabu

Pobór mocy ma znaczenie dla sprzętu działającego non-stop. Testy społecznościowe konsekwentnie pokazują, że procesory Intel N100 i N150 utrzymują około 10-12W przy mieszanych, rzeczywistych obciążeniach, w tym kontenerach, lekkich maszynach wirtualnych i zadaniach multimedialnych działających jednocześnie. To konkurencyjne wyniki w porównaniu do klastrów ARM próbujących obsłużyć podobne obciążenia i obala założenie, że x86 automatycznie oznacza wyższe koszty energii.

Możliwość rozbudowy PCIe zasługuje na szczególną uwagę. Slot PCIe 3.0 x4 otwiera drogę do rozbudowy o adaptery pamięci NVMe, dodatkowe kontrolery SATA, karty sieciowe 10GbE oraz energooszczędne karty akceleratorów AI. Podwójny Ethernet warto priorytetowo traktować dla osób planujących segmentację sieci, dedykowaną maszynę wirtualną routera lub konfiguracje multi-WAN. Wbudowane eMMC na dysk rozruchowy systemu operacyjnego to praktyczny detal, który pozwala zachować pełną przepustowość SATA i NVMe dla zadań związanych z pamięcią masową.

Zgodność systemu operacyjnego powinna być zweryfikowana przed podjęciem decyzji o wyborze płyty. Platformy oparte na standardowych chipsetach Intela z obsługą głównego jądra Linux mają zwykle najmniej niespodzianek po wdrożeniu. Aktywność społeczności wokół konkretnej płyty, wątki na forach, zgłoszenia na GitHub oraz udokumentowane budowy to wiarygodne wskaźniki, jak dobrze sprzęt jest faktycznie wspierany na co dzień.

| Czynnik | Co priorytetowo traktować |

| Procesor | Intel N100 / N150 (Alder Lake-N) |

| Pobór mocy | 10-12W przy typowym obciążeniu |

| PCIe | Minimum 4 sloty PCIe dla przyszłej rozbudowy |

| Sieć | Podwójne 2,5GbE lub lepsze |

| Wejście/wyjście pamięci masowej | Natychmiastowe wsparcie SATA + NVMe |

| Wsparcie systemów operacyjnych | Zweryfikowano z Proxmox VE, TrueNAS, Debian, Ubuntu |

Zbuduj inteligentniejszy homelab wokół jednej płyty x86

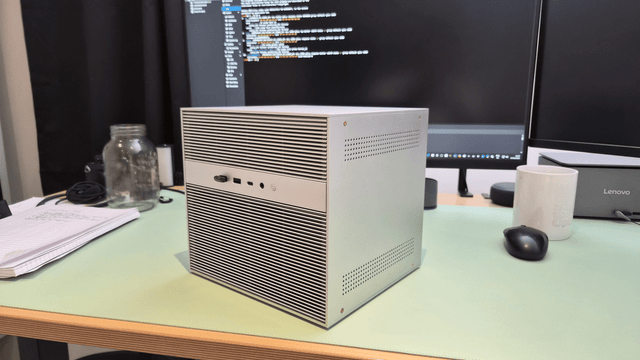

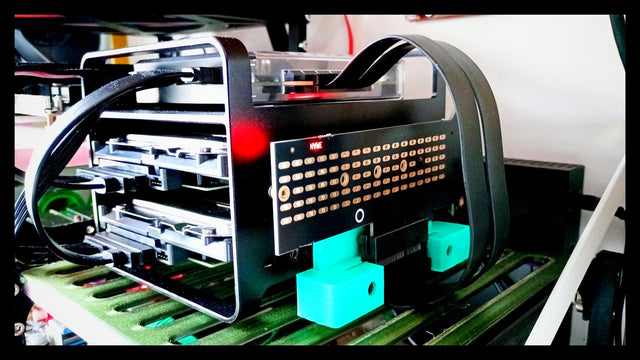

Większość homelabów nie zaczyna się od skomplikowanych rozwiązań. Rozwija się urządzenie po urządzeniu, aż na półce pojawią się trzy płytki, dwa zasilacze i nieplanowany narzut zarządzania. Jedna wydajna płyta x86 całkowicie zmienia tę dynamikę. Płytki takie jak ZimaBoard 2 łączą NAS, wirtualizację, routing i serwowanie mediów w jednej bezwentylatorowej jednostce, redukując zarówno fizyczny bałagan, jak i bieżącą konserwację. Przejście z ARM to mniej wymiana sprzętu, a bardziej zmiana tego, ile homelab może realistycznie obsłużyć bez walki z własnymi podstawami.

Najczęściej zadawane pytania

P1: Czy przejście na platformę x86 opartą na Intel N100 gwarantuje pełne sprzętowe kodowanie AV1?

Zazwyczaj nie. Chociaż Alder Lake-N (N100/N150) oferuje doskonałe sprzętowe dekodowanie AV1, sprzętowe kodowanie zwykle wymaga wyższej klasy chipów Intel Arc lub Core Ultra. Do intensywnych zadań ponownego kodowania w 2026 roku nadal będziesz polegać na surowej mocy CPU x86 lub zewnętrznej karcie GPU, a nie na dedykowanym bloku kodowania na płycie.

P2: Czy mogę używać pamięci ECC na podstawowych płytach x86, aby zapobiec uszkodzeniom danych?

Zazwyczaj nie. Większość konsumenckich płyt głównych serii N używa pamięci SODIMM bez ECC lub lutowanego LPDDR5. Jeśli celem jest korporacyjna integralność danych ZFS, zwykle trzeba przejść na platformy Intel Atom C-series lub Xeon-D. Płytki ARM mają podobne ograniczenia, rzadko oferując ECC poza drogimi modułami przemysłowymi.

P3: Czy x86 jest z natury lepsze do hostowania lokalnych modeli AI, takich jak LLM czy Frigate?

To zależy. x86 wygrywa pod względem elastyczności; łatwo dodasz Coral TPU lub kartę NVIDIA GPU przez PCIe. Jednak do 2026 roku niektóre wysokiej klasy SoC ARM mają wyspecjalizowane NPU, które przewyższają podstawowe chipy x86 w zadaniach wykrywania obiektów. x86 pozostaje „bezpiecznym wyborem” dla szerokiej kompatybilności bibliotek oprogramowania.

P4: Czy mogę „hot-swapować” moje istniejące kontenery Docker ARM bezpośrednio na hosta x86?

Nie. Chociaż twoje pliki konfiguracyjne (YAML) i wolumeny danych są przenośne, obrazy kontenerów są specyficzne dla architektury. Musisz pobrać wersję amd64 każdego obrazu. Na szczęście większość nowoczesnych rejestrów używa tagów „multi-arch”, więc proste polecenie Docker Compose pull na nowej maszynie x86 zazwyczaj automatycznie pobiera właściwy binarny plik.

P5: Czy powinienem wycofać moje stare płytki ARM, gdy serwer x86 będzie już działał?

Niekoniecznie. Najwydajniejsze homelaby 2026 roku stosują podejście „hybrydowe”. Trzymaj swoje płytki ARM jako lekkie edge nodes. Są idealne jako niskomocowe „witness” węzły w klastrze Proxmox (do utrzymania kworum), dedykowane bramki Zigbee/Z-Wave lub zdalne punkty końcowe WireGuard, które pozostają online nawet podczas konserwacji głównego serwera.

Centrum Kampanii Zima

Więcej do przeczytania

Przewodnik monitorowania laboratorium domowego ZimaCube: od Uptime Kuma do agentów AI

Monitoruj swój domowy serwer za pomocą Uptime Kuma, Pulse, Proxmox Data Center Manager lub agenta AI, aby śledzić czas pracy, kopie zapasowe, maszyny wirtualne,...

Od Sparcstation do ZimaBlade: 57-letnia podróż geeka przez self-hosting

Francuski specjalista ds. administracji zastąpił swojego niesprawnego Raspberry Pi 4 modelem ZimaBlade 7700, działającym na Debianie 13, XFS i BorgBackup. Pełna konfiguracja serwera kopii...

ZimaCube a DIY NAS: Który jest dla Ciebie odpowiedni?

Gotowy NAS czy zrób to sam? Analizujemy rzeczywiste koszty, czas konfiguracji, Thunderbolt 4 oraz różnice w utrzymaniu, aby pomóc Ci zdecydować, która konstrukcja naprawdę...