يمكن أن يبدو الذكاء الاصطناعي السحابي سهلاً حتى يلمس شيئًا لن تقوم بتحميله عمدًا أبدًا. ملفات العملاء، الملاحظات الخاصة، الوثائق الداخلية، صور العائلة، حتى المسودات الأولية كلها تؤدي إلى نفس السؤال: من يمكنه رؤية هذا أيضًا؟ تشغيل نموذج لغة كبير محليًا يحافظ على هذا المحتوى على الأجهزة التي تتحكم بها، مع تقديم السرعة والراحة التي يتوقعها الناس من الذكاء الاصطناعي الحديث.

لا يكسب الإعداد المحلي الثقة إلا عندما يظل موثوقًا. هذا يعني تكاليف متوقعة، وصول دون اتصال عند الحاجة، ونظام يمكنك صيانته مثل أي خدمة أخرى. بالنسبة لكثير من الناس، المختبر المنزلي هو المكان الطبيعي للذكاء الاصطناعي الخاص لأنه يعمل بالفعل على العادات التي تحافظ على الاستقرار: حدود واضحة، نسخ احتياطية، وإعدادات افتراضية معقولة.

اختر حالة استخدام الذكاء الاصطناعي المحلي ومقاييس النجاح الخاصة بك

يعمل الذكاء الاصطناعي المحلي بشكل أفضل عندما يكون لديه مهمة واضحة. قرر ما تريد أن يفعل النموذج في أغلب الأحيان، لأن هذا الاختيار الواحد يحدد كل شيء آخر: حجم النموذج، احتياجات الذاكرة، تخطيط التخزين، والأدوات التي تثبتها.

معظم إعدادات المختبر المنزلي تقع ضمن أنماط متكررة قليلة:

- مساعد كتابة خاص للبريد الإلكتروني، الموجزات، الملخصات، وإعادة الصياغة

- دعم البرمجة لشرح الكود، توليد الاختبارات، وصياغة إعادة الهيكلة

- الأسئلة والأجوبة على الوثائق عبر الكتيبات، ملفات PDF، الملاحظات، وقواعد المعرفة

- الإنتاجية دون اتصال عندما تكون الاتصال محدودًا، أو تفضل سير عمل معزول

- العمليات المنزلية مثل مشاريع المنزل، الضمانات، والجرد

اختر مقياسين أو ثلاثة حتى تتمكن من معرفة ما يعمل وما يحتاج إلى إصلاح:

| المقياس | ماذا تعني في التطبيق العملي | كيفية قياسها |

| الاستجابة | الوصول إلى الردود بسرعة كافية للحفاظ على التدفق | قياس وقت استجابات الطلبات الشائعة |

| جودة المخرجات | ادعاءات أقل خطأً وبنية أفضل | مقارنة الإجابات عبر مجموعة اختبار صغيرة |

| حدود الخصوصية | تظهر فقط المصادر المعتمدة في الإجابات | التحقق من الاقتباسات ونطاق الاسترجاع |

| الموثوقية | الخدمة تبقى متاحة وتتعافى بشكل نظيف | اختبار إعادة التشغيل، اختبار التحديث، اختبار الاستعادة |

| التحكم في التكلفة | لا فواتير مفاجئة، استهلاك طاقة مستقر | تتبع استهلاك الطاقة ونفقات الأجهزة |

بناء قاعدة أجهزة متوازنة للاستدلال المحلي

اختيار الأجهزة أبسط مما يبدو عندما تركز على الأساسيات. الاستدلال المحلي هو توازن بين الحوسبة والذاكرة والتخزين، يتشكل حسب سير عملك وتوقعاتك. هناك مساران رئيسيان:

1. الاستدلال المعتمد على المعالج المركزي: يمكن أن يكون عمليًا تمامًا للنماذج الأصغر وللمهام الخلفية مثل فهرسة المستندات. قد يبدو بطيئًا في المحادثات التفاعلية الطويلة، خاصة مع نوافذ السياق الأكبر.

2. الاستدلال المعزز: عادةً ما يحسن معالج الرسوميات المنفصل أو المسرع الآخر سرعة التوليد ويجعل النماذج الأكبر قابلة للاستخدام اليومي. كما يغير طريقة تفكيرك في الذاكرة، حيث تصبح ذاكرة الفيديو (VRAM) قيدًا رئيسيًا.

الذاكرة عادةً ما تكون القيد الحاسم. تأخذ أوزان النماذج مساحة، وتحتاج بيئة التشغيل إلى مساحة إضافية فوق ذلك، لذا خطط لهامش للأنظمة التشغيلية، والحاويات، وأي خدمات أخرى تعمل بجانب الاستدلال. يساعد التكميم في تقليل حجم النموذج، لكنه لا يلغي الحمل الزائد.

التخزين هو الذي يحدد شعور النظام يوميًا. تنمو مكتبات النماذج مع الوقت، والأقراص البطيئة تحول عمليات إعادة التشغيل وتبديل النماذج إلى انتظار طويل. Ollama، بيئة تشغيل محلية للنماذج اللغوية الكبيرة، تلاحظ أن تخزين النماذج يمكن أن يصل إلى عشرات أو مئات الجيجابايت حسب ما تحتفظ به مثبتًا، لذا ضع النماذج و فهرسات المتجهات على تخزين سريع عندما تستطيع، ويفضل أن يكون NVMe.

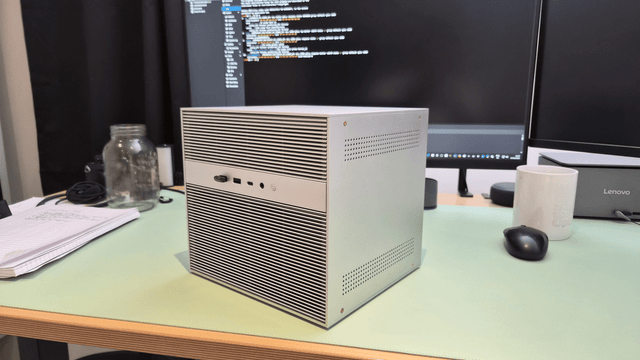

إذا كنت تريد خادمًا مضغوطًا مصممًا لأعباء العمل المستضافة ذاتيًا، يمكن للأجهزة التي تدعم التوسعة تسهيل التجارب. أحد الأمثلة هو ZimaBoard 2، الذي يُوضع كخادم منزلي مع توسعة PCIe يمكنها دعم إضافات مثل التخزين الأسرع أو مسرعات لأعباء عمل الذكاء الاصطناعي المحلية.

بالنسبة لـ مختبر منزلي، "المتوازن" يعني أيضًا قابلية الصيانة: تبريد مستقر، ضوضاء متوقعة، وملف طاقة لا يعاقبك على تشغيله 24/7.

الحجم، التكميم، وطول السياق: اختيار النموذج المناسب

اختر النموذج بعد أن تقرر ما الذي يجب أن ينجزه النظام بشكل جيد. بالنسبة للذكاء الاصطناعي المحلي، هناك ثلاثة عوامل تحدد التجربة: عدد المعاملات، التكميم، وطول السياق.

1. عدد المعاملات: النماذج الأكبر عمومًا تتعامل مع الاستدلال الأصعب وتحافظ على التماسك في المهام الأطول. النماذج الأصغر يمكن أن تكون ممتازة للتلخيص، إعادة الصياغة، والعديد من مهام الترميز، خاصة عند اقترانها بمطالبات جيدة واسترجاع.

2. التكميم: التكميم يمثل أوزان النموذج بدقة أقل لتقليل تكاليف الذاكرة والحوسبة. وهو أحد الأسباب الرئيسية التي تجعل نماذج LLM المحلية عملية على أجهزة المستهلكين. توقع مقايضة: الدقة الأقل غالبًا ما تعمل في ذاكرة أقل وقد تعمل بشكل أسرع، لكنها قد تقلل الدقة، خاصة في الحالات الحدية.

3. طول السياق: السياق الطويل يبدو جذابًا، لكنه قد يبطئ معالجة المطالبات ويزيد الضغط على الذاكرة. يمكن أن يشعر النموذج ذو نافذة السياق الضخمة بالبطء إذا كان جهازك يعاني مع استيعاب المطالبات.

طريقة عملية للاختيار: احتفظ بنموذج يومي واحد سريع الاستجابة، وأضف نموذجًا ثانيًا فقط عندما يحل فجوة محددة، ثم تحقق باستخدام مطالباتك الخاصة. استخدم مجموعة اختبار صغيرة: مطالبة كتابة بنبرة محددة، سؤال وثائقي يتطلب الاستشهادات، مهمة ترميز حقيقية، ومطالبة غامضة للتحقق من الحقائق المختلقة. في المختبر المنزلي، أفضل نموذج هو الذي يمكنك تشغيله طوال الأسبوع دون تعطل.

قم بتثبيت حزمة محلية بسيطة مع Ollama وواجهة ويب

اجعل النشر الأولي بسيطًا. جهاز واحد يشغل الاستدلال ويعرض API محلي، ثم تصل أجهزتك الأخرى إليه عبر شبكة LAN. هذا الترتيب سهل التصحيح، سهل التأمين، وبسيط الصيانة في مختبر منزلي.

يعمل Ollama بشكل جيد كبيئة تشغيل لأنه يدير تنزيلات النماذج، التخزين، والتقديم في مكان واحد. خطط للقرص من اليوم الأول. تنمو مكتبات النماذج بسرعة، ومن الشائع أن تصل النماذج المثبتة إلى عشرات إلى مئات الجيجابايت مع مرور الوقت. ضع دليل النموذج على وحدة تخزين واسعة وسريعة، ويفضل أن تكون NVMe، حتى لا يصبح تحميل وتبديل النماذج مصدر إزعاج مستمر.

تدفق نشر عملي:

- قم بتثبيت Ollama على الجهاز الذي سيشغل الاستدلال.

- اختر نموذجًا واحدًا يناسب حدود الذاكرة الخاصة بك.

- تحقق من طلب محلي على نفس الجهاز.

- تحقق من الوصول من جهاز آخر على شبكة LAN الخاصة بك.

أضف واجهة ويب لتاريخ الدردشة، الجلسات، والتحكمات الأساسية.

بالنسبة لطبقة الواجهة، Open WebUI مناسب لأنه مصمم للاستضافة الذاتية، يعمل دون اتصال، ويدعم واجهات برمجة تطبيقات الدردشة المتوافقة مع OpenAI. هذه التوافقية مع API مهمة عندما تريد ربط نموذج محلي بالمحررات، أدوات الملاحظات، والبرمجيات البسيطة دون إعادة تصميم تكاملاتك.

قبل إضافة المزيد من الميزات، اجعل الإعداد قويًا:

- شغّل Ollama كخدمة تبقى بعد إعادة التشغيل

- احتفظ ببيانات Open WebUI حتى لا تعيد التحديثات تعيين الإعدادات

- احتفظ بالوصول عبر الشبكة المحلية فقط خلال الاختبار المبكر

- دوّن المنافذ والمسارات والأحجام في ملف README قصير

بمجرد استقرار هذا الأساس، يصبح إضافة RAG وتشديد الأمان أمرًا بسيطًا.

أضف RAG للسماح للنموذج باستخدام ملفاتك وملاحظاتك

النموذج المحلي قوي، لكنه لا يعرف مستنداتك تلقائيًا. النسخ واللصق يعمل لفقرة، ثم يفشل في سير العمل الحقيقي. RAG، اختصارًا لـ التوليد المعزز بالاسترجاع، يحل هذه المشكلة بجلب النصوص ذات الصلة من ملفاتك وتقديمها للنموذج كسياق لكل إجابة.

RAG يعمل بشكل أفضل عندما يكون خط الأنابيب واضحًا. وهذا يساعد أيضًا في الخصوصية، حيث يمكنك تحديد المصادر المسموح بها.

يمر خط أنابيب RAG النموذجي بهذه المراحل المميزة:

- الاستيعاب: جمع المستندات من المجلدات المعتمدة

- التقسيم: تقسيم النص إلى مقاطع مناسبة للاسترجاع

- التضمينات: تمثيل الأجزاء كمتجهات

- الفهرسة: تخزين المتجهات بالإضافة إلى البيانات الوصفية

- الاسترجاع: سحب أفضل التطابقات للسؤال

- الإجابة: توليد رد مستند إلى النص المسترجع

- الاقتباسات: تُظهر المصادر المستخدمة

قبل أن تضف أي أتمتة، قرر كيف يبدو "الجيد". هذه الفحوصات تجعل سلوك RAG أسهل في التدقيق:

- تتضمن الإجابات اقتباسات واضحة للملف والقسم المحددين

- يرفض النظام الإجابة عندما لا يعيد الاسترجاع شيئًا ذا صلة

- يتم استبعاد المجلدات الحساسة بشكل افتراضي، ثم تُضاف عن قصد

- عملية تحديث الفهرس متوقعة ومسجلة

التقسيم إلى أجزاء هو نقطة فشل شائعة. إذا كانت الأجزاء ضخمة، فإن الاسترجاع يعيد جدارًا من النص. إذا كانت الأجزاء صغيرة جدًا، يفقد السياق. التوازن الجيد يختلف حسب نوع المستند، لذا اختبر على ملفاتك الفعلية ثم اضبط. في مختبر منزلي، يصبح هذا الضبط استثمارًا لمرة واحدة يستمر في العطاء يوميًا.

أمّن وصن صيانة خدمات الذكاء الاصطناعي الخاصة بك في المنزل

الذكاء الاصطناعي المحلي لا يزال خدمة شبكة، وخدمات الشبكة تتعرض للانكشاف دائمًا عن طريق الخطأ. إعادة توجيه منفذ، وكيل عكسي خاطئ الإعداد، أو قاعدة "مؤقتة" يمكن أن تحول نقطة نهاية خاصة إلى عامة.

أولويات الأمان، بالترتيب:

- التحكم في الوصول: مصادقة قوية، حسابات قليلة، أقل امتياز

- نطاق الشبكة: الشبكة المحلية فقط بشكل افتراضي، قواعد صريحة لأي وصول عن بُعد

- أمان النقل: TLS لأي شيء يغادر المضيف المحلي

- نظافة الأسرار: تجنب ترميز المفاتيح مباشرة في الإعدادات والسجلات

- انضباط التصحيحات: تحديثات منتظمة لنظام التشغيل، الحاويات، وواجهة الويب

- النسخ الاحتياطية والاستعادة: النسخ الاحتياطية حقيقية فقط بعد اختبار الاستعادة

للوصول عن بُعد، فضّل استخدام VPN أو نفق موثوق بدلاً من فتح المنافذ. إذا كنت تستخدم وكيل عكسي، اجعله محميًا بالمصادقة وحدود المعدل. هذا يتماشى مع إرشادات أمان API من OWASP، التي تبرز مرارًا وتكرارًا أن المصادقة والتفويض المكسورين هما من أوضاع الفشل الشائعة في الأنظمة الحقيقية.

الصيانة هي ما يميز عرض نهاية الأسبوع عن مساعد خاص يعتمد عليه. روتين خفيف يعمل جيدًا:

- أسبوعي: تحقق من نمو القرص لملفات النماذج والفهارس

- شهري: طبق التحديثات وأعد التشغيل خلال فترة تأثير منخفضة

- ربع سنوي: تحقق من النسخ الاحتياطية، دوّر بيانات الاعتماد، راجع الخدمات المكشوفة

عامل مجموعة الذكاء الاصطناعي المحلية الخاصة بك مثل أي خدمة أساسية أخرى في homelab الخاص بك. هذه العقلية تقلل القلق وتحافظ على وعد الخصوصية.

ابدأ homelab الذكاء الاصطناعي الخاص بك على الإنترنت اليوم!

لجعل الذكاء الاصطناعي الخاص عمليًا في المنزل، ركز على الاعتمادية الهادئة. استهدف أداءً ثابتًا، وتكاليف مستقرة، وحدود خصوصية واضحة. شغّل نموذج لغة كبير واحد محليًا، أضف واجهة بسيطة، وقيّد الوصول إلى الأجهزة والأشخاص الذين تثق بهم. ثم حسّن بناءً على الاستخدام الفعلي، مثل تخزين أسرع لتحميل أسرع، أمان أقوى، أو RAG لمجموعة صغيرة من الوثائق. أنشئ إعداد homelab يمكنك الاعتماد عليه، ودع الذكاء الاصطناعي المحلي يكسب مكانه في سير عملك اليومي بدءًا من اليوم!

الأسئلة الشائعة

س1: هل يمكنني تشغيل نموذج لغوي محلي على خادم صغير منخفض الطاقة في مختبر منزلي؟

نعم، في كثير من الحالات، خاصة للمهام الكتابية الخفيفة والمطالبات القصيرة. توقع استجابات أبطأ على أنظمة المعالج المركزي فقط، واختر نماذج أصغر أو أكثر تقليلًا. إذا أردت استخدامًا يوميًا أكثر سلاسة، خطط لذاكرة RAM كافية و تخزين NVMe سريع لتقليل تأخيرات التحميل.

س2: هل سيعمل الذكاء الاصطناعي المحلي على لابتوبي ويتكامل مع خدمات المختبر المنزلي؟

نعم، غالبًا. يمكنك تشغيل النموذج محليًا على لابتوب أثناء السفر، ثم توجيه أدواتك إلى نقطة نهاية المختبر المنزلي في المنزل عندما تكون على الشبكة المحلية أو VPN. اجعل التكوينات بسيطة باستخدام نمط API محلي ثابت وواجهة واحدة.

س3: هل أحتاج إلى اتصال بالإنترنت لاستخدام الذكاء الاصطناعي المستضاف ذاتيًا بعد الإعداد؟

لا، ليس للاستدلال الأساسي بمجرد تثبيت وقت التشغيل والنماذج. بعض الميزات قد تعتمد على خدمات الشبكة، مثل تحميل نماذج جديدة، تحديث الحاويات، أو مزامنة الوثائق. للحصول على سير عمل فعلي دون اتصال، قم بتنزيل النماذج مسبقًا واحتفظ بالوثائق والتضمينات محليًا على تخزين المختبر المنزلي.

س4: كيف أمنع روبوت الدردشة المحلي من تسريب بيانات خاصة لمستخدمين آخرين؟

استخدم حسابات منفصلة وأذونات صارمة لكل مساحة عمل أو مجموعة بيانات. حدد مصادر الاسترجاع لمجلدات معينة، وتجنب فهرسة مجلدات المنزل المشتركة. التسجيل مهم أيضًا. اجعل السجلات قليلة وراجعها للمحتوى الحساس. في مختبر منزلي متعدد المستخدمين، عزل الخدمات باستخدام الحاويات وقواعد الشبكة.

س5: ما هي طريقة معقولة لتقدير احتياجات التخزين للنماذج اللغوية المحلية والبحث في الوثائق؟

خطط للنمو. قد يناسب نموذج أو نموذجان بشكل مريح، لكن المجموعات تتوسع بسرعة. اعتبر عشرات الجيجابايت كنقطة بداية، ثم أضف مساحة لعدة نماذج، وملفات التخزين المؤقت، و فهرس استرجاع لوثائقك. يساعد NVMe في الأداء، بينما يمكن للأقراص الصلبة الأكبر سعة تخزين الأرشيفات.

مركز حملة Zima

المزيد للقراءة

دليل مراقبة مختبر المنزل ZimaCube: من Uptime Kuma إلى وكلاء الذكاء الاصطناعي

راقب خادم منزلك باستخدام Uptime Kuma أو Pulse أو Proxmox Data Center Manager أو وكيل ذكاء اصطناعي لتتبع وقت التشغيل، والنسخ الاحتياطية، والآلات الافتراضية،...

من سباركستيشن إلى زيما بليد: رحلة استضافة ذاتية لعاشق التكنولوجيا يبلغ من العمر 57 عامًا

قام محترف إداري فرنسي باستبدال جهاز Raspberry Pi 4 المعطل الخاص به بـ ZimaBlade 7700، يعمل بنظام Debian 13، وXFS، وBorgBackup. تم الانتهاء من...

ZimaCube مقابل NAS الصنع اليدوي: أيهما الأنسب لك؟

هل تختار جهاز NAS جاهز أم تصنعه بنفسك؟ نوضح التكاليف الحقيقية، ووقت الإعداد، وThunderbolt 4، وفروقات الصيانة لمساعدتك في تحديد أي بناء يناسب احتياجاتك...